虛擬化技術由于其在提高基礎設施可靠性和提升資源利用效率等方面的巨大優(yōu)勢,應用越來越廣泛。同時,虛擬化技術本身也在快速發(fā)展,虛擬網(wǎng)絡接入領域,802.1Qbg、802.1Qbh等標準相繼推出,虛擬服務器高可用方面,HA、FT、DRS、DPS、vMotion等技術也在不斷演進。相應的虛擬化管理技術必須同步發(fā)展,才能解決虛擬化帶來的需求。

一、虛擬化的技術和管理需求

1 主流的服務器虛擬化技術簡介

在數(shù)據(jù)中心服務器領域,虛擬化技術目前仍處于快速發(fā)展的階段,IDC統(tǒng)計數(shù)據(jù)表明,VMware和Hyper-V處于領導者地位。KVM陣營由于Redhat的加入,將成為第三支最有力量的參與者(如圖1所示)。

云時代數(shù)據(jù)中心虛擬化管理探討" src="http://files.chinaaet.com/images/20111122/26e891e2-59e0-4211-9af8-9c2f9f7f1bdd.jpg" />

圖1 虛擬化產(chǎn)品市場份額

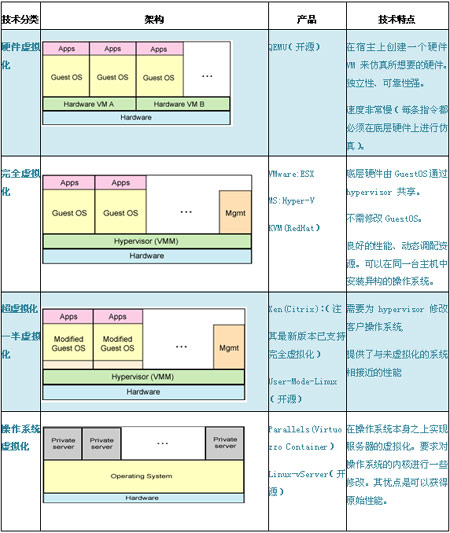

從技術發(fā)展方向來看,服務器虛擬化的有四種分類(如表1所示),其中完全虛擬化技術是目前使用最為普遍的技術,VMware、Hyper-V、KVM、XEN等產(chǎn)品均已支持該技術。

表1 虛擬化技術分類

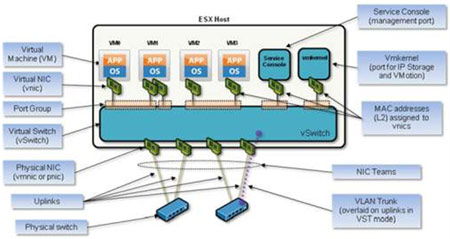

2 虛擬化對管理的影響因素之一:vSwitch

服務器虛擬化引入了虛擬網(wǎng)絡交換機(vSwitch)的概念,如圖2所示,使用虛擬化軟件技術仿真出來的二層交換機,位于物理服務器中。vSwitch創(chuàng)建虛擬的網(wǎng)絡接口(vNIC)鏈接VM,并使用物理網(wǎng)卡連接外部的物理交換機。

圖2 vSwtich結構

vSwitch的出現(xiàn),對傳統(tǒng)的網(wǎng)絡管理方式產(chǎn)生了巨大的影響,主要體現(xiàn)在以下幾點。

1)從網(wǎng)絡管理的范圍來看,不僅要覆蓋物理網(wǎng)絡設備(交換機、路由器、防火墻等),還要延伸到服務器內(nèi)的網(wǎng)絡交換功能,因此需要有不同于SNMP/CLI等傳統(tǒng)的管理手段來管理實現(xiàn)對vSwitch的管理。

2)從網(wǎng)絡的可視性來看,由于虛擬服務器和物理網(wǎng)絡之間多了一層vSwitch,使得傳統(tǒng)的基于網(wǎng)絡設備的網(wǎng)絡可視化管理手段失效(比如流量無法全部感知影響流量分析管理、終端接入無法感知影響網(wǎng)絡拓撲分析)

3)從網(wǎng)絡的可控性來看,由于一個物理網(wǎng)絡接口下面將連接一個復雜的網(wǎng)絡結構,接入層的管控能力從原來針對一個終端擴展成針對一個網(wǎng)絡(包含多個VM終端),需要有手段區(qū)分每個VM終端來達到接入層的控制(而不僅僅是區(qū)分接入接口,因為接入接口下移到服務器內(nèi)部的vSwitch上了)。

3 虛擬化對管理的影響因素之二:遷移

為提供VM系統(tǒng)的可靠性,服務器虛擬化技術提供了VM遷移、高可用性(HA)、熱備容錯、資源池調(diào)度等特性,這些特性都會影響VM的物理部署位置,不僅使虛擬服務器在數(shù)據(jù)中心網(wǎng)絡中的物理位置的可視性變得困難,并且使得服務器接入物理網(wǎng)絡設備需要一定的網(wǎng)絡資源配置,其接入位置的動態(tài)性就要求物理網(wǎng)絡配置能提供隨需而動的管理能力。

以下以VMware舉例,介紹這幾種特性及對網(wǎng)絡管理的影響和需求。

3.1 VM遷移-vMotion

vMotion有幾種實現(xiàn),目前對VM服務中斷影響最小、遷移性能最佳的實現(xiàn)方式是在線遷移(Live Migration),如圖3所示。一般物理機之間要采用SAN或NAS之類的集中式共享外存設備,同時考慮操作系統(tǒng)內(nèi)存執(zhí)行狀態(tài)的遷移[注:主流的內(nèi)存遷移技術是預拷貝技術,通過多個輪次的增量拷貝,直至內(nèi)存不再更新。不在此詳述],停機時間非常短暫。

圖3 vMtoion示意圖

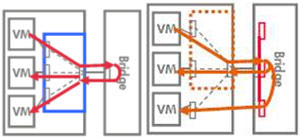

3.2 高可用性HA

有兩種HA模式:1)物理服務器故障,可在具有備用容量的其他生產(chǎn)服務器中自動重新啟動受影響的所有虛擬機(如圖4左所示);2)VM操作系統(tǒng)出現(xiàn)故障,HA 會在同一臺物理服務器重啟啟動受影響的虛擬機(如圖4右所示)。

圖4 HA場景示意圖

3.3 熱備容錯(Fault Tolerance):

如圖5所示,原始實例創(chuàng)建一個在另一臺物理服務器上運行的實時影子,VM故障時可不重啟完成切換,防止由硬件故障導致的應用程序中斷,相當于熱備份。

圖5 FT場景示意圖

3.4 動態(tài)資源調(diào)度:

基于預先設定的規(guī)則,跨資源池動態(tài)平衡計算、分配資源。如圖6所示,管理員可以將Exchange server和Apache Server移動到其他物理服務器,使SAP系統(tǒng)得到更多的空閑資源。

圖6 動態(tài)資源調(diào)度示意圖

4 遷移對網(wǎng)絡管理的影響和需求分析

在上述場景中,VM位置都發(fā)生了改變,VM能否正常運行,不僅需要在服務器上的資源合理調(diào)度,網(wǎng)絡連接的合理調(diào)度也是必須的。

圖7 VM、網(wǎng)絡遷移示意圖

如圖7所示,如果把虛擬機VM1從物理服務器pSrv1遷移到物理服務器pSrv2上,其網(wǎng)絡連接從原來的由pSRV1上虛擬交換機vSwitchA的某個VSI(屬于VLAN100的端口組)接入到邊緣物理交換機Edge Switch1,變成由pSRV2上vSwitchB的某個VSI接入到Edge SwitchB。若遷移后對應的Edge Switch的網(wǎng)絡配置不合適,則VM1遷移后就可能不能正常使用。比如原先對VM1的訪問設置了ACL,以屏蔽非法訪問;或設置了QoS,以保障VM1上業(yè)務運行帶寬等服務質(zhì)量。都需要在發(fā)生VM創(chuàng)建或vMotion時同步調(diào)整相關的網(wǎng)絡連接配置。并且,為了保證VM的業(yè)務連續(xù)性,除了虛擬化軟件能保證VM在服務器上的快速遷移,相應的網(wǎng)絡連接配置遷移也需要實時完成,即網(wǎng)絡需要具有“隨需而動”的自動化能力,這也就需要利用虛擬化軟件提供管理API。目前主要的API技術有如下幾種。

4.1 VMware ESX/ESXi的管理API

VMware對外提供的管理接口主要是vShpere API(如圖8所示),管理系統(tǒng)可通過調(diào)用API接口對VMware進行管理。

圖8 VMware管理接口

4.2 Hyper-V的管理API

微軟的Hyper-V提供了類似VMware vCenter的集中管理產(chǎn)品SCVMM(System Center Virtual Machine Manager),并可以提供WMI和powerShell形式的API接口管理能力。

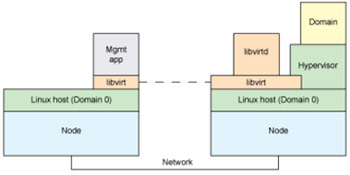

4.3 通用的虛擬化API

為解決虛擬化產(chǎn)品管理的兼容性問題,業(yè)界出現(xiàn)了針對虛擬化的通用API技術,典型的是Libvert技術(如圖9所示)。注:Libvert目前支持KVM、Xen、VMware等主流虛擬化產(chǎn)品。

圖9 Libvert技術架構

二、虛擬化趨勢下的可視性管理

服務器虛擬化后,虛擬服務器規(guī)模劇增,以及虛擬化軟件的遷移特性使虛擬服務器在數(shù)據(jù)中心網(wǎng)絡中的物理位置的可視性變得困難。當業(yè)務系統(tǒng)異常時,需要從服務器、網(wǎng)絡各方面進行分析診斷,對網(wǎng)絡管理員來講,需要清楚虛擬服務器VM位于哪個物理服務器、通過哪個物理網(wǎng)絡交換機接口接入網(wǎng)絡,甚至需要了解vSwitch上的網(wǎng)絡配置(比如VLAN),特別是服務器和網(wǎng)絡的邊界鏈接的可視性。如果對這些信息無法可視化管理,就無法有效的分析和定位故障。

因此需要使用服務器虛擬化管理技術將虛擬化網(wǎng)絡相關信息納入到統(tǒng)一的資源可視化管理中。

1 虛擬資源視圖

通過虛擬資源視圖,可以查看物理服務器、虛擬交換機、VM的資源從屬關系信息。同時在虛擬交換機管理視圖中,其提供了服務器中虛擬網(wǎng)絡的配置能力(端口數(shù)量、端口組、VLAN、和物理網(wǎng)卡的綁定關系等)。在虛擬機的管理視圖中,可以提供分配的計算資源、GuestOS信息的可視性等功能。

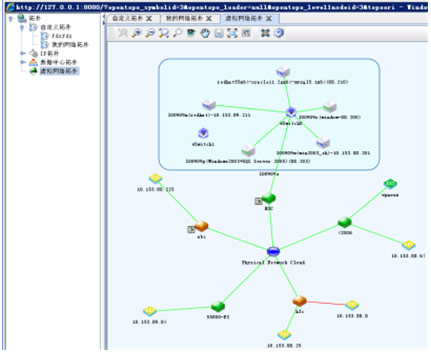

2 虛擬網(wǎng)絡拓撲

拓撲是最為直觀的管理方式,通常的網(wǎng)絡拓撲由于沒有計算虛擬化相關數(shù)據(jù),無法得到各個虛擬服務器VM和物理服務器、vSwitch的從屬和鏈接關系,各個VM是零落到整個拓撲、不同網(wǎng)段中的獨立節(jié)點,而且VM的數(shù)量遠遠大于物理服務器的數(shù)量,最終出現(xiàn)的是一個大量、雜亂、無關的拓撲。

通過虛擬網(wǎng)絡拓撲可以解決這個問題,管理系統(tǒng)在拓撲計算中使用虛擬網(wǎng)絡的拓撲數(shù)據(jù),提供清晰簡潔的物理拓撲,所有虛擬節(jié)點都聚合到物理服務器節(jié)點上;同時又能體現(xiàn)物理服務器內(nèi)部的虛擬世界。如圖10所示,可以看到展示物理服務器(ESX)、虛擬交換機(vSwitch)、虛擬機(VM)之間的從屬或連接關系。同時,通過ESX和物理交換機之間的連接關系,可展示ESX所在的物理位置。

圖10 虛擬網(wǎng)絡拓撲實例

三、虛擬化趨勢下的流量可視性管理

數(shù)據(jù)中心中不僅僅存在著外部對數(shù)據(jù)中心應用的訪問流量,在數(shù)據(jù)中心內(nèi)部應用之間反而存在著更為大量的數(shù)據(jù)交換,掌握這部分流量的分布以及對網(wǎng)絡的需求,對保障其業(yè)務的正常運行有更大的意義。而當業(yè)務大量部署在虛擬服務器上時,如何感知虛擬服務器之間的流量就變得非常重要。

1 從網(wǎng)絡側分析虛擬化流量的可視性

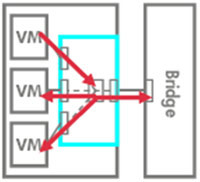

對于傳統(tǒng)虛擬化技術中的VEB vSwitch模式,虛擬機VM之間的相互流量直接在vSwitch上交換,網(wǎng)絡是無法感知的(如圖11所示)。因此通過傳統(tǒng)的網(wǎng)流分析手段分析流量比較困難。

圖11 VEB模式流量模型

目前正在形成標準的VEPA(802.1Qbg)方案中,VM間的流量必須通過外部網(wǎng)橋進行交換(如圖12所示),網(wǎng)絡具有完全的流量可視性,只要網(wǎng)流分析管理軟件能夠?qū)⒂|角延伸到VEPA外部網(wǎng)橋上即可。該模式要求對應網(wǎng)橋支持NetStream、NetFlow、SFlow能力。

圖12 VEPA、Multi-Channel模式流量模型

2 從服務器內(nèi)部分析虛擬化流量的可視性

除了從網(wǎng)絡側進行流量的可視性感知,還可以以一定的手段從虛擬機內(nèi)部進行進行流量分析。比如,利用vSwitch端口的混雜模式特性,當vSwitch的相應端口配置為混雜模式時,與該端口連接的探測服務器就能鏡像觀測到該vSwitch上的所有流量。當然,探測服務器就必須作為一個VM才能連接到vSwitch上。

如圖13所示,流量采集器(探針)可以作為一個VM部署到需要監(jiān)控的物理服務器上,并將采集的流量數(shù)據(jù)輸出到外部的流量分析軟件進行分析。該方式要求探針部署到服務器內(nèi)部,而不是重要網(wǎng)絡節(jié)點附近。相當于降低了探針的部署位置,部署的數(shù)量可能會比較多。

圖13 基于vSwitch端口混雜模式的流量采集

四、虛擬趨勢下的自動化配置遷移

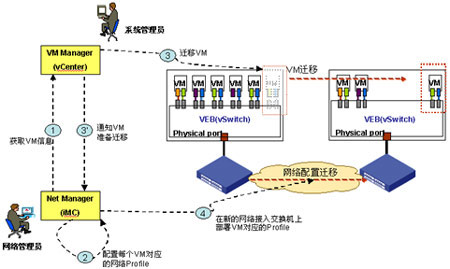

1 基于VMware vCenter的配置遷移方案

圖14 基于VMware的虛擬網(wǎng)絡配置遷移原理

如圖14所示,該方案的關鍵在于網(wǎng)管系統(tǒng)的虛擬化環(huán)境的拓撲可視化能力,定位出VM連接到的物理網(wǎng)絡交換機的接入位置以下發(fā)VM對應的網(wǎng)絡配置。如圖17所示,一個VM可能有一個或多個vNic,通過一個或多過vSwitch連接到外部物理交換機。如果要準確定位VM連接的物理網(wǎng)絡交換機的接入位置,vSwitch和pSwitch都需要支持必要的二層拓撲協(xié)議,比如LLDP協(xié)議。以VMware產(chǎn)品為例,其最新版本(vSphere5.0)已經(jīng)開始支持LLDP協(xié)議,但僅在vDS(虛擬網(wǎng)絡分布式交換機)上支持LLDP,普通的vSwitch并不支持,虛擬服務器接入位置定位的準確性很難保證。

圖15 VM的物理網(wǎng)絡接入位置定位

除此之外,本方案還存在一個控制精細度問題。在VEB vSwtich模式下,多個VM可以通過一個物理接口連接到鄰接物理交換機,即VM和物理接口是N:1的關系。如圖16所示。

圖16 VEB、Multi-Channel物理端口映射對比

在此模式下,對物理交換機的配置控制粒度只能到物理接口級,針對數(shù)據(jù)中心“隨需而動”的配置自動化遷移,通常情況下會出現(xiàn)多個VM的配置都重復下發(fā)到一個物理接口上,很難做到針對每一個VM的精細化網(wǎng)絡配置管理。

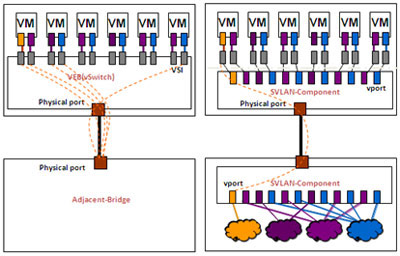

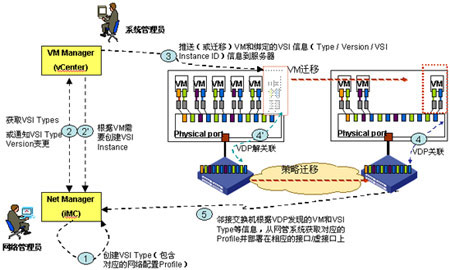

2 基于802.1Qbg的配置遷移方案

擬定義的802.1Qbg標準(目前是draft1.6版本)在解決這些問題上提出了新的思路。

802.1Qbg標準首先解決了精細化控制最優(yōu)的解決方法,即在鄰接物理交換機出現(xiàn)了vPort的概念。這類邏輯虛接口可以實現(xiàn)和VM對應的vNic/VSI的1:1對應關系。VM遷移時,只需在對應的鄰接物理交換機上動態(tài)創(chuàng)建一個vPort,并將VM對應的網(wǎng)絡配置Profile綁定到vPort上。不會對其他vPort產(chǎn)生影響。同時遷移前對應的鄰接物理交換機只需要簡單的將對應的vPort邏輯接口刪除即可,不存在反向去部署的復雜性問題。

其次,802.1Qbg的VDP特性解決了VM接入定位準確性的問題,即通過VDP通告,鄰接物理交換機學習到連接接入的VM信息和對應的網(wǎng)絡連接配置信息,并主動向網(wǎng)管系統(tǒng)請求對應的網(wǎng)絡連接配置profile,減少了網(wǎng)管系統(tǒng)進行VM接入位置定位的步驟。

該方案過程如圖17所示。

圖17 支持VDP的虛擬網(wǎng)絡配置遷移

整體來看,引入802.1Qbg VDP后,不依賴網(wǎng)管系統(tǒng)對VM接入物理網(wǎng)絡的定位能力,提高了網(wǎng)絡配置遷移的準確性和實時性。同時,服務器系統(tǒng)管理員和網(wǎng)絡管理員職責劃分也將更加明確。對系統(tǒng)管理員來講,只需要關注網(wǎng)絡提供的虛擬服務器到鄰接交換機的鏈接;而對網(wǎng)絡管理員而言,則只需要關注針對不同的應用系統(tǒng)(或VSI類型)應提供什么樣的網(wǎng)絡接入配置。這樣在IaaS中,網(wǎng)絡和服務器之間就產(chǎn)生了一種服務概念的抽象――鏈接即服務(CaaS,Connection as a service)。

五、結束語

虛擬化服務器、網(wǎng)絡的融合管理已經(jīng)成為當前企業(yè)IT、數(shù)據(jù)中心建設IaaS能力的必要元素,各廠商都在相關領域進行嘗試,也出現(xiàn)了不同的虛擬化軟件廠商和網(wǎng)絡廠商的聯(lián)盟,不同的實現(xiàn)方案。另一方面,標準化工作和管理技術的研究也在快速進行,在虛擬化管理領域我們?nèi)孕杈o跟虛擬化技術的發(fā)展,才能更好地提供可視、可控的虛擬網(wǎng)絡管理能力。