2001年6月26日,著名導(dǎo)演史蒂文·斯皮爾伯格執(zhí)導(dǎo)的《人工智能》(英文名:《AI》)在美國(guó)上映。影片講述的是機(jī)器人小男孩大衛(wèi)為了尋找養(yǎng)母,并縮短機(jī)器人與人類的差距而奮斗的故事。

谷歌英特爾英偉達(dá)間彼此競(jìng)爭(zhēng)又互相需要" alt="AI時(shí)代 谷歌英特爾英偉達(dá)間彼此競(jìng)爭(zhēng)又互相需要" src="http://images.ofweek.com/Upload/News/2017-06/10/Trista/1497059745328027861.jpg" width="600" height="393"/>

《人工智能》電影劇照

大衛(wèi)是一個(gè)被輸入情感程序的機(jī)器人男孩,Cybertronics Manufacturing公司員工亨瑞和他妻子制造出的一個(gè)試驗(yàn)品。他們收養(yǎng)了大衛(wèi),并給了他足夠的愛(ài),但是人類與機(jī)器都無(wú)法接受大衛(wèi)。于是大衛(wèi)踏上旅程去尋找真正屬于自己的地方,渴望成為一個(gè)真正意義上的人。

在這部影片上映15年后,機(jī)器人還沒(méi)有成為真正意義上的人, 但人工智能在圍棋領(lǐng)域戰(zhàn)勝了人類。它的強(qiáng)大和超強(qiáng)的進(jìn)化能力,讓人類棋手難以望其項(xiàng)背。

AlphaGo以3:0戰(zhàn)勝柯潔九段

“AlphaGo Master比AlphaGo Lee(與李世石對(duì)戰(zhàn)的版本)要強(qiáng)大,Master在對(duì)戰(zhàn)中耗費(fèi)的能力(性能和功耗)僅是Lee版本的十分之一,需要4個(gè)TPU在單臺(tái)電腦上運(yùn)行即可。”DeepMind首席科學(xué)家David Silver在AlphaGo戰(zhàn)勝李世石后這樣解釋說(shuō)。

AlphaGo強(qiáng)大到令人絕望,引發(fā)了“人工智能威脅人類”的討論。但在本質(zhì)上,人工智能是算法、數(shù)據(jù)和硬件三個(gè)要素綜合的結(jié)果。

一旦涉及到算法、數(shù)據(jù),就離不開(kāi)計(jì)算。在這個(gè)領(lǐng)域,用來(lái)計(jì)算的硬件主要是TPU、GPU和CPU,他們背后代表的公司則分別是谷歌、英偉達(dá)和英特爾。這幾家公司彼此競(jìng)爭(zhēng),又互相需要。

TPU(Tensor Processing Unit)是專為機(jī)器學(xué)習(xí)而定制的芯片,經(jīng)過(guò)了專門(mén)深度機(jī)器學(xué)習(xí)方面的訓(xùn)練。谷歌工程師Norm Jouppi介紹,在人工智能相關(guān)的算法上,它的計(jì)算速度更快,計(jì)算結(jié)果更精準(zhǔn),同時(shí)也更加節(jié)能。

谷歌在I/O 2017上發(fā)布第二代Cloud TPU

人工智能依賴于機(jī)器學(xué)習(xí)(Machine Learning),機(jī)器學(xué)習(xí)又依賴于硬件,它需要硬件平臺(tái)提供大量的運(yùn)算資源。就計(jì)算效率來(lái)說(shuō),專用工具的計(jì)算效率遠(yuǎn)高于通用工具。專門(mén)為機(jī)器學(xué)習(xí)定制而出現(xiàn)的谷歌的TPU就是一種專用的工具,業(yè)內(nèi)普遍認(rèn)為它的出現(xiàn)對(duì)于通用工具GPU來(lái)說(shuō)是一種威脅。

GPU的設(shè)計(jì)初衷不是主要用來(lái)進(jìn)行神經(jīng)網(wǎng)絡(luò)運(yùn)算,而是圖像處理。由于其特殊的構(gòu)造碰巧也比較適用于神經(jīng)網(wǎng)絡(luò)運(yùn)算,所以在TPU出現(xiàn)之前,大多數(shù)做機(jī)器學(xué)習(xí)廠商都在同時(shí)利用FPGA和GPU來(lái)改進(jìn)訓(xùn)練自己的神經(jīng)網(wǎng)絡(luò)算法。

英偉達(dá)創(chuàng)始人兼CEO黃仁勛卻不認(rèn)同“TPU威脅論”,在接受鳳凰科技的采訪時(shí),他表示谷歌的TPU不會(huì)對(duì)英偉達(dá)的Volta GPU構(gòu)成威脅,雙方在TensorFlow項(xiàng)目上保持著合作,而Volta GPU的運(yùn)算能力甚至在TPU之上。

作為世界最大的GPU制造商之一,英偉達(dá)一直不遺余力地推廣GPU在深度學(xué)習(xí)領(lǐng)域的應(yīng)用。老黃將英偉達(dá)稱為“一家人工智能公司”。

談到英偉達(dá)基于GPU的人工智能戰(zhàn)略,需要先從Volta說(shuō)起。

在今年5月11日的NVIDIA GTC 2017上,英偉達(dá)推出了全新的GPU架構(gòu)Volta。英偉達(dá)應(yīng)用深度學(xué)習(xí)研究副總裁Bryan Catanzaro表示這并不是前代架構(gòu)Pascal的升級(jí),而是一個(gè)全新的架構(gòu)。Volta提供大量的FLOP(浮點(diǎn)運(yùn)算),基于Volta的架構(gòu),人們就可以使用需要更多FLOP的深度學(xué)習(xí)模型。如今很多流行的模型都需要很大的計(jì)算資源,例如卷積學(xué)習(xí)神經(jīng)網(wǎng)絡(luò)。

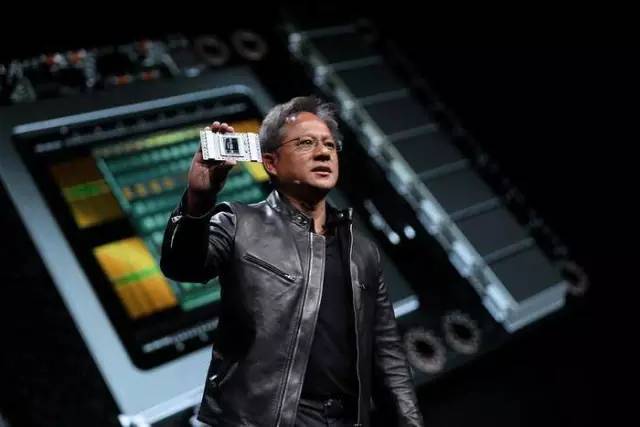

黃仁勛展示基于Volta架構(gòu)的Tesla V100加速芯片

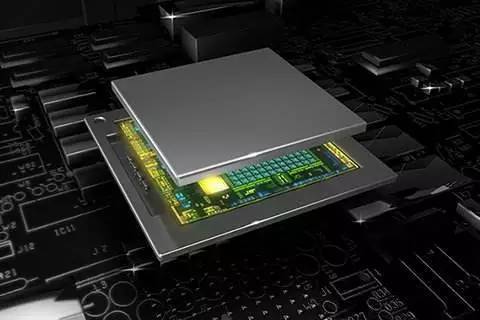

基于全新的Volta架構(gòu),英偉達(dá)推出Tesla V100加速器,它速度比其前身Tesla P100快2.4倍。

Tesla V100凝聚了英偉達(dá)內(nèi)部數(shù)千名工程師數(shù)年的開(kāi)發(fā),研發(fā)投入相當(dāng)于30億美金。黃仁勛在NVIDIA GTC 2017的主題演講中,展示了一塊Tesla V100,他笑稱全世界唯一一塊就在他手上,如果有人想買的話,那么價(jià)格就是30億美金。

而在Tesla V100加速器基礎(chǔ)上,英偉達(dá)推出了超級(jí)計(jì)算機(jī)DGX-1V和HGX。

DGX-1V內(nèi)置了8塊Tesla V100,黃仁勛表示“DGX-1V相當(dāng)于400個(gè)服務(wù)器”,過(guò)去Titan X(GTX TITAN X,泰坦顯卡)需要花費(fèi)8天訓(xùn)練的神經(jīng)網(wǎng)絡(luò),DGX-1V只需要8個(gè)小時(shí),性能提升了24倍。

HGX是英偉達(dá)和微軟聯(lián)合開(kāi)發(fā)的云圖形加速器,是英偉達(dá)人工智能戰(zhàn)略的硬件支撐。它同樣內(nèi)置了8塊Tesla V100。目前微軟的Project Olympus計(jì)劃、Facebook的Big Basin系統(tǒng)都是使用的HGX作為數(shù)據(jù)中心設(shè)計(jì)方案的核心。

黃仁勛在臺(tái)北國(guó)際電腦展的主題演講中表示,GPU的運(yùn)算能力提升非常快,能在未來(lái)取代CPU成為最主要的人工智能芯片。

但是英特爾并不這么認(rèn)為。臺(tái)北國(guó)際電腦展期間,英特爾數(shù)據(jù)中心全球銷售部產(chǎn)品和技術(shù)總經(jīng)理陳葆立在接受鳳凰科技采訪時(shí)提到,TPU和GPU只是加速芯片,目前是無(wú)法獨(dú)立工作的,沒(méi)有CPU它跑不起來(lái)。

“不管是AMD或者是ARM出的CPU,都是不能直接連接到英偉達(dá)的GPU的,連接的標(biāo)準(zhǔn)是PCIE(這屬于英特爾),傳輸速度取決于PCIE的速度。但是目前我們自己的芯片組合可以跳過(guò)PCIE,所以能比CPU+GPU更快。”他說(shuō)。

在收購(gòu)Nervana之后,英特爾擁有了將至強(qiáng)融核處理器和FPGA兩個(gè)不同的芯片整合成一個(gè)芯片的能力。在最新的Nervana系統(tǒng)中,就包含了FPGA加速芯片Arria 10和至強(qiáng)融核處理器的整合。

Arria 10就是一款主流的Altera FPGA產(chǎn)品

FPGA最初是從專用集成電路發(fā)展起來(lái)的半定制化的可編程電路,它可以作為一種用以實(shí)現(xiàn)特殊任務(wù)的可再編程芯片應(yīng)用與機(jī)器學(xué)習(xí)中。

譬如百度的機(jī)器學(xué)習(xí)硬件系統(tǒng)就是用FPGA打造了AI專有芯片,制成FPGA版百度大腦。FPGA比相同性能水平的硬件系統(tǒng)消耗能率更低,在刀片式服務(wù)器上可以由主板上的PCI Express總線供電。使用FPGA可以將一個(gè)計(jì)算得到的結(jié)果直接反饋到下一個(gè),不需要臨時(shí)保存在主存儲(chǔ)器,所以存儲(chǔ)帶寬要求也在相應(yīng)降低。

英特爾的方案是將CPU與FPGA融合起來(lái),組合芯片的運(yùn)算更加靈活和高效,同時(shí)還能實(shí)現(xiàn)最低的功耗,獲得性能和功耗的平衡。

人工智能方興未艾,谷歌的TPU、英偉達(dá)的GPU和英特爾的CPU組合方案,在硬件層面上都還只是嘗試,這種嘗試能幫助實(shí)現(xiàn)早期的技術(shù)積累。在采訪的最后陳葆立提到,雖然是不同的硬件平臺(tái),但是大家都在想辦法融合,這有利于幫助開(kāi)發(fā)者,從而真正幫助人工智能向前發(fā)展。