人臉識(shí)別作為生物識(shí)別中的重要手段,成為了近年身份識(shí)別中最熱門的領(lǐng)域。但與人臉識(shí)別技術(shù)共同發(fā)展的,還有借助機(jī)器學(xué)習(xí)系統(tǒng)、圖像視頻和音頻內(nèi)容,更改人臉、物體或環(huán)境呈現(xiàn)方式的深度偽造技術(shù)。隨著這一技術(shù)的日趨成熟,其引發(fā)的諸多社會(huì)問(wèn)題也開(kāi)始凸顯。在對(duì)抗虛假視頻方面,目前各方在尋求技術(shù)突破的同時(shí),也致力于在制度建設(shè)方面做出改變。

俗話說(shuō)“眼見(jiàn)為實(shí)”,人們往往對(duì)看到的圖像、視頻深信不疑,而隨著Photoshop、美圖秀秀等圖像編輯軟件的興起,人工智能造假技術(shù)的更迭,圖像篡改變得越來(lái)越容易,假圖片、假新聞等在網(wǎng)上泛濫成災(zāi),人們也愈發(fā)不敢相信自己的眼睛。

為了應(yīng)對(duì)美國(guó)大選季期間高發(fā)的虛假信息,近日,谷歌決定出手,以AI治AI。有專家指出,深度偽造技術(shù)(Deepfake)是AI發(fā)展到一定階段的產(chǎn)物,隨著這種技術(shù)的發(fā)展,相應(yīng)的檢測(cè)技術(shù)也會(huì)越來(lái)越先進(jìn)——如同“貓抓老鼠的游戲”,將是一場(chǎng)永無(wú)休止的競(jìng)賽。

假視頻越來(lái)越逼真

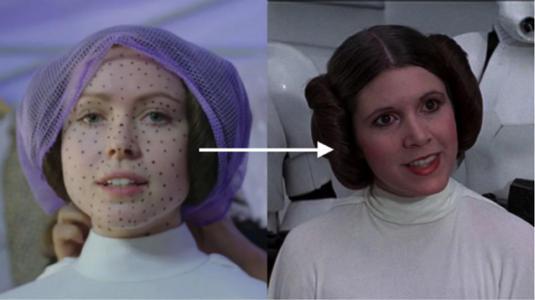

2019年11月,在北美上映的電影《愛(ài)爾蘭人》反響熱烈,其中令人咋舌的是電影特效制作公司運(yùn)用虛擬影像重建技術(shù),將片中主角們集體“減齡”,抹平年近80歲演員們?nèi)蓊伾系臍q月痕跡,使之重新煥發(fā)青春。這種讓耄耋之年的演員重回年輕模樣的“換臉”技術(shù)著實(shí)讓觀眾心頭一震。

“Deepfake專指基于人工智能的人體圖像合成技術(shù),主要應(yīng)用于‘換臉’,其在很多領(lǐng)域有積極的商業(yè)價(jià)值,但是一旦被‘黑產(chǎn)’盯上用作謀利工具,則會(huì)給個(gè)人和社會(huì)帶來(lái)風(fēng)險(xiǎn)和挑戰(zhàn)。”遠(yuǎn)望智庫(kù)人工智能事業(yè)部部長(zhǎng)、圖靈機(jī)器人首席戰(zhàn)略官譚茗洲介紹說(shuō)。

這其中最飽受爭(zhēng)議的是“換臉”技術(shù)被一些情色網(wǎng)站利用。不久前,網(wǎng)絡(luò)上走紅的“一鍵脫衣”軟件DeepNude,只要輸入一張完整的女性圖片就可自動(dòng)生成相應(yīng)裸照,并且生成照片存在著廣泛傳播的風(fēng)險(xiǎn),最終在各方壓力下這款A(yù)PP被下架。

不僅如此,不久前還出現(xiàn)了語(yǔ)音版的Deepfake。加拿大一家創(chuàng)業(yè)公司開(kāi)發(fā)出的語(yǔ)音合成系統(tǒng)RealTalk,僅基于一定的文本輸入即可生成和真人聲音十分相似的聲音。演示中,系統(tǒng)模仿了美國(guó)一位著名脫口秀喜劇演員、主持人的聲音,以至于本人聽(tīng)后高呼“真的可怕”。而未來(lái)這種技術(shù)還可能會(huì)發(fā)展到只需幾秒鐘的音頻素材,即能復(fù)制出他人聲音的程度。

讓人更為頭疼的是,Deepfake技術(shù)讓虛假信息“如虎添翼”,尤其在社會(huì)重大事件中能夠起到強(qiáng)勁攪拌作用,以至于可能會(huì)影響到人們決策以及社會(huì)穩(wěn)定。據(jù)相關(guān)文獻(xiàn),2016年美國(guó)總統(tǒng)大選前的一個(gè)月內(nèi),每個(gè)美國(guó)網(wǎng)民平均會(huì)接觸1—3篇假新聞。2020年初,新冠肺炎病毒席卷全國(guó),就有造假者運(yùn)用上述技術(shù)偽造鐘南山院士發(fā)言,而針對(duì)“辟謠”的百度搜索指數(shù)(1月19日—1月25日)與去年春節(jié)期間相比,增長(zhǎng)了5.4倍。

以AI治AI揪出假視頻

“自Deepfake2017年年底首次出現(xiàn)以來(lái),隨著其技術(shù)的開(kāi)源,合成剪輯視頻的數(shù)量不斷增長(zhǎng)。要對(duì)付假視頻,就要在網(wǎng)絡(luò)海量信息中,快速找到虛假圖片,并對(duì)圖像識(shí)別后精準(zhǔn)提取其中語(yǔ)義,這也是目前人工智能算法上的核心研究發(fā)力點(diǎn)。”譚茗洲表示。

要識(shí)別虛假視頻,首先,我們來(lái)分析一下Deepfake都有哪些招數(shù)。

“目前圖像篡改類型主要分為復(fù)制—粘貼、拼接、圖像修補(bǔ)/局部區(qū)域去除和人臉PS四大類。”行業(yè)專家曹娟博士近日在接受科技日?qǐng)?bào)記者采訪時(shí)指出,“既有的檢測(cè)方法主要基于手工特征方法和深度學(xué)習(xí)的方法,前者包括基于圖像的物理屬性(光照不連續(xù)、陰影不連續(xù)、色差等)、相機(jī)屬性(顏色濾波陣列、傳感器噪聲、EXIF數(shù)據(jù)分析等)、壓縮痕跡(DCT系數(shù)、塊狀效應(yīng)等)、像素級(jí)屬性(復(fù)制—粘貼、重采樣等);后者包括Encoder-Decoder模型、約束卷積模型和Multi-domain模型等。”

“魔”高一尺,“道”可高一丈嗎?近日,谷歌母公司Alphabet旗下的Jigsaw聯(lián)手Google Research、美國(guó)馬里蘭大學(xué)等多家研究機(jī)構(gòu),開(kāi)發(fā)了名為Assembler的實(shí)驗(yàn)平臺(tái),旨在幫助應(yīng)用者通過(guò)簡(jiǎn)單操作,快速識(shí)別Deepfake,減少AI技術(shù)濫用所帶來(lái)的傷害。

譚茗洲介紹:“實(shí)際上,這個(gè)平臺(tái)是把多個(gè)圖像檢測(cè)器集成為一個(gè)工具,每個(gè)檢測(cè)器都針對(duì)特定類型的圖像進(jìn)行處理。比如,有的檢測(cè)器能判斷圖像是否有復(fù)制粘貼痕跡,檢測(cè)主要關(guān)注圖像顏色、噪點(diǎn)等。”

具體而言,其機(jī)器學(xué)習(xí)模型既能利用圖像的顏色值來(lái)查找異常,也能檢查圖像的噪點(diǎn)模式是否存在不一致。算法上,能夠查找被編輯過(guò)的JPEG壓縮圖像區(qū)域外觀相似的區(qū)塊,以判斷其中一個(gè)圖像是否被復(fù)制粘貼到另一個(gè)區(qū)域上。

“然而,真實(shí)場(chǎng)景中,媒體經(jīng)常面對(duì)的是經(jīng)過(guò)復(fù)雜處理后編輯的低分辨率的圖像,這就給檢測(cè)技術(shù)帶來(lái)新的挑戰(zhàn)。光用底層算法不能準(zhǔn)確抓住圖像上損失掉的篡改痕跡,還需要結(jié)合高層語(yǔ)義算法來(lái)識(shí)別。”曹娟說(shuō)。

曹娟進(jìn)一步指出,現(xiàn)有檢測(cè)假視頻的方法尚存在三個(gè)主要局限性。第一,通用性不夠,大部分檢測(cè)只針對(duì)特定類型的篡改,如何尋找篡改的共同屬性,讓模型能應(yīng)對(duì)多種篡改類型是未來(lái)的研究重點(diǎn)之一。第二,對(duì)抗能力不夠,目前篡改手段不斷隱蔽,經(jīng)過(guò)復(fù)雜的處理,篡改痕跡往往會(huì)消失,導(dǎo)致檢測(cè)性能大大下降。如何提高模型的魯棒性,應(yīng)對(duì)各種真實(shí)的應(yīng)用場(chǎng)景,是未來(lái)的核心任務(wù)。第三,目前的方法基本都是對(duì)圖像劃分成小塊,再逐塊處理,非常耗時(shí)耗資源。

共建保證信息真實(shí)的生態(tài)體系

國(guó)際咨詢公司Gartner曾預(yù)測(cè):到2020年,互聯(lián)網(wǎng)虛假信息或產(chǎn)生更大危害,基于人工智能技術(shù)的造假能力或?qū)⑦h(yuǎn)超虛假檢測(cè)的能力。2018年3月,《科學(xué)》雜志刊登的一篇論文指出:近年來(lái)虛假新聞的興起,突顯出互聯(lián)網(wǎng)時(shí)代現(xiàn)有的對(duì)抗錯(cuò)誤信息制度和技術(shù)的不足,目前迫切需要重建一個(gè)保證信息真實(shí)性的信息生態(tài)系統(tǒng)。

“如今更重要的是提升針對(duì)性的檢測(cè)技術(shù)、完善相關(guān)法律及認(rèn)證機(jī)制。”譚茗洲強(qiáng)調(diào)。

2019年9月5日,臉書(Facebook)相關(guān)負(fù)責(zé)人宣布,臉書正與微軟公司聯(lián)合包括美國(guó)麻省理工學(xué)院、英國(guó)牛津大學(xué)、美國(guó)康奈爾大學(xué)等在內(nèi)的多所大學(xué)研究檢測(cè)Deepfake的方法,同時(shí)非營(yíng)利性研究組織Partnership on AI也參與其中,該組織的成員包括谷歌、蘋果、亞馬遜、IBM等大型科技公司。

曹娟介紹說(shuō),在研究方面,除Assembler平臺(tái)之外,目前國(guó)內(nèi)做的比較好的有中科院計(jì)算所、中科院自動(dòng)化所、北京交通大學(xué)、中山大學(xué)、深圳大學(xué)等,國(guó)外的美國(guó)加州大學(xué)伯克利分校、美國(guó)賓漢姆頓大學(xué)、美國(guó)馬里蘭大學(xué)等。同時(shí),很多企業(yè)和研究機(jī)構(gòu)也在積極研發(fā)實(shí)用的圖像篡改檢測(cè)工具和平臺(tái),如美國(guó)Amped Software公司開(kāi)發(fā)的Amped Authenticate工具。

2019年11月29日,國(guó)家互聯(lián)網(wǎng)信息辦公室發(fā)布《網(wǎng)絡(luò)音視頻信息服務(wù)管理規(guī)定》,要求網(wǎng)絡(luò)音視頻信息服務(wù)提供者應(yīng)當(dāng)具有與新技術(shù)新應(yīng)用發(fā)展相適應(yīng)的安全可控的技術(shù)保障,部署違法違規(guī)音視頻和非真實(shí)音視頻鑒別技術(shù)。

專家建議,防治虛假視頻,有關(guān)部門要建立相關(guān)管理制度,特別是新聞視頻、新聞內(nèi)容管理方面;在傳播渠道上,要建立過(guò)濾機(jī)制,在技術(shù)上實(shí)現(xiàn)高效過(guò)濾,并且還要對(duì)所有造假視頻音頻實(shí)現(xiàn)溯源,同時(shí),增加對(duì)檢測(cè)技術(shù)研發(fā)資金的投入,激發(fā)技術(shù)創(chuàng)新。