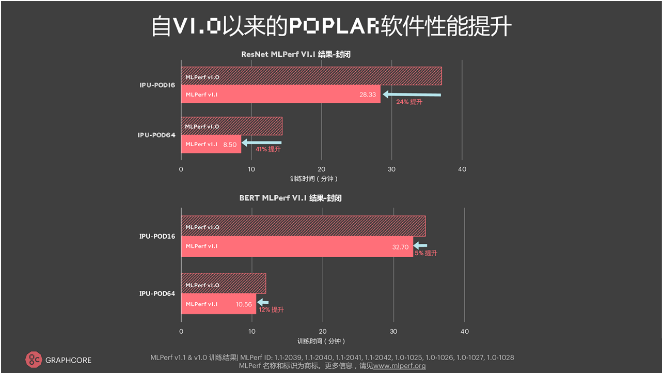

12月2日,AI芯片初創(chuàng)公司Graphcore(擬未科技)正式公布其參與MLPerf測試(MLPerf V1.1)的最新結(jié)果。Graphcore在本次提交了ResNet-50模型的Closed Division(封閉分區(qū))以及BERT模型的Closed Division、Open Division(開放分區(qū))。結(jié)果顯示,與首次提交的MLPerf訓(xùn)練(MLPerf V1.0)結(jié)果相比,對(duì)于計(jì)算機(jī)視覺模型ResNet-50,Graphcore通過軟件優(yōu)化,在IPU-POD16上實(shí)現(xiàn)了24%的性能提升,在IPU-POD64上實(shí)現(xiàn)了41%的性能提升;自然語言處理模型BERT在IPU-POD16上實(shí)現(xiàn)了5%的性能提升,在IPU-POD64上實(shí)現(xiàn)了12%的性能提升。此次MLPerf測試結(jié)果證明了Graphcore的IPU系統(tǒng)越來越強(qiáng)大、高效,軟件日益成熟且更快、更易使用。

Graphcore中國工程總負(fù)責(zé)人、AI算法科學(xué)家金琛指出,本次測試結(jié)果展現(xiàn)的性能顯著提升主要?dú)w功于Graphcore對(duì)軟件的優(yōu)化,涵蓋對(duì)應(yīng)用程序、框架、系統(tǒng)、編譯器、核函數(shù)的優(yōu)化。“這些優(yōu)化在不同模型上都有所體現(xiàn)。大家都知道,很多事情最開始的提升速度最快,但越往后提升越困難,通常需要80%的努力才能獲得20%的提升。Graphcore能獲得這些提升,我們是做了非常多的工作的。”她表示。

Graphcore中國工程總負(fù)責(zé)人、AI算法科學(xué)家金琛

縱向?qū)Ρ龋菏状渭{入系統(tǒng)集群,ResNet-50在IPU-POD256上的訓(xùn)練時(shí)間只需3.79分鐘

除了基于IPU-POD16和IPU-POD64提交的MLPerf V1.0測試,這一次,Graphcore首次納入了系統(tǒng)集群,進(jìn)行了128顆(IPU-POD128)以及256顆(IPU-POD256)IPU集群的提交。如圖所示,ResNet-50在IPU-POD16上的訓(xùn)練時(shí)間(Time to Train)為28.33分鐘,隨著系統(tǒng)的增大,訓(xùn)練時(shí)間逐次遞減——在IPU-POD64上的訓(xùn)練時(shí)間為8.5分鐘,在IPU-POD256上只需3.79分鐘。“希望明年此時(shí),我們能提供更大的集群,讓ResNet-50的訓(xùn)練時(shí)間在1分鐘之內(nèi)完成,這是我們的目標(biāo)。”金琛表示。

上圖顯示的是Graphcore提交的BERT-Large在MLPerf上的性能表現(xiàn)。“我們?cè)贗PU-POD16上的端到端訓(xùn)練,在Closed Division上只需半個(gè)小時(shí)。如果把整個(gè)集群增大8倍,我們的訓(xùn)練時(shí)間不到7分鐘。隨著集群的增加,訓(xùn)練時(shí)間大幅縮短,這會(huì)極大提高算法工程師迭代模型的效率。在Open Division的提交方面,我們?cè)贗PU-POD64上的性能進(jìn)一步提高,原因是IPU得到了優(yōu)化,包括對(duì)訓(xùn)練策略、對(duì)訓(xùn)練優(yōu)化器超參以及對(duì)損失函數(shù)的優(yōu)化。如圖所示,我們基本上另外提高了20%,這非常可觀。這些優(yōu)化我們也應(yīng)用到了一些客戶上,得到了正面反饋。”金琛指出。

橫向?qū)Ρ龋菏状蝺H通過軟件實(shí)現(xiàn)性能提升,IPU-POD16性能優(yōu)于DGX A100

MLPerf同時(shí)對(duì)比了市面上Graphcore與NVIDIA的產(chǎn)品。盡管GPU在ResNet-50模型上占據(jù)優(yōu)勢,測試結(jié)果仍然顯示Graphcore的IPU-POD16在ResNet-50方面的表現(xiàn)優(yōu)于NVIDIA的DGX A100。值得注意的是,這是NVIDIA生態(tài)系統(tǒng)在MLPerf訓(xùn)練測試中的第五次亮相,而Graphcore是第二次提交。Graphcore的這次提交也是其首次僅通過軟件實(shí)現(xiàn)了性能提升。在ResNet-50上,IPU-POD16首次超越了DGX A100的性能,其端到端的訓(xùn)練時(shí)間只用了28.3分鐘,比DGX A100快了近一分鐘。

如文章首段所提,IPU-POD16對(duì)ResNet-50的軟件驅(qū)動(dòng)性能提高了24%,在IPU-POD64上對(duì)ResNet-50的軟件驅(qū)動(dòng)性能提升甚至更高,達(dá)到41%,對(duì)于Graphcore具有里程碑式的意義。在金琛看來,NVIDIA的軟件庫已經(jīng)迭代許久,提升的空間可能會(huì)有所減緩。Graphcore會(huì)持續(xù)迭代、優(yōu)化自身的軟件棧及整個(gè)AI系統(tǒng),久久為功、保持勢頭,不斷提升性能優(yōu)勢。“僅通過兩次MLPerf的提交,我們就能夠在GPU最主流的模型上超過GPU,這是讓我們非常自豪的一件事,而且Graphcore在未來還有更大的提升空間。”Graphcore大中華區(qū)總裁兼全球首席營收官盧濤補(bǔ)充道,“以前我們一直強(qiáng)調(diào)IPU是一個(gè)極具創(chuàng)新的平臺(tái),適合做一些新的應(yīng)用,幫助創(chuàng)新者完成他們?cè)?jīng)達(dá)成不了的任務(wù)。這次的測試結(jié)果證明IPU確實(shí)能在已經(jīng)成為主流的應(yīng)用上落地,能落地則意味著可觀的商業(yè)回報(bào),這也是對(duì)行業(yè)而言比較重要的一個(gè)影響。”

Graphcore大中華區(qū)總裁兼全球首席營收官盧濤

大規(guī)模集群性能擁有強(qiáng)大優(yōu)勢

本次Graphcore提交的集群是IPU-POD128和IPU-POD256。除了IPU-POD16和IPU-POD64的時(shí)間優(yōu)勢之外,IPU-POD128和IPU-POD256此次能取得優(yōu)異成績主要在于其軟件的可擴(kuò)展性。“我們?cè)谠O(shè)計(jì)軟件的過程中考慮了很多因素,比如大量優(yōu)化模型變形、數(shù)據(jù)變形、Kernel變形。同時(shí),我們擁有非常細(xì)致的設(shè)計(jì)思路,讓用戶只需要寫一個(gè)腳本、配置數(shù)據(jù)Replica的個(gè)數(shù),就可以很自如地進(jìn)行從1個(gè)IPU到256個(gè)IPU的橫向擴(kuò)展。”金琛指出,“除了在框架層面進(jìn)行橫向擴(kuò)展,我們也在通信庫上做了很大一部分優(yōu)化。這方面的優(yōu)化會(huì)為深度學(xué)習(xí)以及數(shù)據(jù)并行的深度學(xué)習(xí)帶來顯著影響。關(guān)于BERT-Large訓(xùn)練中5%和12%的提升很大程度上源于我們對(duì)通信庫的改進(jìn)。”

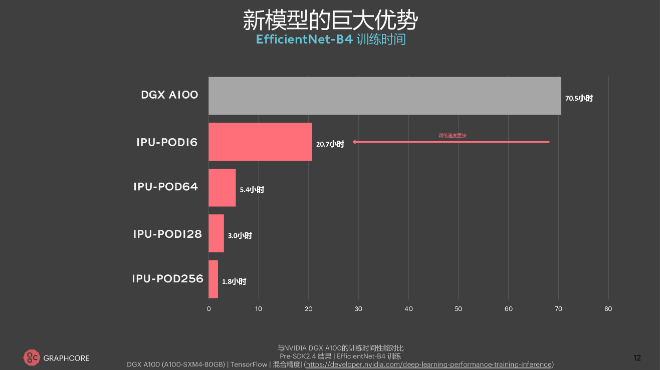

據(jù)介紹,Graphcore的系統(tǒng)擴(kuò)展可以應(yīng)用在更廣泛的應(yīng)用場景之中,包括用于自然語言處理的GPT類模型和用于計(jì)算機(jī)視覺的ViT(Transformer視覺模型)。“我們的系統(tǒng)軟件設(shè)計(jì)及優(yōu)化對(duì)新模型、新架構(gòu)均非常適用。IPU系統(tǒng)可以非常平滑地從16個(gè)IPU一直擴(kuò)展到256個(gè)IPU。”金琛表示。

以創(chuàng)新的計(jì)算機(jī)視覺模型EfficientNet-B4為例,DGX A100端到端的訓(xùn)練時(shí)間為70.5小時(shí)(官網(wǎng)數(shù)據(jù)),而IPU-POD16端到端的訓(xùn)練時(shí)間是20.7個(gè)小時(shí),前者約為后者的3.5倍。隨著系統(tǒng)的增大,時(shí)間逐漸縮短,EfficientNet-B4在IPU-POD256上的訓(xùn)練時(shí)間僅為1.8小時(shí)。“盡管這并非Graphcore本次向MLPerf提交的內(nèi)容,但我們的大規(guī)模集群在實(shí)際應(yīng)用中的確具備更強(qiáng)的性能優(yōu)勢。原來4天的訓(xùn)練時(shí)間現(xiàn)在只需2個(gè)小時(shí),這會(huì)大大解放開發(fā)者的生產(chǎn)力,是我們大集群非常大的一個(gè)吸引力。”金琛解釋。

“我們第一版IPU-POD的硬件是在2020年的12月份宣布量產(chǎn)的。一年內(nèi)的硬件集群的增加、軟件的優(yōu)化,使得我們此次在IPU-POD256上的ResNet性能相較去年年底在IPU-POD16上的ResNet性能提高了50倍,這是一個(gè)非常大的飛躍。”盧濤認(rèn)為,“我們的生態(tài)在過去半年中也取得了長足進(jìn)步,擁有越來越多跨行業(yè)的商業(yè)用戶、商業(yè)案例研究,例如天氣預(yù)測、金融、保險(xiǎn)、電信。”

回顧2021,盧濤指出,其自身遇到的最大的挑戰(zhàn)可以用三個(gè)字來形容——“周期比預(yù)期要長”。不過,正如錘煉一柄傳世寶劍,以精益求精之決心,歷經(jīng)千錘百煉后才能鍛造出去雜存精的好劍。鑄劍的過程是痛苦的,但寶劍內(nèi)在美好的本質(zhì)會(huì)被錘煉出來。這時(shí),挑戰(zhàn)亦為收獲。“2021年我們確實(shí)扎根產(chǎn)業(yè),著力落地應(yīng)用場景,但整體來說,AI應(yīng)用場景落地的整個(gè)鏈條很長,因此把整個(gè)方案變?yōu)橐粋€(gè)產(chǎn)品是個(gè)挑戰(zhàn)。”盧濤告訴記者。

兼具通用性與高性能,IPU發(fā)展經(jīng)歷了“熱鬧的2021”,將迎來“美好的2022”

在盧濤看來,2021年IPU的市場環(huán)境存在兩個(gè)特點(diǎn):第一是應(yīng)用落地時(shí)間長于預(yù)期;第二是市場對(duì)IPU的期望強(qiáng)于預(yù)期。“今年年底時(shí),我們發(fā)現(xiàn)市場的動(dòng)能、慣性以及活躍程度,比年初時(shí)更為看好。這背后的原因在于多種因素組合所帶來的積極推動(dòng)作用,例如用戶對(duì)市場、對(duì)自己應(yīng)用的認(rèn)知,對(duì)市場上各類處理器的認(rèn)知,還有我們自身框架、應(yīng)用、生態(tài)以及落地場景等方面的進(jìn)展。隨著更多資金的投入,2021年的市場環(huán)境將比2020年更為熱鬧。”盧濤告訴記者。

他指出,無論從計(jì)算機(jī)的體系結(jié)構(gòu)抑或是用戶角度來講,IPU都極具通用性:“從指令級(jí)、架構(gòu)上來看,IPU能夠進(jìn)行所有AI相關(guān)的業(yè)務(wù),從CNN、RNN到LSTM,再到Transformer,所以IPU的通用性毫無疑問。假如不講計(jì)算機(jī)的體系結(jié)構(gòu),用戶判斷產(chǎn)品的通用與否主要依據(jù)以下兩點(diǎn):第一、產(chǎn)品是否能開發(fā)出各種各樣的應(yīng)用。如果不同的應(yīng)用都能開發(fā),那么對(duì)用戶而言它就通用。第二、對(duì)開發(fā)者來說,產(chǎn)品是否便于針對(duì)各種應(yīng)用進(jìn)行編程。如果能夠編程,那么對(duì)開發(fā)者而言它就通用。所以從這兩個(gè)維度來看,IPU是一個(gè)非常通用的產(chǎn)品。”

除此之外,高性能也是IPU吸引用戶的關(guān)鍵因素。據(jù)介紹,在金融案例中,Graphcore的IPU產(chǎn)品比GPU快10倍;在保險(xiǎn)算法模型方面,IPU比GPU快5倍;天氣預(yù)測方面,歐洲案例證明IPU比CPU快50倍、比GPU快5倍;中國目前的場景顯示IPU能夠比CPU快60倍。“最近,斯坦福大學(xué)醫(yī)學(xué)院在差分隱私的使用方面取得了重大突破。通過使用Graphcore IPU,斯坦福團(tuán)隊(duì)能夠?qū)⒕哂胁罘蛛[私的人工智能訓(xùn)練速度提高10倍以上。IPU支持隱私計(jì)算非常吸引他們。”盧濤補(bǔ)充。

談及IPU的技術(shù)發(fā)展趨勢,盧濤指出以下三點(diǎn):

第一,“Transformer-based everything”(基于Transformer的一切);

2017年,谷歌團(tuán)隊(duì)首先提出Transformer模型,該模型最初被應(yīng)用于NLP領(lǐng)域,成效卓著。如今在計(jì)算機(jī)視覺領(lǐng)域、對(duì)話和語音領(lǐng)域,Transformer同樣表現(xiàn)優(yōu)異。隨著GPT-2、GPT-3、AlphaStar等更多大模型重要成果的顯現(xiàn),Transformer預(yù)計(jì)會(huì)為更多領(lǐng)域帶來革新。

第二,應(yīng)用規(guī)模會(huì)越來越大、越來越復(fù)雜;

“之前大家比較關(guān)注單一的視覺任務(wù)和語音任務(wù),后來AI又能應(yīng)用于文字、語言、視頻、圖像,更加復(fù)雜,所謂稱之為‘多模態(tài)’,這是一個(gè)重要趨勢。”盧濤做出解釋。

第三,AI融合科學(xué)計(jì)算。

盧濤表示,目前AI正在從互聯(lián)網(wǎng)、自動(dòng)駕駛等熱門場景向與傳統(tǒng)科學(xué)計(jì)算相結(jié)合的方向發(fā)展。例如DeepMind今年發(fā)布的AlphaFold(蛋白質(zhì)方面的科學(xué)研究)、AI用于天氣預(yù)測、宇宙學(xué)研究、分子動(dòng)力學(xué)仿真等等。

基于此,盧濤表示,2022年Graphcore會(huì)相應(yīng)地在三點(diǎn)進(jìn)行發(fā)力:

第一,加大基于Transformer的應(yīng)用上的投入。

ResNet于2016年10月發(fā)明,BERT于2018年10月出現(xiàn)。因此,自2016年5月成立以來,Graphcore在基于Transformer的應(yīng)用方面呈持續(xù)追趕態(tài)勢。“我們處于追趕當(dāng)前市場霸主的位置,別人已經(jīng)打磨很久了、做了大量的優(yōu)化和工作。”盧濤表示,“即便這樣,我們甚至只跟目前產(chǎn)業(yè)最領(lǐng)先的企業(yè)在transformer上只有三個(gè)月的差距。所以我們會(huì)在Transformer-based everything方面加大投入。”

第二,混合語言、語音、視頻、圖片,用AI進(jìn)行更復(fù)雜的應(yīng)用。

第三,加大對(duì)AI與高性能計(jì)算、科學(xué)計(jì)算融合的投入。

企業(yè)的技術(shù)提升離不開人才建設(shè),因此Graphcore也會(huì)持續(xù)加強(qiáng)人才儲(chǔ)備。2021年初,Graphcore中國團(tuán)隊(duì)只有20人左右,截至目前,團(tuán)隊(duì)人數(shù)增長四倍,達(dá)到80人。從全球來看,公司總?cè)藬?shù)也從年初的400多人增長至如今的600多人。據(jù)了解,隨著AI在科學(xué)計(jì)算上的應(yīng)用逐漸普適化,Graphcore也會(huì)在科學(xué)計(jì)算方面儲(chǔ)備人才。“天氣預(yù)測、分子動(dòng)力學(xué)等領(lǐng)域會(huì)給國計(jì)民生帶來深遠(yuǎn)影響,所以不光在深度學(xué)習(xí),我們也會(huì)在高性能計(jì)算領(lǐng)域與大家一同開拓創(chuàng)新。”金琛告訴記者。“我們會(huì)腳踏實(shí)地,認(rèn)真務(wù)實(shí),相信Graphcore‘?dāng)M未’會(huì)有更美好的未來。”盧濤在最后總結(jié)。