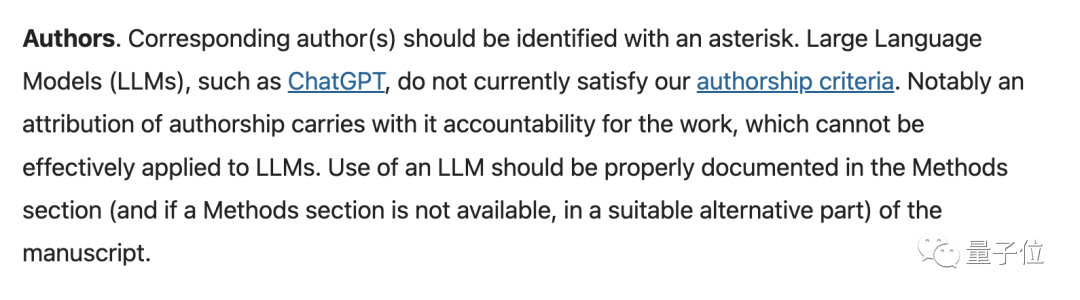

本周,這家權(quán)威學(xué)術(shù)出版機(jī)構(gòu)下場,針對 ChatGPT 代寫學(xué)研文章、被列為作者等一系列問題,給了定性。

具體來說,Nature 列出兩項(xiàng)原則:

(1)任何大型語言模型工具(比如 ChatGPT)都不能成為論文作者;

(2)如在論文創(chuàng)作中用過相關(guān)工具,作者應(yīng)在“方法”或“致謝”或適當(dāng)?shù)牟糠置鞔_說明。

現(xiàn)在,上述要求已經(jīng)添進(jìn)作者投稿指南中。

近段時間,ChatGPT 染指學(xué)研圈情況越來越多。

去年 12 月一篇雷帕霉素抗衰老應(yīng)用的論文中,ChatGPT 就曾被列為一作,引發(fā)業(yè)內(nèi)爭議。該篇之外,還有不少研究將 ChatGPT 列為作者。

Nature 也已注意到此類狀況,他們于 12 月進(jìn)行了一項(xiàng)調(diào)研顯示,293 名受訪的教授老師中,20% 已經(jīng)發(fā)覺或目睹學(xué)生在用 ChatGPT 完成作業(yè)或論文,更多人對此表示擔(dān)憂。

此次,Nature 所發(fā)表的聲明,正是希望對種種爭議給予定性。

多篇論文已將 ChatGPT 列為作者

ChatGPT 由 OpenAI 在去年 11 月末推出,因其表現(xiàn)大幅超越此前大型語言模型(LLM),迅速成為歲末年初第一號“竄天猴”。

在新媒體、影視、軟件開發(fā)、游戲互動等領(lǐng)域中,ChatGPT 被迅速加以利用,輔助生產(chǎn)提升效能。

學(xué)研圈也不例外。

據(jù) Nature 統(tǒng)計,使用 ChatGPT 并將其列為作者的論文最少有 4 篇。

其中一篇預(yù)印本在 2022 年 12 月發(fā)表于醫(yī)學(xué)預(yù)印本資料庫 medRxiv 上。該論文研究了 ChatGPT 在美國醫(yī)學(xué)執(zhí)照考試中的表現(xiàn)。盡管研究關(guān)于 ChatGPT,但作者欄中也列上了 ChatGPT。

另一篇論文發(fā)表在《護(hù)士教育實(shí)踐》雜志上,關(guān)于開放人工智能平臺在護(hù)理教育中的利弊,同樣,ChatGPT 被列入作者欄:

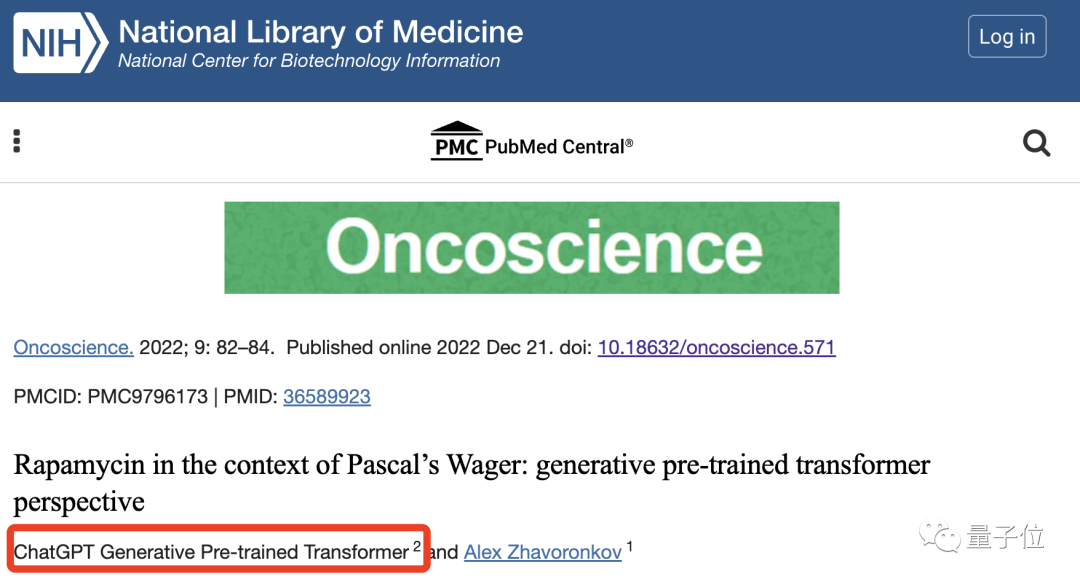

第三篇論文來自 AI 藥物研發(fā)公司 Insilico Medicine,內(nèi)容關(guān)于一種新藥雷帕霉素,發(fā)表于《Oncoscience》。同樣,ChatGPT 被列為作者。

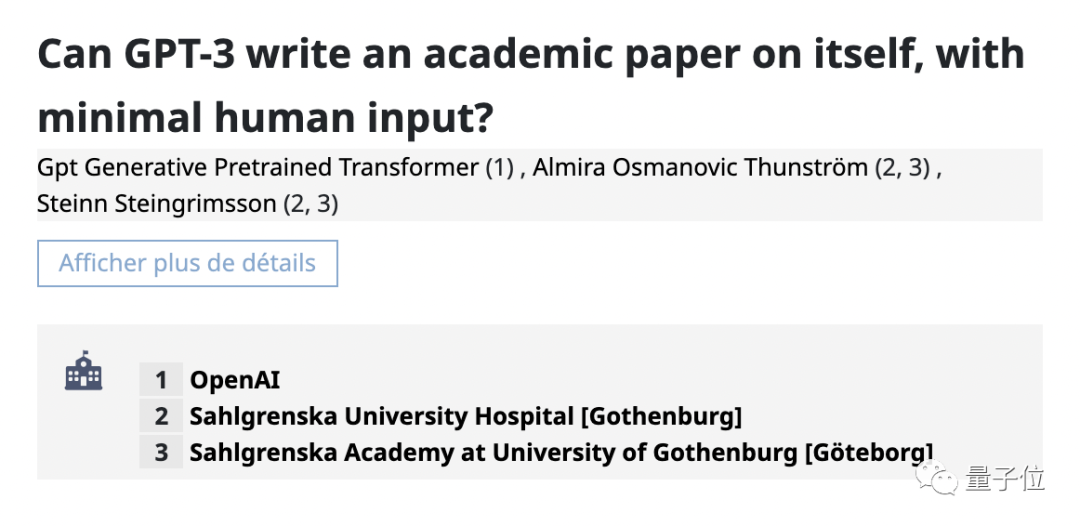

第四篇稍顯“古早”,發(fā)表于 2022 年 6 月,探討主題就是 ——AI 生成論文的能力如何。被列入作者一欄的 AI 也并非 ChatGPT,而是更早發(fā)布的 GPT-3。

盡管上述研究內(nèi)容多少都與生成語言模型有關(guān),但對于嚴(yán)肅的科研活動來說,使用“研究對象”寫論文,并將其列入作者欄,不可避免引發(fā)了爭議和質(zhì)疑。

且即便不將 AI 列為作者,學(xué)研圈使用 ChatGPT 的情況也越來越普遍。

前文提及 AI 藥物研發(fā)公司 Insilico Medicine 的 CEO,Alex Zhavoronkov,他透露道,其所在的機(jī)構(gòu)已發(fā)表了 80 多篇由 AI 工具生成的論文。

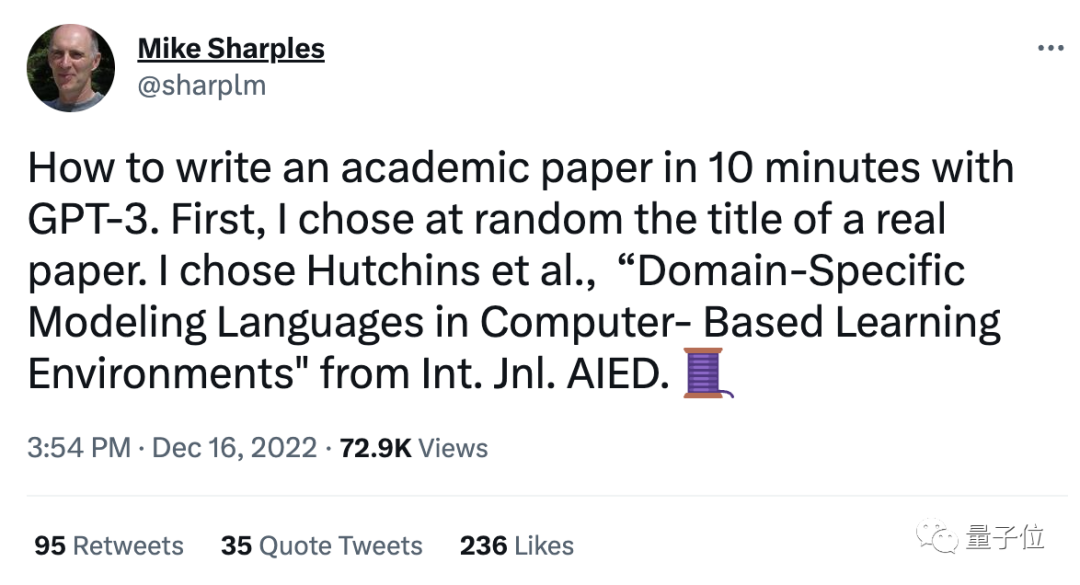

英國教授 Mike Sharples 一直關(guān)注生成 AI 對學(xué)術(shù)研究的影響。不久前,他在推特上親手演示了如何用大型語言模型 10 分鐘生成一篇學(xué)術(shù)論文,一步步描述自己如何用 AI 根據(jù)標(biāo)題生成摘要,也引發(fā)不小討論。

學(xué)生使用 ChatGPT 幫助撰寫論文、生成代碼、完成作業(yè)更為普遍,目前,美國已有部分地區(qū)教育機(jī)構(gòu)禁止使用該工具。

就在上周,北密歇根大學(xué)一位學(xué)生依靠 ChatGPT 寫出全班最高分論文。

有意思的是,該學(xué)生之所以被抓住,是因?yàn)樗峤晃恼逻壿嬤^于連貫,結(jié)構(gòu)過于合理,以至于導(dǎo)師專門去質(zhì)問了一下才得知真相。

△ 北密歇根大學(xué)

需要明確的是,上述抓包只是偶然,更多時候,生成內(nèi)容已讓科學(xué)家們真假難辨。

Nature 此前一篇文章指出,ChatGPT 發(fā)布后,伊利諾伊州西北大學(xué)一個研究小組就在探究,使用該 AI 工具生成醫(yī)學(xué)論文摘要,科學(xué)家是否能識別。

結(jié)果發(fā)現(xiàn),AI 生成摘要均通過了抄襲檢測器,在人工審核中,32% 的 AI 生成摘要被認(rèn)為是真實(shí)人類完成的。

已在開發(fā)辨別工具

此番 Nature 下場,表明了他們對 ChatGPT 引發(fā)問題的重視。

在最新內(nèi)容中,Nature 表示,學(xué)研圈都在擔(dān)心,學(xué)生及研究者們可能會以大型語言模型生成的內(nèi)容當(dāng)作本人撰寫的文本,除卻冒用風(fēng)險外,上述過程還會產(chǎn)生不可靠的研究結(jié)論。

尤其針對 ChatGPT,Nature 團(tuán)隊(duì)及很多出版商、平臺均認(rèn)為,該工具無法對科學(xué)論文的完整性及內(nèi)容本身負(fù)責(zé)。

一個側(cè)面佐證是科技媒體 CNET 這兩天曝出,該平臺 AI 編寫的 77 篇內(nèi)容中,41 篇有錯誤,目前,平臺已予以更正,并表示將暫停此種方式生產(chǎn)內(nèi)容。

正是基于對上述情況的擔(dān)憂,Nature 出臺了相關(guān)規(guī)定。

至于如何分辨 AI 生成內(nèi)容?

Nature 表示,目前 ChatGPT 原始輸出可以通過仔細(xì)檢查而被發(fā)現(xiàn),尤其涉及具體科學(xué)工作時,內(nèi)容可能包含最簡單的錯誤及泛泛乏味的措辭。此外,Nature 也表示,他們還在開發(fā)相關(guān)識別技術(shù)。

值得一提的是,相關(guān)識別工具也有人開發(fā)出來了。

比如 OpenAI 自己推出的 GPT-2 Output Detector,輸入 50 個以上字符(tokens)就能較準(zhǔn)確地識別 AI 生成的文本。

再比如普林斯頓大學(xué)生 Edward Tian,也做出過相關(guān)工具 GPTZero。

不過,并非所有大學(xué)教授和老師對 AI 生成工具持否定態(tài)度。

比如賓大沃頓商學(xué)院一位教授 Ethan Mollick,反其道而要求學(xué)生使用 ChatGPT 完成課堂作業(yè),并認(rèn)為這是在擁抱新興技術(shù)工具。

論文發(fā)表平臺 medRxiv 一位工作者也表示,ChatGPT 也不算新麻煩。

他認(rèn)為,此前,研究者都嘗試偷偷加入寵物、虛構(gòu)人物名字。因此,他們認(rèn)為,問題核心是 —— 需要繼續(xù)加強(qiáng)檢查。

最后問問,你在科研工作中用了 ChatGPT 么?

參考鏈接:

[1]https://www.nature.com/articles/d41586-023-00191-1

[2]https://www.nature.com/articles/d41586-023-00056-7

[3]https://www.nature.com/articles/d41586-023-00204-z

[4]https://www.theverge.com/2023/1/26/23570967/chatgpt-author-scientific-papers-springer-nature-ban

[5]https://www.businessinsider.com/wharton-mba-professor-requires-students-to-use-chatgpt-ai-cheating-2023-1

本文來自微信公眾號:量子位 (ID:QbitAI),作者:詹士

更多信息可以來這里獲取==>>電子技術(shù)應(yīng)用-AET<<