過去兩年,AI 領域里已經出現(xiàn)大量大型生成模型,如 ChatGPT 或 Stable Diffusion。具體而言,這些模型能夠執(zhí)行像通用問答系統(tǒng)或自動創(chuàng)建藝術圖像等任務,這些任務正在徹底改變很多領域。

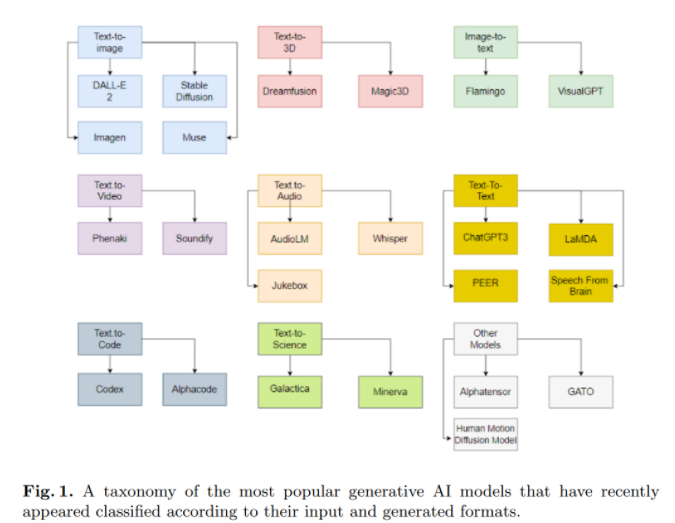

從目前的發(fā)展來看,這些生成模型對行業(yè)和社會的影響是巨大的,因為一些工作崗位可能會發(fā)生改變。例如,Generative AI 能夠有效且創(chuàng)造性地將文本轉換為圖像,如 DALLE-2 模型;把文本轉成 3D 圖像,如 Dreamfusion 模型;把圖像轉成文本,如 Flamingo 模型;把文本轉成視頻,如 Phenaki 模型;把文本轉成音頻,如 AudioLM 模型;把文本轉成代碼,如 Codex 模型;把文本轉成科學論文,如 Galactica 模型;甚至創(chuàng)建算法的模型,如 AlphaTensor。

在近日由西班牙 Comillas Pontifical University 研究人員提交的綜述論文中,作者試圖以簡潔的方式描述生成式 AI 對當前很多模型的影響,并對最近發(fā)布的主要生成式 AI 模型進行分類。

論文《ChatGPT is not all you need. A State of the Art Review of large Generative AI models》:

鏈接:https://arxiv.org/abs/2301.04655

為向可能因使用這些模型而受益的專業(yè)人士提供有效信息,作者按如下結構組織文章。首先,作者提供行業(yè)中出現(xiàn)的主要生成式模型的分類。接著對每個類別進行分析。最后,本文會給出相關結論和未來要做的工作。文章中作者沒有詳細介紹每個模型的技術細節(jié),如 Transformer,因為文章的目的是研究模型的應用,而不是研究它們的工作原理。

生成式 AI 模型的分類

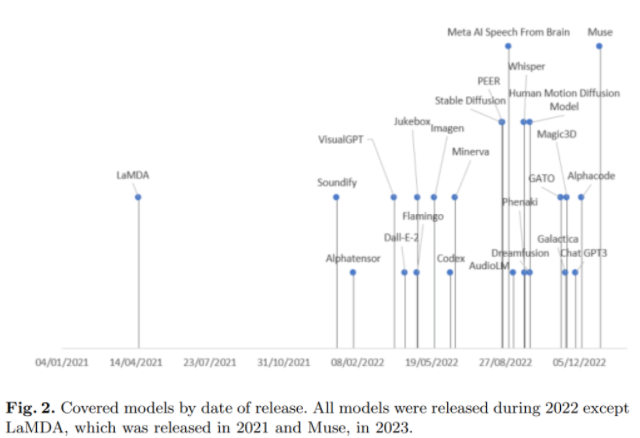

在詳細分析每個模型之前,首先將當前的生成式 AI 進行分類,類別代表輸入數(shù)據(jù)和輸出數(shù)據(jù)類型之間的映射。如圖 1 所示。作者總共總結 9 個類別,其中每個出現(xiàn)在圖 1 中的模型將在之后詳細描述。由于文章主要關注點是描述生成式 AI 模型的最新進展,為讓讀者能有整體認識,在圖 2 中給出了所有已發(fā)布的模型。

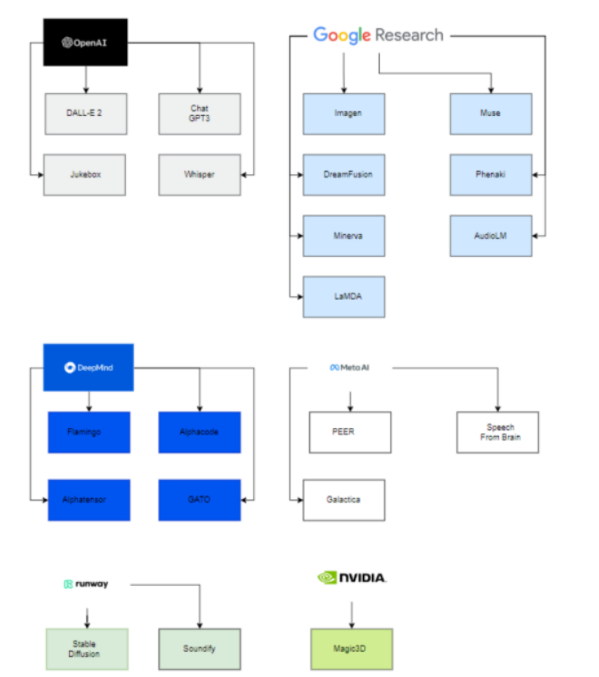

有趣的是,所有這些模型僅由 6 個公司發(fā)布,如圖 3 所示。背后的主要原因是為能夠估計這些模型的參數(shù),必須擁有巨大的計算能力以及在數(shù)據(jù)科學和數(shù)據(jù)工程方面技術精湛、經驗豐富的團隊。因此,只有圖 3 所示的公司,在收購的初創(chuàng)公司的努力下以及與學術界的合作,才能夠成功發(fā)布生成式 AI 模型。

到此已經介紹了最新的生成式 AI 模型,接下來的部分將詳細介紹圖 1 中所示每個類別。

隨著技術的進步,我們已經在文本到圖像或文本到音頻等任務中看到了大量的創(chuàng)造力和個性化。它們在文本到科學或文本到代碼的任務中也很準確。這可以在很大程度上提升我們的自動化水平,因為它可以幫助優(yōu)化創(chuàng)造性和非創(chuàng)造性任務。

然而,由于目前構建它們的方式,這些模型面臨著許多限制。在數(shù)據(jù)集方面,找到一些模型的數(shù)據(jù),如文本到科學或文本到音頻非常困難,使得訓練模型非常耗時。特別需要提到的是,數(shù)據(jù)集和參數(shù)必須非常龐大,這使得訓練變得更加困難。模型最大的問題之一是從數(shù)據(jù)集中的問題中嘗試獲得解決方案,而模型在解決這些問題時遇到了更多麻煩。同樣,在計算方面,運行它們需要大量的時間和算力。

我們應該意識到這些模型的局限性,以便在接下來的幾年中嘗試和改進它們。

更多細節(jié)請參見原論文。

更多信息可以來這里獲取==>>電子技術應用-AET<<