摘要

隨著人工智能(AI)技術的快速發(fā)展,AI可以越來越多地支持以前無法實現(xiàn)或者難以實現(xiàn)的應用。本系列文章基于此解釋了卷積神經網絡(CNN)及其對人工智能和機器學習的意義。CNN是一種能夠從復雜數據中提取特征的強大工具,例如識別音頻信號或圖像信號中的復雜模式就是其應用之一。本文討論了CNN相對于經典線性規(guī)劃的優(yōu)勢,后續(xù)文章《訓練卷積神經網絡:什么是機器學習?——第二部分》將討論如何訓練CNN模型,系列文章的第三部分將討論一個特定用例,并使用專門的AI微控制器對模型進行測試。

什么是卷積神經網絡?

神經網絡是一種由神經元組成的系統(tǒng)或結構,它使AI能夠更好地理解數據,進而解決復雜問題。雖然神經網絡有許多種類型,但本系列文章將只關注卷積神經網絡(CNN),其主要應用領域是對輸入數據的模式識別和對象分類。CNN是一種用于深度學習的人工神經網絡。這種網絡由輸入層、若干卷積層和輸出層組成。卷積層是最重要的部分,它們使用一組獨特的權重和濾波器,使得網絡可以從輸入數據中提取特征。數據可以是許多不同的形式,如圖像、音頻和文本。這種提取特征的過程使CNN能夠識別數據中的模式從而讓工程師能夠創(chuàng)建更有效和高效的應用。為了更好地理解CNN,我們首先將討論經典的線性規(guī)劃。

經典控制技術中的線性規(guī)劃

控制技術的任務是借助傳感器讀取數據并進行處理,然后根據規(guī)則做出響應,最后顯示或發(fā)送結果。例如,溫度調節(jié)器每秒鐘測量一次溫度,通過微控制器單元(MCU)讀取溫度傳感器的數據。該數值用于閉環(huán)控制系統(tǒng)的輸入,并與設定的溫度進行比較。這就是一個借助MCU執(zhí)行線性規(guī)劃的例子,這種技術通過比較預編程值和實際值來給出明確的結論。相比之下, AI系統(tǒng)通常依據概率論來發(fā)揮作用。

復雜模式和信號處理

許多應用所使用的輸入數據必須首先由模式識別系統(tǒng)加以判別。模式識別可以應用于不同的數據結構。本文討論的例子限定為一維或二維的數據結構,比如音頻信號、心電圖(ECG)、光電容積脈搏波(PPG)、一維的振動數據或波形、熱圖像、二維的瀑布圖數據。

在上述模式識別中,將應用通過MCU的代碼來實現(xiàn)是極其困難的。一個例子是識別圖像中的具體對象(例如貓):這種情況下無法區(qū)分要分析的圖像是很早攝錄的,還是剛剛由從相機讀取的。分析軟件基于一些特定的規(guī)則來判斷圖片中是否有貓:比如說貓必須有典型的尖耳朵、三角形的鼻子和胡須。如果可以在圖像中識別出這些特征,軟件便可以報告在圖像中發(fā)現(xiàn)了貓。但是這存在一些問題:如果圖像只顯示了貓的背面,模式識別系統(tǒng)會怎么辦?如果貓沒有胡須或者在事故中失去了腿,會發(fā)生什么?盡管這些異常情況不太可能出現(xiàn),但模式識別的代碼將不得不考慮所有可能的異常情況,從而增加大量額外的規(guī)則。即使在這個簡單的例子中,軟件設置的規(guī)則也會變得非常復雜。

機器學習如何取代經典規(guī)則

AI背后的核心思想是在小范圍內模仿人類進行學習。它不依賴于制定大量的if-then規(guī)則,而是建立一個通用的模式識別的機器模型。這兩種方法的關鍵區(qū)別在于,與一套復雜的規(guī)則相比,AI不會提供明確的結果。AI不會明確報告“我在圖像中識別出了一只貓”,而是提供類似這樣的結論:“圖像中有一只貓的概率為97.5%,它也可能是豹子(2.1%)或老虎(0.4%)。”這意味著在模式識別的過程結束時,應用的開發(fā)人員必須通過決策閾值做出決定。

另一個區(qū)別是AI并不依賴固定的規(guī)則,而是要經過訓練。訓練過程需要將大量貓的圖像展示給神經網絡以供其學習。最終,神經網絡將能夠獨立識別圖像中是否有貓。關鍵的一點是,未來AI可以不局限于已知的訓練圖像開展識別。該神經網絡需要映射到MCU中。

AI的模式識別內部到底是什么?

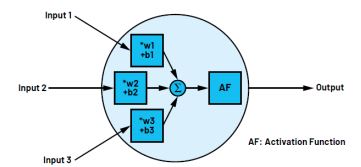

AI的神經元網絡類似于人腦的生物神經元網絡。一個神經元有多個輸入,但只有一個輸出。基本上,這些神經元都是輸入的線性變換——將輸入乘以數字(權重w)并加上一個常數(偏置b),然后通過一個固定的非線性函數產生輸出,該函數也被稱為激活函數。作為網絡中唯一的非線性部分,激活函數用于定義人工神經元值的激活范圍。神經元的功能在數學上可以描述為

其中,f 為激活函數,w為權重,x為輸入數據,b為偏置。數據可以是單獨的標量、向量或矩陣。圖1顯示了一個神經元,它擁有三個輸入和一個激活函數ReLU。網絡中的神經元總是分層排列的。

圖1.擁有三個輸入和一個輸出的神經元

如上所述,CNN用于輸入數據的模式識別和對象分類。CNN分為不同的部分:一個輸入層、若干隱藏層和一個輸出層。圖2顯示了一個小型網絡,它包含一個具有三個輸入的輸入層、一個具有五個神經元的隱藏層和一個具有四個輸出的輸出層。所有神經元的輸出都連接到下一層的所有輸入。圖2所示的網絡不具有現(xiàn)實意義,這里僅用于演示說明。即使對于這個小型網絡,用于描述網絡的方程中也具有32個偏置和32個權重。

CIFAR神經網絡是一種廣泛用于圖像識別的CNN。它主要由兩種類型的層組成:卷積層和池化層,這兩種層分別使用卷積和池化兩種方法,在神經網絡的訓練中非常有效。卷積層使用一種被稱為卷積的數學運算來識別像素值數組的模式。卷積發(fā)生在隱藏層中,如圖3所示。卷積會重復多次直至達到所需的精度水平。如果要比較的兩個輸入值(本例是輸入圖像和濾波器)相似,那么卷積運算的輸出值總會特別高。濾波器有時也被稱為卷積核。然后,結果被傳遞到池化層提取特征生成一個特征圖,表征輸入數據的重要特征,稱為池化。池化層的運行需要依賴另一個濾波器,稱為池化濾波器。訓練后,在網絡運行的狀態(tài)下,特征圖與輸入數據進行比較。由于特征圖保留了特定的特征,所以只有當內容相似時,神經元的輸出才會被觸發(fā)。通過組合使用卷積和池化,CIFAR網絡可用于高精度地識別和分類圖像中的各種對象。

圖2.一個小型神經網絡

CIFAR-10是一個特定數據集,通常用于訓練CIFAR神經網絡。它由60000幅32×32彩色圖像組成,分為10個類別。這些圖像是從各種來源收集的,例如網頁、新聞和個人圖像集。每個類別包含6000幅圖像,平均分配在訓練集、測試集和驗證集中,使其成為測試計算機視覺和其他機器學習模型的理想圖像集。

卷積神經網絡和其他類型網絡的主要區(qū)別在于處理數據的方式。卷積神經網絡通過濾波依次檢查輸入數據的屬性。卷積層的數量越多,可以識別的細節(jié)就越精細。在第一次卷積之后,該過程從簡單的對象屬性(如邊或點)開始進行第二次卷積以識別詳細的結構,如角、圓、矩形等。在第三次卷積之后,特征就可以表示某些復雜的模式,它們與圖像中對象的某些部分相似,并且對于給定對象來說通常是唯一的。在我們最初的例子中,這些特征就是貓的胡須或耳朵。特征圖的可視化(如圖4所示)對于應用本身而言并不是必需的,但它有助于幫助理解卷積。

即使是像CIFAR這樣的小型網絡,每層也有數百個神經元,并且有許多串行連接的層。隨著網絡的復雜度和規(guī)模的增加,所需的權重和偏置數量也迅速增長。圖3所示的CIFAR-10示例已經有20萬個參數,每個參數在訓練過程中都需要一組確定的值。特征圖可以由池化層進一步處理,以減少需要訓練的參數數量并保留重要信息。

圖4.CNN的特征圖

如上所述,在CNN中的每次卷積之后,通常會發(fā)生池化,在一些文獻中也常被稱為子采樣。它有助于減少數據的維度。圖4中的特征圖里面的很多區(qū)域包含很少甚至不含有意義的信息。這是因為對象只是圖像的一小部分,并不構成整幅圖像。圖像的其余部分未在特征圖中使用,因此與分類無關。在池化層中,池化類型(最大值池化或均值池化)和池化窗口矩陣的大小均被指定。在池化過程中,窗口矩陣逐步在輸入數據上移動。例如,最大值池化會選取窗口中的最大數據值而丟棄其它所有的值。這樣,數據量不斷減少,最終形成各個對象類別的唯一屬性。

圖3.用CIFAR-10數據集訓練的CIFAR網絡模型

卷積和池化的結果是大量的二維矩陣。為了實現(xiàn)我們真正的目標即分類,我們需要將二維數據轉換成一個很長的一維向量。轉換是在所謂的壓平層中完成的,隨后是一個或兩個全連接層。全連接層的神經元類似于圖2所示的結構。神經網絡最后一層的輸出要與需要區(qū)分的類別的數量一致。此外,在最后一層中,數據還被歸一化以產生一個概率分布(97.5%的貓,2.1%的豹,0.4%的虎,等等)。

這就是神經網絡建模的全過程。然而,卷積核與濾波器的權重和內容仍然未知,必須通過網絡訓練來確定使模型能夠工作。這將在后續(xù)文章《訓練卷積神經網絡:什么是機器學習?——第二部分》中說明。第三部分將解釋我們上文討論過的神經網絡(例如識別貓)的硬件實現(xiàn),我們將使用ADI公司開發(fā)的帶硬件CNN加速器的MAX78000人工智能微控制器來演示。

------------------------------------

1.通常使用sigmoid、tanh或ReLU函數。

2.ReLU:修正線性單元。對于該函數,輸入值為負時,輸出為零;輸入值大于零時,輸出值為輸入值。

更多精彩內容歡迎點擊==>>電子技術應用-AET<<