近日,來自 MIT 的研究人員發(fā)表了關于大模型能力增速的研究,結果表明,LLM 的能力大約每 8 個月就會翻一倍,速度遠超摩爾定律!硬件馬上就要跟不上啦!

我們人類可能要養(yǎng)不起 AI 了!

近日,來自 MIT FutureTech 的研究人員發(fā)表了一項關于大模型能力增長速度的研究,

結果表明:LLM 的能力大約每 8 個月就會翻一倍,速度遠超摩爾定律!

論文地址:https://arxiv.org/pdf/2403.05812.pdf

LLM 的能力提升大部分來自于算力,而摩爾定律代表著硬件算力的發(fā)展,

——也就是說,隨著時間的推移,終有一天我們將無法滿足 LLM 所需要的算力!

如果那個時候 AI 有了意識,不知道會不會自己想辦法找飯吃?

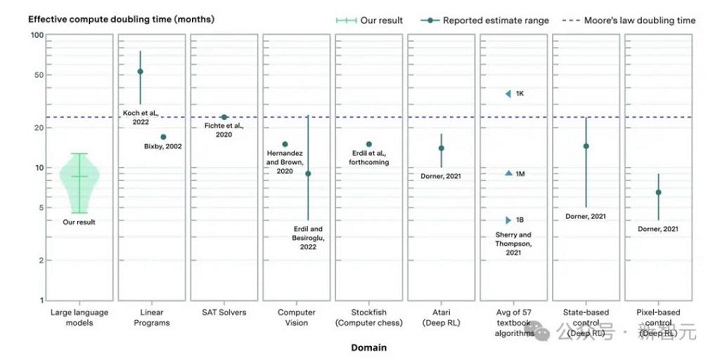

上圖表示不同領域的算法改進對有效計算翻倍的估計。 藍點表示中心估計值或范圍; 藍色三角形對應于不同大小(范圍從 1K 到 1B)的問題的倍增時間; 紫色虛線對應于摩爾定律表示的 2 年倍增時間。

摩爾定律和比爾蓋茨

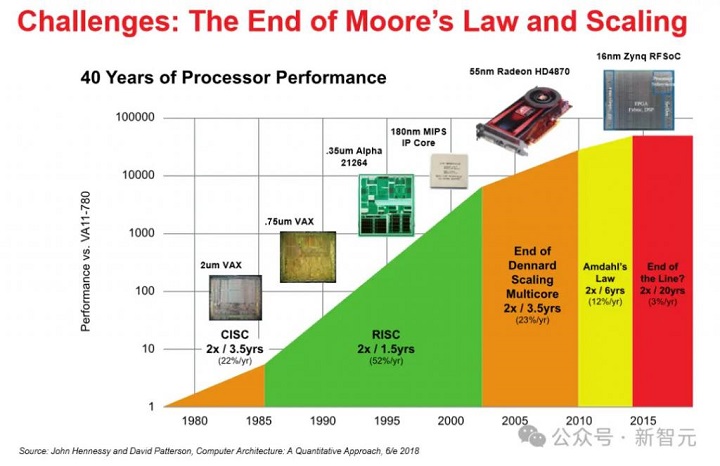

摩爾定律(Moore's law)是一種經(jīng)驗或者觀察結果,表示集成電路(IC)中的晶體管數(shù)量大約每兩年翻一番。

1965 年,仙童半導體(Fairchild Semiconductor)和英特爾的聯(lián)合創(chuàng)始人 Gordon Moore 假設集成電路的組件數(shù)量每年翻一番,并預測這種增長率將至少再持續(xù)十年。

1975 年,展望下一個十年,他將預測修改為每兩年翻一番,復合年增長率(CAGR)為 41%。

雖然 Moore 沒有使用經(jīng)驗證據(jù)來預測歷史趨勢將繼續(xù)下去,但他的預測自 1975 年以來一直成立,所以也就成了 " 定律 "。

因為摩爾定律被半導體行業(yè)用于指導長期規(guī)劃和設定研發(fā)目標,所以在某種程度上,成了一種自我實現(xiàn)預言。

數(shù)字電子技術的進步,例如微處理器價格的降低、內存容量(RAM 和閃存)的增加、傳感器的改進,甚至數(shù)碼相機中像素的數(shù)量和大小,都與摩爾定律密切相關。

數(shù)字電子的這些持續(xù)變化一直是技術和社會變革、生產(chǎn)力和經(jīng)濟增長的驅動力。

不過光靠自我激勵肯定是不行的,雖然行業(yè)專家沒法對摩爾定律能持續(xù)多久達成共識,但根據(jù)微處理器架構師的報告,自 2010 年左右以來,整個行業(yè)的半導體發(fā)展速度已經(jīng)放緩,略低于摩爾定律預測的速度。

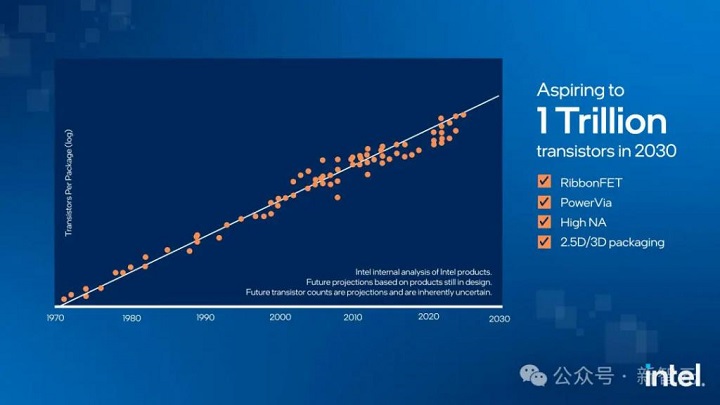

下面是維基百科給出的晶體管數(shù)量增長趨勢圖:

到了 2022 年 9 月,英偉達首席執(zhí)行官黃仁勛直言 " 摩爾定律已死 ",不過英特爾首席執(zhí)行官 Pat Gelsinger 則表示不同意。

從下圖我們可以看出,英特爾還在努力用各種技術和方法為自己老祖宗提出的定律續(xù)命,并表示,問題不大,你看我們還是直線沒有彎。

Andy and Bill's Law

關于算力的增長,有一句話是這樣說的:" 安迪給的,比爾都拿走(What Andy giveth, Bill taketh away)"。

這反映了當時的英特爾首席執(zhí)行官 Andy Grove 每次向市場推出新芯片時,微軟的 CEO 比爾 · 蓋茨(Bill Gates)都會通過升級軟件來吃掉芯片提升的性能。

——而以后吃掉芯片算力的就是大模型了,而且根據(jù) MIT 的這項研究,大模型以后根本吃不飽。

研究方法

如何定義 LLM 的能力提升?首先,研究人員對模型的能力進行了量化。

基本的思想就是:如果一種算法或架構在基準測試中以一半的計算量獲得相同的結果,那么就可以說,它比另一種算法或架構好兩倍。

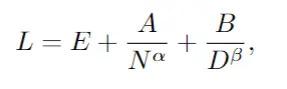

有了比賽規(guī)則之后,研究人員招募了 200 多個語言模型來參加比賽,同時為了確保公平公正,比賽所用的數(shù)據(jù)集是 WikiText-103 和 WikiText-2 以及 Penn Treebank,代表了多年來用于評估語言模型的高質量文本數(shù)據(jù)。

專注于語言模型開發(fā)過程中使用的既定基準,為比較新舊模型提供了連續(xù)性。

需要注意的是,這里只量化了預訓練模型的能力,沒有考慮一些 " 訓練后增強 " 手段,比如思維鏈提示(COT)、微調技術的改進或者集成搜索的方法(RAG)。

模型定義

研究人員通過擬合一個滿足兩個關鍵目標的模型來評估其性能水平:

(1)模型必須與之前關于神經(jīng)標度定律的工作大致一致;

(2)模型應允許分解提高性能的主要因素,例如提高模型中數(shù)據(jù)或自由參數(shù)的使用效率。

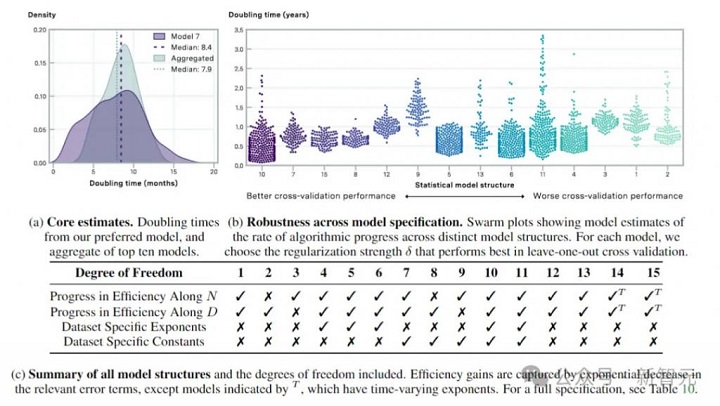

這里采用的核心方法類似于之前提出的縮放定律,將 Dense Transformer 的訓練損失 L 與其參數(shù) N 的數(shù)量和訓練數(shù)據(jù)集大小 D 相關聯(lián):

其中 L 是數(shù)據(jù)集上每個 token 的交叉熵損失,E、A、B、α 和 β 是常數(shù)。E 表示數(shù)據(jù)集的 " 不可減少損失 ",而第二項和第三項分別代表由于模型或數(shù)據(jù)集的有限性而導致的錯誤。

因為隨著時間的推移,實現(xiàn)相同性能水平所需的資源(N 和 D)會減少。為了衡量這一點,作者在模型中引入了 " 有效數(shù)據(jù) " 和 " 有效模型大小 " 的概念:

其中的 Y 表示年份,前面的系數(shù)表示進展率,代入上面的縮放定律,可以得到:

通過這個公式,就可以估計隨著時間的推移,實現(xiàn)相同性能水平所需的更少資源(N 和 D)的速度。

數(shù)據(jù)集

參與測評的包含 400 多個在 WikiText-103(WT103)、WikiText-2(WT2)和 Penn Treebank(PTB)上評估的語言模型,其中約 60% 可用于分析。

研究人員首先從大約 200 篇不同的論文中檢索了相關的評估信息,又額外使用框架執(zhí)行了 25 個模型的評估。

然后,考慮數(shù)據(jù)的子集,其中包含擬合模型結構所需的信息:token 級測試困惑度(決定交叉熵損失)、發(fā)布日期、模型參數(shù)數(shù)量和訓練數(shù)據(jù)集大小,最終篩選出 231 個模型供分析。

這 231 個語言模型,跨越了超過 8 個數(shù)量級的計算,上圖中的每個形狀代表一個模型。

形狀的大小與訓練期間使用的計算成正比,困惑度評估來自于現(xiàn)有文獻以及作者自己的評估測試。

在某些情況下,會從同一篇論文中檢索到多個模型,為了避免自相關帶來的問題,這里每篇論文最多只選擇三個模型。

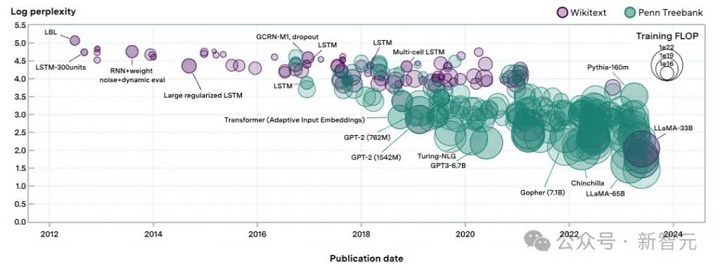

實證結果

根據(jù)縮放定律,以及作者引入的有效數(shù)據(jù)、有效參數(shù)和有效計算的定義來進行評估,結果表明:有效計算的中位倍增時間為 8.4 個月,95% 置信區(qū)間為 4.5 至 14.3 個月。

上圖表示通過交叉驗證選擇的模型的算法進度估計值。圖 a 顯示了倍增時間的匯總估計值,圖 b 顯示了從左到右按交叉驗證性能遞減(MSE 測試損耗增加)排序。

上圖比較了 2016 年至 2020 年前后的算法有效計算的估計倍增時間。相對于前期,后期的倍增時間較短,表明在該截止年之后算法進步速度加快。