5月14日消息,在今天凌晨的OpenAI發(fā)布會(huì)上,最新升級(jí)的大模型GPT-4o正式發(fā)布。

GPT-4o的“o”代表“omni”。該詞意為“全能”,源自拉丁語“omnis”,在英語中“omni”常被用作詞根,用來表示“全部”或“所有”的概念。

GPT-4o可以實(shí)時(shí)對(duì)音頻、視覺和文本進(jìn)行推理,能處理超過50種不同的語言,并且速度和質(zhì)量大大提升。

此前GPT-3.5語音對(duì)話的平均延遲為2.8秒、GPT-4為5.4秒,音頻在輸入時(shí)還會(huì)由于處理方式丟失大量信息,無法識(shí)別笑聲、歌唱聲和情感表達(dá)等。

而GPT-4o可以在232毫秒內(nèi)對(duì)音頻輸入做出反應(yīng),甚至還能隨意打斷,與人類在對(duì)話中的反應(yīng)時(shí)間相近,徹底顛覆了以往的“語音助手”。

GPT-4o在現(xiàn)場(chǎng)充當(dāng)實(shí)時(shí)翻譯也是相當(dāng)?shù)慕z滑,意大利語和英語即聽即翻。

最重要的是,GPT-4o還可以接受文本、音頻和圖像三者組合作為輸入,并生成文本、音頻和圖像的任意組合輸出,人機(jī)交互更加自然、全面了。

GPT-4o的能力還會(huì)向免費(fèi)用戶開放,不過會(huì)限制數(shù)量,免費(fèi)用戶達(dá)到數(shù)量之后,會(huì)自動(dòng)跳回GPT-3.5。

GPT-4o還將開放相應(yīng)API給GPT的開發(fā)者,價(jià)格是GPT-4-turbo的一半,速度卻是GPT-4-turbo的兩倍,速率限制也高5倍。

官方表示,GPT-4o將會(huì)在未來幾周內(nèi)陸續(xù)開放。

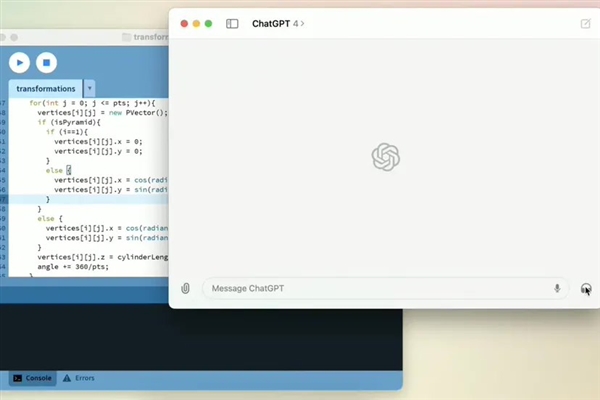

此外,OpenAI還推出了ChatGPT的桌面版應(yīng)用,不過目前只有MacOS版本,Windows版要稍晚一些亮相。