摘 要: 在對目標(biāo)進(jìn)行分類識別過程中,對其特征的有效提取直接影響最后分類的精度。針對此類問題,提出了基于Tri-training算法對圖像進(jìn)行多特征融合分類,通過利用Principal Component Analysis(PCA)主成分分析法,并結(jié)合目前比較實(shí)用的半監(jiān)督學(xué)習(xí)Tri-training算法對圖像顯著目標(biāo)進(jìn)行分類,其中Tri-training算法是以Support Vector Machine(SVM)、Na?觙ve Bayes(NB)、Back Propagation(BP)為基分類器,將圖像的多特征數(shù)據(jù)值作為圖像在Tri-training分類器的輸入對分類器進(jìn)行訓(xùn)練和測試。實(shí)驗(yàn)表明,在進(jìn)行了有效的預(yù)處理之后,再對樣本進(jìn)行多特征融合在一定程度上明顯提高了分類精度。

關(guān)鍵詞: 分類器;多特征融合;半監(jiān)督;顯著目標(biāo)

0 引言

半監(jiān)督學(xué)習(xí)是近年來提出的一種新的學(xué)習(xí)策略,它不僅有效結(jié)合了監(jiān)督學(xué)習(xí)和非監(jiān)督學(xué)習(xí)的優(yōu)點(diǎn),而且完善了它們的不足。它通過同時(shí)使用標(biāo)記樣本和未標(biāo)記樣本的數(shù)據(jù),然后利用未標(biāo)記樣本的信息數(shù)據(jù)來幫助其建立學(xué)習(xí)模型,使其可以獲得很好的學(xué)習(xí)泛化性能和學(xué)習(xí)效果。所以在近年來該理論及其算法得到快速的發(fā)展和應(yīng)用,Blum和Mitchell提出的Co-training算法[1],通過使用兩個(gè)不同的分類器來實(shí)行協(xié)同訓(xùn)練,然后再將單個(gè)分類器所產(chǎn)生的新標(biāo)記數(shù)據(jù)加入到另一個(gè)分類器中,通過迭代的方法,不停地?cái)U(kuò)充有標(biāo)記樣本集并反復(fù)訓(xùn)練。但是該算法不僅要求其數(shù)據(jù)屬性可以分為兩個(gè)不同的子集,而且要求其中每個(gè)子集能獨(dú)立訓(xùn)練產(chǎn)生出分類器,所以在實(shí)際應(yīng)用中很難得到滿足。Zhou等人提出的Tri-training算法[1],它沒有充分冗余視圖的局限,同時(shí)也不需要采用不同的分類方法,其實(shí)用性更廣。將Co-training算法和Tri-Training算法結(jié)合的SVM分類方法,也可以獲得很好的分類精度。

為了提高對圖像中顯著目標(biāo)的分類精度,本文提出了基于Tri-training算法對目標(biāo)進(jìn)行多特征融合分類的方法,首先對圖像中的目標(biāo)進(jìn)行預(yù)處理,消除圖像中的噪聲干擾,同時(shí)有效克服其強(qiáng)度敏感性。然后在此基礎(chǔ)上分別提取中心矩特征,仿射不變矩特征以及其灰度共生矩特征,然后再利用PCA方法將以上特征融合,最后基于Tri-training算法進(jìn)行分類。

1 特征提取

1.1 數(shù)據(jù)預(yù)處理

在對圖像數(shù)據(jù)實(shí)行有效的預(yù)處理過程中,一般主要對其實(shí)行去噪處理。本文主要利用小波方法對圖像實(shí)行有效的降噪處理。小波變換降噪方法通過將數(shù)據(jù)變換到其小波域中,然后再利用小波分解獲得的高頻系數(shù)將其去除,最后再對圖像信號進(jìn)行小波反變換來達(dá)到降噪目的。其公式如下:

g(x,y)=f(x,y)+n(x,y)(1)

其中g(shù)(x,y)為要得到的理想圖像,f(x,y)為輸入圖像,n(x,y)為噪聲,通過頻域變化將噪聲去除就得到了想要的理想圖像。

1.2 圖像中心矩特征提取

假設(shè)x={x(i),i=0,1,2,…,I-1}表示距離像幅度,其中x(i)為第i+1個(gè)距離單元的回波幅度,I為距離單元的個(gè)數(shù),然后對其歸一化處理可得:

f=[f(1),f(2),…,f(J-1)]T=[W2,W3,…,WJ]T(4)

其中中心矩WJ的幅度與階數(shù)關(guān)系為遞增關(guān)系,為了能夠有效地抑制指數(shù)增長造成的影響,一般通過對中心矩作極差變換來達(dá)到消除數(shù)量級造成干擾的目的。在對中心矩特征作向量極差變換時(shí),實(shí)質(zhì)上是做了歸一化處理,從而有效地解決了特征不在同一個(gè)數(shù)量級的問題。所以可得其中心矩特征為f=[f(1),f(2),…,f(J-1)],其中J表示中心矩的最高階數(shù)。

1.3 圖像灰度共生矩陣特征提取

灰度共生矩陣一般定義為從灰度級為i的點(diǎn)離開某個(gè)固定位置關(guān)系d=(Dx,Dy)達(dá)到灰度為j的概率。這里用Pd=(i,j)(i,j=0,1,2,…,L-1)來表示灰度共生矩陣。其中L指圖像的灰度級,i,j分別表示像素的灰度。圖像中像素間的距離和方向由d的值決定。?茲為灰度共生矩陣的生成方向,通常取0°,45°,90°和135°四個(gè)方向。灰度共生矩陣的像素對如圖1所示。

當(dāng)選定像素間位置關(guān)系d后,就能基于關(guān)系d生成灰度共生矩陣[2]。

Pd= Pd(0,0) Pd(0,1) … Pd(0,j) … Pd(0,L-1) Pd(1,0) Pd(1,1) … Pd(1,j) … Pd(1,L-1) … … … … … … Pd(i,0) Pd(i,1) … Pd(i,j) … Pd(i,L-1) … … … … … …Pd(L-1,0) Pd(L-1,1) … Pd(L-1,j)… Pd(L-1,L-1)(5)

1.4 圖像仿射不變特矩特征提取

一般二維仿射線性變換的數(shù)學(xué)變換模型可表示為:

x′y′=Axy+b(6)

假設(shè)p是坐標(biāo)平面上任一點(diǎn),p′點(diǎn)是其仿射線性變換對應(yīng)點(diǎn),變換后坐標(biāo)系下的兩點(diǎn)坐標(biāo)可表示

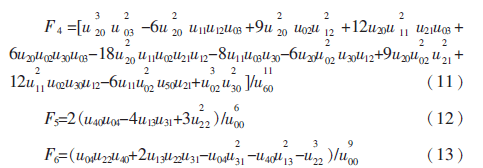

如果通過歸一化中心矩來獲得仿射不變矩,只需要合適的扭曲不變性和拉伸不變性就可以實(shí)現(xiàn)仿射變換的不變性。通過利用構(gòu)造的中心矩多項(xiàng)式方法,可達(dá)到消除仿射變換矩A的目的,這樣就能實(shí)現(xiàn)一般情況下的仿射不變性。這里是利用Jan Flusser等人構(gòu)造的六個(gè)仿射不變矩變量來作為目標(biāo)圖像的特征不變量[3]。

2 特征融合

PCA的基本思想是用一組維數(shù)最少的特征以最精確的方式描述原始樣本特征[4-5]。仿真實(shí)驗(yàn)中從圖像中提取三種有效特征,然后使用主成分分析法再將三種特征融合成一種綜合特征對目標(biāo)進(jìn)行分類。實(shí)驗(yàn)取每類樣本100張圖片,一共兩類樣本數(shù)據(jù),其中每一組樣本數(shù)據(jù)中包含7維中心矩特征、6維仿射不變矩特征以及3維灰度共生矩特征。將上述三種特征生成一個(gè)16維的特征向量為x=(?準(zhǔn)1,?準(zhǔn)2,…,?準(zhǔn)16)T,那么由200個(gè)特征向量構(gòu)成的特征矩陣為X=(x1,x2,…,x200),其中向量xk表示第k張樣本圖像的中心矩特征,仿射不變矩特征及灰度共生矩特征組成列向量。實(shí)驗(yàn)仿真中先將三種特征數(shù)據(jù)進(jìn)行串聯(lián),然后通過PCA來將串聯(lián)后的數(shù)據(jù)進(jìn)行有效的融合。目的有兩方面:一是將三種特征數(shù)據(jù)中的相關(guān)性消除;二是將三種特征數(shù)據(jù)從高維矢量降為低維矢量。

3 基于Tri-training的圖像目標(biāo)分類

基于Tri-training算法的多特征融合圖像分類流程圖如圖2所示。將圖像數(shù)據(jù)轉(zhuǎn)換成算法程序能夠處理的數(shù)據(jù)格式(xls文件)并輸入到Tri-training算法的MATLAB程序中,由算法進(jìn)行樣本集的劃分。當(dāng)完成初始的三種基分類器之后,按百分比輸入已標(biāo)記樣本,然后通過三個(gè)基分類器對未標(biāo)記樣本進(jìn)行相互標(biāo)記以獲得置信度高的樣本,再加入到已標(biāo)記樣本中進(jìn)行模型的訓(xùn)練。以此迭代直至結(jié)束,最后獲得由三個(gè)基分類器組成的集成分類器。在測試階段,通過三個(gè)分類器分別對測試樣本集進(jìn)行有效的分類,使用多數(shù)投票法來獲得最后的分類結(jié)果。

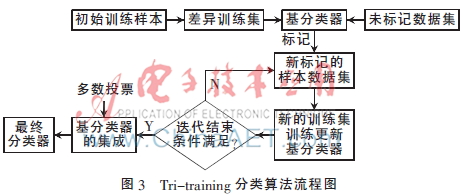

Tri-training分類算法流程圖如圖3所示。Tri-training[4]算法采用三個(gè)基分類器,再通過隨機(jī)采樣算法bootstrap來獲得存在差異的訓(xùn)練數(shù)據(jù)子集,從而能夠有效地保證基分類器之間的差異性。在Tri-training訓(xùn)練結(jié)束后,采用多數(shù)投票法對三個(gè)分類器進(jìn)行集成,得到最終的分類器進(jìn)行分類。

4 實(shí)驗(yàn)結(jié)果與分析

本文中選取飛機(jī)和越野車各100張照片作為實(shí)驗(yàn)數(shù)據(jù),首先提取圖像的中心矩特征、放射不變矩特征和灰度共生矩特征,再將這些數(shù)據(jù)融合得到一個(gè)多特征數(shù)據(jù)來作為Tri-training分類器的輸入數(shù)據(jù),實(shí)驗(yàn)中基于MATLAB 7.0平臺進(jìn)行仿真。部分樣本如圖4所示。

4.1 樣本分配

選用25%的特征數(shù)據(jù)作為測試樣本集,剩余的75%作為訓(xùn)練樣本集。在訓(xùn)練樣本集中,未標(biāo)記樣本的比例依次選用80%,60%,40%和20%進(jìn)行測試和比較。Tri-training算法中采用了SVM,NB,BP作為分類器。

4.2 算法的性能評價(jià)標(biāo)準(zhǔn)

采用算法對于測試集的分類錯(cuò)誤率作為分類器的評價(jià)指標(biāo)。

其中,E是算法分類錯(cuò)誤率,Ncorrect是分類正確的樣本數(shù)目,N是總樣本數(shù)。

4.3 實(shí)驗(yàn)結(jié)果

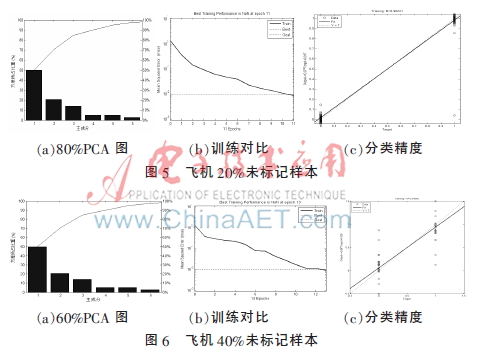

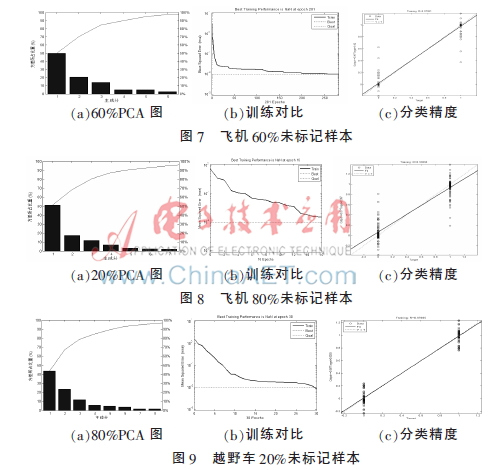

實(shí)驗(yàn)中對未標(biāo)記樣本的比例依次選用80%,60%,40%和20%進(jìn)行測試和比較,結(jié)果如圖5~圖12所示。以下各圖中,(a)為PCA融合得到的方差圖,(b)為訓(xùn)練之后與最優(yōu)線的比較,(c)是最后分類的精度。

表1是在4種不同百分比下未標(biāo)記樣本的半監(jiān)督學(xué)習(xí)(PCA+Tri-training)與對應(yīng)的PCA特征融合分類錯(cuò)誤率的比較。

從表1中可以看出,當(dāng)標(biāo)記的樣本比較多時(shí),PCA多特征融合法與基于Tri-training算法的PCA多特征融合法的分類精度差不多,但是當(dāng)樣本開始減少時(shí),就能看出兩種方法的差異性,所以在少數(shù)樣本情況下第二種方法更實(shí)用,分類精度更高,操作性很強(qiáng)。

5 結(jié)束語

本文主要是將機(jī)器學(xué)習(xí)領(lǐng)域的Tri-training半監(jiān)督學(xué)習(xí)方法應(yīng)用在圖像的顯著目標(biāo)分類,并基于Tri-training算法提出了與多特征融合相結(jié)合的圖像分類方法,通過有效地將圖像的中心矩特征、仿射不變矩特征和灰度共生矩特征進(jìn)行融合,利用SVM,NB,BP三個(gè)基分類器進(jìn)行協(xié)同訓(xùn)練,達(dá)到了很好的分類效果。仿真結(jié)果表明其在小樣本分類中具有很好的分類效果。

參考文獻(xiàn)

[1] 周志華.機(jī)器學(xué)習(xí)及其應(yīng)用2007[M].北京:清華大學(xué)出版社,2007.

[2] 陸麗珍,劉仁義,劉南.一種融合顏色和紋理特征的遙感圖像檢索方法[J].中國圖象圖形學(xué)報(bào),2004,9(3):328-332.

[3] 楚稼,張桂林.基于顏色和邊緣信息融合的背景建模方法[J].計(jì)算機(jī)工程,2008,34(4):42-45.

[4] LOWE D G. Distinctive image features from scale invariant key points[J]. In Journal of Computer Vision, 2004,60(2): 91-110.

[5] 謝輝,陸月明,孫松林.基于半監(jiān)督學(xué)習(xí)的一種圖像檢索方法[J].計(jì)算機(jī)應(yīng)用研究,2013,30(7):2210-2212.