劉偉,薄華

(上海海事大學(xué) 信息工程學(xué)院,上海 201306)

摘要:圖像的大部分結(jié)構(gòu)信息都集中在了邊緣,在進(jìn)行邊緣檢測(cè)時(shí)濾除一些與圖像計(jì)算不相關(guān)的信息,可減少計(jì)算中的數(shù)據(jù)量,使得計(jì)算更加便捷;在結(jié)構(gòu)屬性上也得到了很好的保留,因此邊緣檢測(cè)方法在圖像視覺(jué)效果評(píng)估上是可行的。人眼對(duì)于一幅圖像的視覺(jué)并不是每一個(gè)圖像區(qū)域都具有同等的視覺(jué)重要性。可以建立一種數(shù)學(xué)方法,提取圖像中的視覺(jué)重要區(qū)域,對(duì)這些區(qū)域進(jìn)行視覺(jué)效果評(píng)價(jià)。選取基于結(jié)構(gòu)相似度方法作為最終評(píng)價(jià)方法,得到了一種全參考圖像質(zhì)量評(píng)價(jià)算法。最后將實(shí)驗(yàn)結(jié)果與3個(gè)圖像評(píng)價(jià)庫(kù)的參考結(jié)果進(jìn)行擬合,得到的結(jié)果與其他算法相比表明,該算法更加符合人眼的視覺(jué)效果特性。

關(guān)鍵詞:邊緣檢測(cè);Canny算子;局部方差;結(jié)構(gòu)相似度

0引言

隨著現(xiàn)代多媒體信息技術(shù)的快速發(fā)展,數(shù)字圖像作為多媒體技術(shù)之一在當(dāng)今生活中的作用越來(lái)越受到大家的關(guān)注,圖像在獲取、壓縮、編碼、傳輸、處理等過(guò)程中產(chǎn)生的各種失真和誤差是無(wú)法回避的,這些不同程度的誤差和失真會(huì)直接影響到圖像的質(zhì)量,從而影響了人眼對(duì)圖像觀賞效果,因此需要一種更加方便且精確的方法來(lái)評(píng)價(jià)圖像的質(zhì)量。

當(dāng)下圖像視覺(jué)效果評(píng)估方法主要分為兩大類(lèi):主觀評(píng)估和客觀評(píng)估。主觀評(píng)估法昂貴、耗時(shí)又不方便實(shí)時(shí)應(yīng)用,不僅受到人體本身?xiàng)l件的影響而且還受到環(huán)境因素的影響,因此評(píng)估穩(wěn)定性較差。客觀評(píng)估方法是利用計(jì)算機(jī)通過(guò)算法來(lái)算出失真圖片視覺(jué)效果值作為評(píng)估的依據(jù),客觀評(píng)估方法可分為全參考、部分參考和無(wú)參考三種類(lèi)型。本文是基于全參考下的圖像視覺(jué)效果評(píng)價(jià)方法。全參考圖像視覺(jué)效果評(píng)估方法是指擁有該失真圖像的原始圖像,運(yùn)用某種數(shù)學(xué)算法將圖像某一特征進(jìn)行提取,與待評(píng)價(jià)圖像進(jìn)行對(duì)比分析,通過(guò)差異的大小判斷失真圖像的質(zhì)量的好壞,這種模式的好處是充分運(yùn)用了數(shù)學(xué)模型的穩(wěn)定性,準(zhǔn)確性較好。當(dāng)前全參考圖像的研究種類(lèi)基本上分為四大類(lèi):像素之間誤差統(tǒng)計(jì)、結(jié)構(gòu)相似度、信息保真度和人類(lèi)視覺(jué)系統(tǒng)。傳統(tǒng)的像素之間誤差統(tǒng)計(jì)客觀評(píng)估方法中,比較常見(jiàn)的是均方誤差(Mean Square Error,MSE)[1]和峰值信噪比(Peak Signal to Noise Ratio, PSNR)[2] ,其計(jì)算方法都是計(jì)算原始圖像和帶評(píng)價(jià)圖像之間像素點(diǎn)灰度值之間差異來(lái)判斷一幅圖像的好壞。但是這類(lèi)算法只考慮了像素之間的差異,其實(shí)驗(yàn)結(jié)果并不能準(zhǔn)確表達(dá)人眼的視覺(jué)。參考文獻(xiàn)[3]表述人眼睛的視覺(jué)功能主要是用來(lái)提取背景中的結(jié)構(gòu)信息,Wang Zhou等人通過(guò)此類(lèi)結(jié)論得出了新的基于結(jié)構(gòu)失真的圖像視覺(jué)效果評(píng)價(jià)方法(Structual Similarity,SSIM)[4],此方法在對(duì)某些不同類(lèi)型的失真及失真敏感度不同的情況下也與人眼主觀視覺(jué)存在一定的差異。MOORTHY A K等人提出基于視覺(jué)區(qū)域利用綜合感知的改進(jìn)算法[5];王強(qiáng)等人[6]深入挖掘圖像的結(jié)構(gòu)信息,利用圖像中鄰近像素點(diǎn)的相關(guān)性對(duì)圖像邊緣、紋理等結(jié)構(gòu)提出了一種基于局部結(jié)構(gòu)方向相似度的質(zhì)量評(píng)價(jià)算法(Structual Orientation Information,SOI)[6]。本文提出了一種新的圖像視覺(jué)效果評(píng)價(jià)算法,通過(guò)對(duì)圖像的邊緣信息進(jìn)行提取,并且結(jié)合局部方差確定待評(píng)價(jià)區(qū)域,運(yùn)用SSIM算法得到最終圖像的質(zhì)量分?jǐn)?shù),實(shí)驗(yàn)結(jié)果證明該方法與人眼主觀的視覺(jué)效果具有高度相似性。

1基于邊緣顯著區(qū)域和結(jié)構(gòu)相似度的圖像視覺(jué)效果評(píng)價(jià)

1.1Canny邊緣檢測(cè)

本文提出的視覺(jué)效果評(píng)價(jià)算法通過(guò)Canny邊緣檢測(cè)算子來(lái)對(duì)圖像的邊緣結(jié)構(gòu)信息進(jìn)行提取。Canny算子首先將圖像的噪聲進(jìn)行抑制,獲得平滑的圖像。最后通過(guò)精確定位得到圖像的邊緣位置。其步驟如下:

(1)用高斯濾波器平滑圖像。

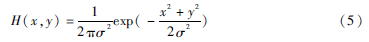

高斯平滑函數(shù)H(x,y):

G(x,y)=f(x,y)H(x,y)(6)

其中f(x,y)是圖像數(shù)據(jù)。

(2)在Canny算子中用一階偏導(dǎo)的有限差分近似方法來(lái)計(jì)算圖像中的梯度的幅值和方向。

利用一階差分模板:

得到幅值:φ(x,y)=φ21(x,y)+φ22(x,y),方向:θφ=tan-1φ2(x,y)φ1(x,y)。

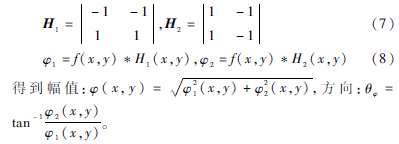

(3)在圖像矩陣中對(duì)梯度的幅值進(jìn)行非極大值抑制。

對(duì)于整幅圖片來(lái)說(shuō)其圖像矩陣中值越大的點(diǎn)只能表示為在此點(diǎn)的梯度的幅值越大,并不能將其表示成該點(diǎn)是圖像中的邊緣點(diǎn),在邊緣點(diǎn)確定時(shí)應(yīng)該保留其局部梯度值最大的點(diǎn),但是在非極大值點(diǎn)上,對(duì)其進(jìn)行抑制,尋找到梯度最大值點(diǎn)后,不是對(duì)最大值點(diǎn)進(jìn)行抑制,而是將梯度最大值點(diǎn)所對(duì)應(yīng)的其灰度值設(shè)置為0。

圖1非極大值抑制圖1中4個(gè)扇區(qū)相應(yīng)的編號(hào)為0~3,與之相對(duì)應(yīng)的左圖為3×3的4種可能的組合。首先要確定某一像素點(diǎn)的灰度值的大小并判斷在其領(lǐng)域中是否最大,如果得出該點(diǎn)不是局部的最大灰度值點(diǎn),則否決該點(diǎn)為邊緣點(diǎn)。以上原理就是確定邊緣點(diǎn)的工作原理。

(4)使用雙閾值算法對(duì)邊緣進(jìn)行檢測(cè)以及連接。

通過(guò)第三步的非極大抑制后得到的幅值如果直接顯示出結(jié)果,那么很有可能會(huì)有少量的邊緣像素包含到輸出結(jié)果中,這樣會(huì)影響邊緣檢測(cè)結(jié)果的精確性,所以采用雙閾值的方法來(lái)進(jìn)行取舍。與傳統(tǒng)方法的一個(gè)閾值選擇相比,Canny算法中提出的雙閾值方法很好地實(shí)現(xiàn)了邊緣選擇,雙閾值選擇與邊緣連接方法假設(shè)兩個(gè)閾值,這兩個(gè)閾值,分為兩極,一個(gè)為高用T1表示,另一個(gè)為低用T2表示。

T2=0.4T1則有:

(1)對(duì)于任意邊緣像素低于T2的則丟棄。

(2)對(duì)于任意邊緣像素高于T1的則保留。

(3)對(duì)于任意的邊緣像素其值在T2到T1之間的,如果能通過(guò)邊緣連接到像素值大于T1而且邊緣所有像素值大于最小閾值T2的則保存,否則不保留。

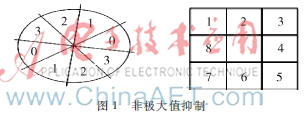

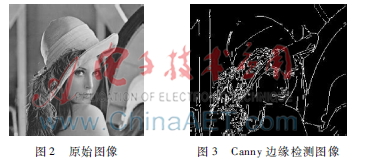

本文采用了相比之前Canny算子更加細(xì)化的Canny算子。對(duì)高斯濾波器得到的圖像進(jìn)行邊緣檢測(cè),且在檢測(cè)中用Sobel算子進(jìn)行橫、豎、聯(lián)合檢測(cè),最后得到聯(lián)合檢測(cè)圖像并對(duì)其進(jìn)行非極大值抑制,在邊緣點(diǎn)連接的同時(shí)進(jìn)行滯后閾值處理。此方法得到的邊緣檢測(cè)圖像在邊緣結(jié)構(gòu)上具有很好的連續(xù)性,更好地反映了圖像的邊緣部分。圖2為原始圖像,圖3為采用此方法得到的邊緣檢測(cè)圖,具有較好的效果。

1.2圖像顯著區(qū)域提取

在人眼視覺(jué)系統(tǒng)中對(duì)于整幅圖像而言,并不是每一塊區(qū)域都是人眼視覺(jué)的重要區(qū)域,因此為了提取圖像中人眼視覺(jué)重要區(qū)域,可以通過(guò)一些量化手段來(lái)實(shí)現(xiàn)。本文選用譜殘余(Spectral Residual,SR)[7]的方法來(lái)選取圖像的顯著區(qū)域。SR算法對(duì)圖像的幅度譜進(jìn)行處理后獲得圖像的殘余譜,對(duì)獲得的殘余譜利用傅里葉變換得到空間域的顯著圖。

對(duì)于一幅圖像,其像素在空間上的變化各不相同,但是,如果從空間頻譜域進(jìn)行分析,每幅圖像都可以分解成具有多個(gè)不同的空間頻譜的波信號(hào)。以小波分解為例,經(jīng)過(guò)分解后的圖像,在圖像中具有明顯區(qū)別的部分都會(huì)集中在高頻部分,也即圖像空間域中高頻部分包含了圖像的細(xì)節(jié)或結(jié)構(gòu)信息。

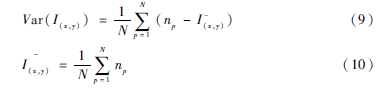

在描述圖像的細(xì)節(jié)和紋理信息等時(shí),通過(guò)局部方差能獲得很好的效果,所以利用局部方差來(lái)分析圖像也是很好的方式。如果用Var(I(x,y))表示圖像I(x,y)局部的方差,其具體含義就是把圖像中的某點(diǎn)(x,y)設(shè)為中心點(diǎn),計(jì)算該點(diǎn)局部區(qū)域內(nèi)的局部方差。對(duì)于局部的理解即為圖像的每一個(gè)塊,在實(shí)際計(jì)算過(guò)程中,往往將圖像采用滑動(dòng)窗口將圖像分解為互不重疊的圖像塊,最終此算法算得的某一區(qū)域內(nèi)的局部方差即是塊圖像的局部方差。如果每一個(gè)圖像塊I(x,y)的像素?cái)?shù)為N,用np來(lái)作為圖像中圖像塊的像素,那么每個(gè)圖像塊的局部方差數(shù)學(xué)表達(dá)式為:

以上即為圖像的局部方差的計(jì)算過(guò)程。

首先,將參考圖像與失真圖像分成8×8的互不重疊的圖像塊,分別用Ai和Bi表示,計(jì)算原始圖像與待評(píng)價(jià)圖像的局部方差,分別用Var_ri和Var_di表示兩者的局部方差。然后算出原始圖像和待評(píng)價(jià)圖像的局部誤差差值,并取其絕對(duì)值:

Vari=|Var_ri-Var_di|(11)

用V-ari代表Var的均值,那么原始圖像與待評(píng)價(jià)圖像的目標(biāo)區(qū)域Ath和Bth的選擇可以表示為:

(Ath,Bth)={(Ai,Bi)|Vari>V-ari},(i=1,...,N)}(12)

1.3結(jié)構(gòu)相似度

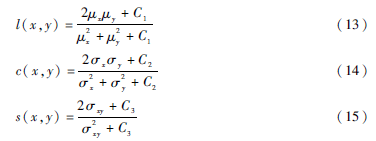

MSE和PSNR只是單純地考慮了圖像之間灰度的差異,并沒(méi)有考慮像素之間的結(jié)構(gòu)關(guān)系以及人眼觀察圖像的特點(diǎn),針對(duì)此問(wèn)題,Wang Zhou等人認(rèn)為在圖像中圖像的結(jié)構(gòu)信息不僅反映了圖像中物體的結(jié)構(gòu)特征,并且圖片中的亮度和對(duì)比度在圖片的質(zhì)量,以及人眼對(duì)圖片的某一感興趣的視覺(jué)區(qū)域的獲取具有非常大的幫助[4]。假設(shè)x、y分別為原始圖像和待評(píng)價(jià)圖像,它們的亮度、對(duì)比度、結(jié)構(gòu)相似度分別為:

s(x,y)=2σxy+C3σ2xy+C3(15)

綜合上述三者信息構(gòu)成的原始圖像x和待評(píng)價(jià)圖像y的結(jié)構(gòu)相似性為:

SSIM(x,y)=[l(x,y)]α·[c(x,y)]β·[s(x,y)]γ(16)

式中μx為圖像x的灰度均值,表示其亮度信息,σx為圖像x的方差,表示其對(duì)比度信息,σxy為x、y的相關(guān)系數(shù),反映了其圖像中結(jié)構(gòu)信息的相似度。C1、C2、C3為接近于零的正常數(shù),目的是為了防止分母為零導(dǎo)致計(jì)算中出現(xiàn)結(jié)果異常,令C1=(K1L)2,C2=(K2L)2,C3=C2/2, 其中L表示圖像中其像素范圍,在計(jì)算中一般取K1=0.01,K2=0.03,L=255。

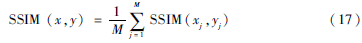

在實(shí)際應(yīng)用中,采用一定大小的窗口滑窗分別從原始圖像和待評(píng)價(jià)圖像的左上角到右下角對(duì)圖像中逐個(gè)像素點(diǎn)進(jìn)行滑動(dòng),依次算出同一區(qū)域所對(duì)應(yīng)的子塊圖像的SSIM數(shù)值。

其中xj,yj表示第j個(gè)原始圖像的子塊圖,它們之間的結(jié)構(gòu)相似度用SSIM(xj,yj)來(lái)表示,M表示窗口分塊后子圖像塊的個(gè)數(shù)。SSIM值的大小與1越相近則表示失真圖像,與原圖像越接近。

1.4基于邊緣顯著區(qū)域和結(jié)構(gòu)相似度的圖像視覺(jué)效果評(píng)價(jià)

本文算法的主要思想:(1)選取參考圖像和失真圖像,分別對(duì)其進(jìn)行Canny算子邊緣檢測(cè),得到邊緣檢測(cè)圖像。(2)將原始圖像與待評(píng)價(jià)圖像分成互不重疊圖像塊,并計(jì)算原始圖像與待評(píng)價(jià)圖像的局部方差,從而獲取圖像的顯著區(qū)域。(3)對(duì)原始圖像和待評(píng)價(jià)圖像的目標(biāo)顯著區(qū)域運(yùn)用結(jié)構(gòu)相似度評(píng)價(jià)算法進(jìn)行指標(biāo)計(jì)算從而得到圖像的評(píng)價(jià)值。針對(duì)上述描述可得本文的算法,如下:

(1)假設(shè)x、y分別表示失真圖像和參考圖像,對(duì)其運(yùn)用Canny算子進(jìn)行邊緣檢測(cè)后得到x′、y′邊緣檢測(cè)圖像;

(2)對(duì)x′、y′圖像計(jì)算其VarI(x,y),在對(duì)整幅圖像上對(duì)x′、y′分成8×8的小塊分別計(jì)算每個(gè)圖像小塊的Var I(x,y);

(3)分別用Var_ri和Var_di表示x′、y′局部方差然后計(jì)算參考圖像和待評(píng)價(jià)圖像的局部誤差差值,通過(guò)差值選擇來(lái)得到圖像特征顯著區(qū)域;

(4)原始參考圖像與待評(píng)價(jià)圖像的目標(biāo)區(qū)域分別為Ath以及Bth,分別運(yùn)用結(jié)構(gòu)相似度計(jì)算圖像的亮度l(x,y)、對(duì)比度c(x,y)和結(jié)構(gòu)相似度s(x,y)值;

(5)計(jì)算SSIM值,通過(guò)圖像塊的平均加權(quán)方法得到最終評(píng)價(jià)SSIM值。

2實(shí)驗(yàn)分析

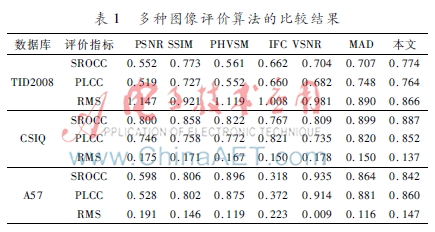

為了驗(yàn)證本文提出算法的有效性,本文通過(guò)與3個(gè)圖像庫(kù)給出的參考結(jié)果進(jìn)行擬合對(duì)比來(lái)驗(yàn)證本文所提出的圖像視覺(jué)質(zhì)量評(píng)價(jià)算法。其分別是A57[8]、CSIQ[9]、TID2008[10]。這3個(gè)數(shù)據(jù)庫(kù)包含了壓縮效應(yīng)、模糊、閃變效應(yīng)噪聲和傳輸效應(yīng)失真等,并且每一個(gè)圖像庫(kù)都附帶有人眼主觀評(píng)價(jià)分值,都具有很高的權(quán)威性。圖4為選取了CSIQ圖像庫(kù)的原始圖像和一組不同噪聲圖像。本文還使用了斯皮爾曼相關(guān)系數(shù)(SROCC)、皮爾遜相關(guān)系數(shù)(PLOCC)和均方誤差(RMS)評(píng)估指標(biāo)來(lái)比較這些客觀結(jié)果和主觀結(jié)果。

最后將本文評(píng)價(jià)算法的性能結(jié)果與其他圖像評(píng)價(jià)算法進(jìn)行比較,這些算法包括:PSNR、SSIM、PHVSM[11]、IFC[12]、VSNR[13]和MAD[14],表1給出了最終的比較值。其中對(duì)于SROCC和PLOCC越接近1表示效果越好,而RMS越小則表示效果越好。

從實(shí)驗(yàn)結(jié)果可以看出,在圖像庫(kù)TID2008和CSIQ中,本文所提出的基于邊緣顯著區(qū)域的算法,在評(píng)價(jià)結(jié)果上相對(duì)于其他算法更符合人眼的主觀評(píng)價(jià),從而論證了本文所運(yùn)用的方法在圖像評(píng)價(jià)上擁有更好的性能。從A57圖像庫(kù)中可以看到在評(píng)價(jià)效果上不是十分明顯,這是因?yàn)樵谟?jì)算圖像的特性顯著區(qū)域時(shí),由于SR方法在抑制圖像非顯著信息的同時(shí)也抑制了圖像的顯著區(qū)域。A57圖像庫(kù)其特點(diǎn)就是強(qiáng)調(diào)細(xì)節(jié)的重要性,因此在算法應(yīng)用的過(guò)程中,由于忽略掉了一些細(xì)節(jié)方面的信息,從而對(duì)于A57圖像庫(kù)本文的算法效果不是十分明顯。

3結(jié)論

人眼在處理自然場(chǎng)景或者圖片時(shí),并不是圖像中的每一個(gè)部分的變化都能夠引起人眼視覺(jué)系統(tǒng)的注意。本文正是基于這種概念的啟發(fā),對(duì)邊緣檢測(cè)后的圖像進(jìn)行顯著區(qū)域分析,并對(duì)其進(jìn)行評(píng)價(jià),從而得到評(píng)價(jià)結(jié)果。實(shí)驗(yàn)證明本文的視覺(jué)效果評(píng)價(jià)算法能夠獲得一個(gè)較好的評(píng)價(jià)結(jié)果。同時(shí),本文算法在顯著區(qū)域提取方面和結(jié)構(gòu)相似性的計(jì)算上仍有待改進(jìn)的空間,對(duì)顯著區(qū)域評(píng)價(jià)方法的研究將是后續(xù)工作的重點(diǎn)。

參考文獻(xiàn)

[1] Wang Zhou, BOVIK A C. Mean squared error: love it or leave it a new look at signal fidelity measures[J]. Signal Processing Magazine IEEE, 2009, 26(1):98117.

[2] AHMET M E, FISHER P S. Image quality measutes and their performance[J].IEEE Trans acations on Communications,1995,43(12):29592965.

[3] Wang Zhou, BOVIK A C, HAMID R S,et al. Image quality assessment: from error visibilityto structural similarity[J]. IEEE Transactions on Image Processing, 2004, 13(4):600612.

[4] LARSON E C, CHANDLER D M. Most apparent distortion: fullreference image quality assessment and the role of strategy[J]. Journal of Electronic Imaging, 2010,19(1): 011006101100621.

[5] MOORTHY A K, BOVIK A C. Perceptually significant spatial pooling techniques for image quality assessment[J]. Human Vision and Electronic Imaging, 2009, 7240:111.

[6] 王強(qiáng),梁德群,畢勝,等.基于結(jié)構(gòu)方向信息的圖像質(zhì)評(píng)價(jià)方法[J].計(jì)算機(jī)應(yīng)用,2010, 30(6):16221625.

[7] 易瑜,薄華,孫強(qiáng),等.基于顯著圖與稀疏特征的圖像視覺(jué)效果評(píng)價(jià)[J].微型機(jī)與應(yīng)用,2015,34(8):4143.

[8] LARSON E C, CHANDLER D M.Most apparent distortion: fullreference image quality assessment and the role of strategy[J].Journal of Electronic Imaging,2010,19(1): 143153.

[9] Hou Xiaodi, Zhang Liqing. Saliency detection :a spectral residual approach[C].IEEE Conference on Computer Vision and Pattern Recognition ,CVPR 07,IEEE,2007:18.

[10] HYVARINRN A, KARHUNE J, OJA E. Independent component analysis[M].John Wiley & Sons, 2004.

[11]PONOMARENKO N, LUKIN V, ZELENSKY A, et al. TID2008a database for evaluation of fullreference visual quality assessment metrics[J]. Advances of Modern Radioelectronios, 2009, 10(1):3045.

[12] SOLOMON J A, WATSON A B, AHUMADA A. Visibility of DCT basis functions:effects of contrast masking[C]. In Proc. Data Compression Conf., Snowbird, UT. 1994:361370.