AI漫長(zhǎng)的歷史中,ChatGPT絕對(duì)是濃墨重彩的一筆。正是它引爆了AI大模型概念,也讓以往高高在上的AI飛入了尋常百姓家,開(kāi)始融入每個(gè)人的日常工作、生活,AI PC、AI手機(jī)、AI邊緣也都在大踏步前進(jìn),變革千行百業(yè)。

有調(diào)研數(shù)據(jù)顯示,預(yù)計(jì)到2026年,AIGC相關(guān)投入將超過(guò)3000億美元,到2028年,80%以上的PC都會(huì)轉(zhuǎn)換成AI PC,而在邊緣應(yīng)用中AI的普及率也將超過(guò)50%。

AI大模型等應(yīng)用最需要的當(dāng)然是高算力,GPU加速器隨之變得炙手可熱,但是AI的發(fā)展與變革同樣是多元化的,CPU通用處理器、NPU神經(jīng)網(wǎng)絡(luò)引擎也都在各司其職,貢獻(xiàn)自己的力量。

尤其是傳統(tǒng)的CPU,也在緊跟時(shí)代的腳步,全方位擁抱AI,Inte第五代至強(qiáng)(Emerald Rapids)就是一個(gè)典型代表。

Intel 2023年初發(fā)布的第四代至強(qiáng)(Sapphire Rapids),年底就升級(jí)為第五代,速度之快前所未有,主要就是為了跟上形勢(shì),尤其是AI的需求,很多指標(biāo)都是為此而優(yōu)化的。

這包括更多的核心數(shù)量、更高的頻率、更豐富的AI加速器,都帶來(lái)了性能和能效的提升,對(duì)于AIGC非常有利。

還有多達(dá)3倍的三級(jí)緩存,可以減少對(duì)系統(tǒng)內(nèi)存的依賴,內(nèi)存帶寬也同時(shí)進(jìn)一步提升。

軟件生態(tài)方面,Intel提供了全方位的開(kāi)發(fā)支持與優(yōu)化,尤其加大了對(duì)主流大模型、AI框架的支持,特別是PyTorch、TensorFlow等等,在AI訓(xùn)練、實(shí)時(shí)推理、批量推理等方面,基于不同算法,性能提升最多可達(dá)40%,甚至可以處理340億參數(shù)的大模型。

根據(jù)Intel提供的數(shù)據(jù),五代至強(qiáng)SPECInt整數(shù)計(jì)算性能提升21%,AI負(fù)載性能提升最多達(dá)42%,綜合能效也提升了多達(dá)36%。

具體到細(xì)分領(lǐng)域,圖像分割、圖像分類AI推理性能提升最多分別42%、24%,建模和模擬HPC性能提升最多42%,網(wǎng)絡(luò)安全應(yīng)用性能提升最多69%。

網(wǎng)絡(luò)與云原生負(fù)載能效提升最多33%,基礎(chǔ)設(shè)施與存儲(chǔ)負(fù)載能效提升最多24%。

有趣的是,Intel指出五代至強(qiáng)也有很高的性價(jià)比,其中一個(gè)評(píng)估標(biāo)準(zhǔn)就是同時(shí)支持的用戶數(shù),五代至強(qiáng)可以在BF16、INT8精度下同時(shí)滿足8個(gè)用戶的實(shí)時(shí)訪問(wèn)需求,延遲不超過(guò)100ms。

五代至強(qiáng)的優(yōu)秀,也得到了合作伙伴的驗(yàn)證,比如阿里云、百度云都驗(yàn)證了五代至強(qiáng)運(yùn)行Llama 2 700億參數(shù)大模型的推理,其中百度云在四節(jié)點(diǎn)服務(wù)器上的結(jié)果僅為87.5毫秒。

再比如京東云,Llama 2 130億參數(shù)模型在五代至強(qiáng)上的性能比上代提升了多達(dá)50%。

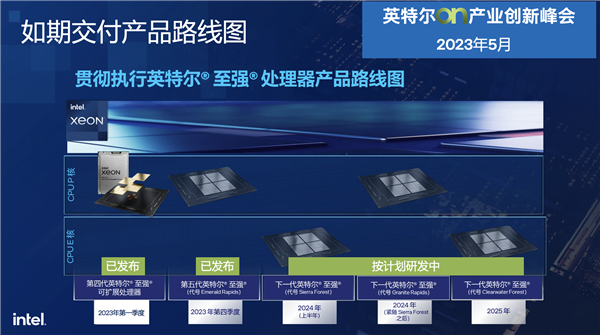

接下來(lái),Intel至強(qiáng)路線圖推進(jìn)的速度同樣飛快,今年內(nèi)會(huì)陸續(xù)交付Granite Rapids、Sierra Forest兩套平臺(tái),均升級(jí)為全新的Intel 3制程工藝。

其中,Sierra Forest首次采用E核架構(gòu),單芯片最多144核心,雙芯整合封裝能做到288核心,今年上半年就能問(wèn)世。

Sierra Forest主要面向新興的云原生設(shè)計(jì),可提供極致的每瓦性能,符合國(guó)家對(duì)設(shè)備淘汰換新的要求,而且因?yàn)閮?nèi)核比較精簡(jiǎn),可以大大提高同等空間內(nèi)的核心數(shù)量。

緊隨其后的Granite Rapids,則依然是傳統(tǒng)P核設(shè)計(jì),具備更高頻率、更高性能。

Granite Rapids針對(duì)主流和復(fù)雜的數(shù)據(jù)中心應(yīng)用進(jìn)行優(yōu)化,尤其是大型程序,可以減少對(duì)虛擬機(jī)的依賴。

到了2025年,Intel還會(huì)帶來(lái)再下一代的至強(qiáng)產(chǎn)品,代號(hào)Clearwater Forest,無(wú)論制程工藝還是技術(shù)特性抑或性能能效,都會(huì)再次飛躍。

那么問(wèn)題就來(lái)了,Intel至強(qiáng)的更新?lián)Q代如此頻繁,尤其是五代至強(qiáng)似乎生命周期很短,它究竟值不值得采納部署呢?適合哪些應(yīng)用市場(chǎng)和場(chǎng)景呢?

五代至強(qiáng)發(fā)布之初,Intel從工作負(fù)載優(yōu)化性能、高能效計(jì)算、CPU AI應(yīng)用場(chǎng)景、運(yùn)營(yíng)效率、可擴(kuò)展安全功能和質(zhì)量解決方案五個(gè)方面進(jìn)行了介紹。

現(xiàn)在,我們?cè)贀Q一個(gè)維度,從另外五個(gè)方面了解一下五代至強(qiáng)的深層次價(jià)值。

一是制程工藝改進(jìn)。

五代、四代至強(qiáng)都是Intel 7工藝,都采用了Dual-poly-pitch SuperFin晶體管,但也改進(jìn)了關(guān)鍵的技術(shù)指標(biāo),特別是在系統(tǒng)漏電流控制、動(dòng)態(tài)電容方面,它們都對(duì)晶體管性能有很大影響。

通過(guò)這些調(diào)整,五代至強(qiáng)在同等功耗下的整體頻率提升了3%,其中2.5%來(lái)自漏電流的減少,0.5%來(lái)自動(dòng)態(tài)電容的下降。

二是芯片布局。

受到芯片集成復(fù)雜度、制造技術(shù)的限制,現(xiàn)在主流芯片都不再是單一大芯片,而是改為多個(gè)小芯片整合封裝。

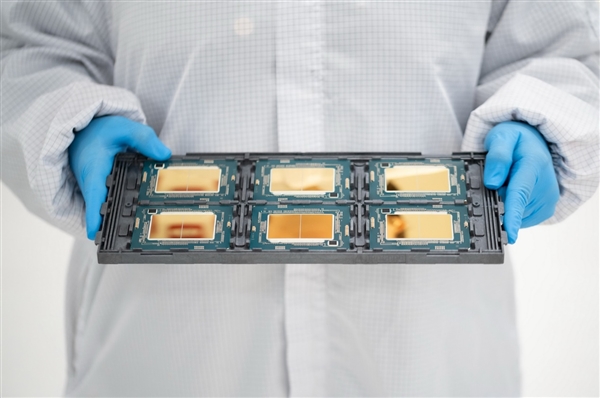

四代至強(qiáng)分成了對(duì)稱的四個(gè)部分,做到最多60核心,五代至強(qiáng)則變成了鏡像對(duì)稱的兩部分,核心數(shù)反而提升到最多64個(gè)。

之所以如此改變,是因?yàn)榍懈畹男⌒酒蕉啵舜嘶ハ嗤ㄐ潘枰目刂破鳌⒔涌诤退加玫拿娣e也更多,還會(huì)額外增加功耗,并降低良品率。

通過(guò)芯片質(zhì)量控制,五代至強(qiáng)可以更好地控制芯片面積,并且在相對(duì)較大的面積下獲得很好的良率,鏡像對(duì)稱的布線也更靈活。

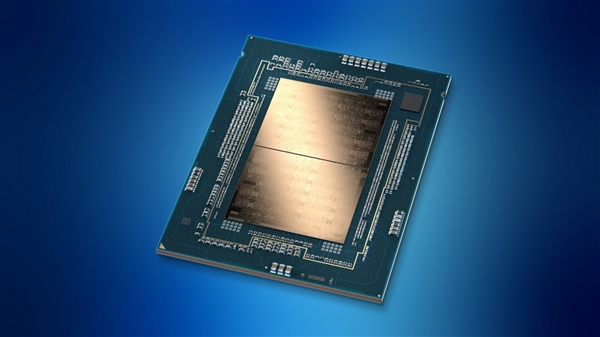

這是五代至強(qiáng)單個(gè)芯片的布局圖,可以看到中間是33個(gè)CPU核心和二三級(jí)緩存,其中一個(gè)核心作為冗余保留。

左右兩側(cè)是DDR5內(nèi)存控制器,上方是PCIe、UIPI控制器,以及DLB、DSA、IAA、QAT等各種加速器,底部則是EMIB封裝和通信模塊,用于雙芯片內(nèi)部高效互連。

說(shuō)到連接,五代至強(qiáng)使用了高速內(nèi)部互連Fabric MDF,包括七個(gè)SCF(可擴(kuò)展一致性帶寬互連),每一個(gè)都有500Gbps的高帶寬,讓兩顆芯片在邏輯上實(shí)現(xiàn)無(wú)縫連接。

三是性能與能效。

看一下五代至強(qiáng)的關(guān)鍵性能指標(biāo):

- CPU架構(gòu)升級(jí)到Raptor Cove,13/14代酷睿同款。

- 核心數(shù)量增加,最多60核心來(lái)到最多64核心。

- 三級(jí)緩存擴(kuò)容,平均每核心從1.875MB增加到5MB,這是歷代提升最大的一次。

- DDR5內(nèi)存頻率從4800MHz提升到5600MHz。

- UPI總線速度從16GT/s提供到20GT/s。。

- 芯片拓?fù)浣Y(jié)構(gòu)更改,四芯片封裝改為雙芯片。

- 待機(jī)功耗降低,通過(guò)全集成供電模塊(FIVR)、增強(qiáng)主動(dòng)空閑模式等技術(shù)實(shí)現(xiàn)。

四是三級(jí)緩存。

至強(qiáng)處理器以前每核心的三級(jí)緩存都只有1-2MB,這次直接來(lái)到了5MB,總?cè)萘孔疃噙_(dá)320MB。

在數(shù)據(jù)集不是很大的情況下,三級(jí)緩存本身就可以基本承載,無(wú)需轉(zhuǎn)移到系統(tǒng)內(nèi)存,從而帶來(lái)極大的性能提升。

但是,緩存容量并不是單純堆起來(lái)的,因?yàn)榇缶彺鏁?huì)面臨可靠性問(wèn)題,尤其是在大規(guī)模數(shù)據(jù)中心里存在一個(gè)比特反轉(zhuǎn)的軟故障,緩存越大,故障幾率越高,當(dāng)錯(cuò)誤足夠多而無(wú)法糾正的時(shí)候就會(huì)導(dǎo)致系統(tǒng)宕機(jī)。

這就需要超強(qiáng)的糾錯(cuò)機(jī)制,五代至強(qiáng)就采用了新的編碼方式DEC、TED,一個(gè)緩存行出現(xiàn)兩個(gè)位錯(cuò)誤的時(shí)候也可以糾正,三個(gè)位錯(cuò)誤的時(shí)候也可以檢測(cè),比傳統(tǒng)單位糾錯(cuò)、兩位檢錯(cuò)有著更強(qiáng)的容錯(cuò)性,此外還有一些新的數(shù)據(jù)修復(fù)方案。

五是內(nèi)存IO。

DDR5-4800升級(jí)到DDR5-5600,看似幅度不大,但其實(shí)很不容易,因?yàn)閮?nèi)存速度提升后,從芯片到基板需要全線進(jìn)行優(yōu)化匹配,包括供電和噪音控制等。

為了保證高頻下的信號(hào)完整性,五代至強(qiáng)還加入了4-tap DFE功能,盡可能減少碼間干擾(ISI)。

最后再單獨(dú)說(shuō)說(shuō)基于至強(qiáng)這樣的通用處理器的AI負(fù)載應(yīng)用,以及相應(yīng)的解決方案。

其實(shí),AI應(yīng)用并非只是大模型,還有大量的傳統(tǒng)非大模型AI應(yīng)用,都非常適合在CPU上部署。

比如基因測(cè)序這樣的科學(xué)計(jì)算,2018年至今,至強(qiáng)每一代都有顯著提升,因?yàn)榭茖W(xué)計(jì)算很多時(shí)候就是“暴力”計(jì)算,最考驗(yàn)CPU的處理能力。

除了硬件上的支持,Intel還有強(qiáng)大的軟件生態(tài)優(yōu)化,包括基于OpenVINO對(duì)整個(gè)模型進(jìn)行優(yōu)化、量化,在推薦、語(yǔ)音識(shí)別、圖像識(shí)別、基因測(cè)序等方面Intel都做了大量的優(yōu)化。

比如模型非常大的推薦系統(tǒng)、稀疏矩陣等應(yīng)用,CPU的效率其實(shí)優(yōu)于GPU,因?yàn)閱蝹€(gè)GPU不夠用的時(shí)候就得跨GPU,或者和CPU頻繁交互傳輸,而在與內(nèi)存互通方面CPU的效率是更高的。

其他像是網(wǎng)絡(luò)、數(shù)據(jù)服務(wù)、存儲(chǔ)等等,至強(qiáng)無(wú)論性能還是能效都在行業(yè)處于領(lǐng)先地位,更關(guān)鍵的是系統(tǒng)故障率非常低。

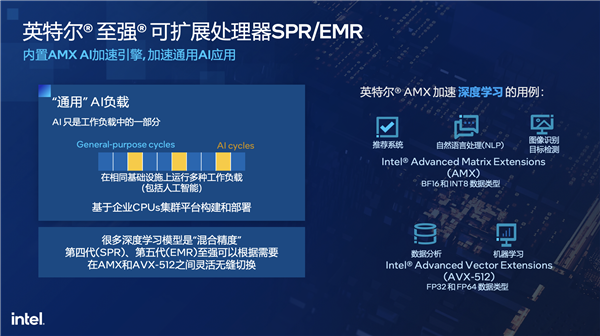

對(duì)于通用的AI工作負(fù)載,Intel采用了AMX、AVX-512兩個(gè)指令集,并基于OpenVINO進(jìn)行優(yōu)化。

AMX適合處理BF16、INT8數(shù)據(jù)類型,比如推薦系統(tǒng)、自然語(yǔ)言處理、圖像識(shí)別與目標(biāo)檢測(cè)等等。

AVX-512適合處理FP32、FP64數(shù)據(jù)類型,比如數(shù)據(jù)分析、機(jī)器學(xué)習(xí)等等。

在推理的過(guò)程中,指令集還可以進(jìn)行靈活切分,通過(guò)加速器定向加速某一部分,替代基于GPU的AI模型是完全沒(méi)有問(wèn)題的。

事實(shí)上,AI只是工作負(fù)載的一部分,更多的是通用負(fù)載,很多深度學(xué)習(xí)模型也都是“混合精度”,四代、五代至強(qiáng)運(yùn)行它們的時(shí)候都可以根據(jù)需要在AMX、AVX-512之間靈活無(wú)縫切換。

針對(duì)大模型的加速,Intel也推出了自己的框架BigDL LLM,有很多框架層針對(duì)CPU進(jìn)行了大量的優(yōu)化,并針對(duì)模型做了量化。

另外,Intel擁有開(kāi)放的生態(tài),行業(yè)伙伴和友商都可以直接納用,這對(duì)Intel自身來(lái)說(shuō)也是一件好事,可以帶動(dòng)整個(gè)生態(tài)的發(fā)展,讓Intel的解決方案得到更廣泛的普及。

總的來(lái)說(shuō),在這個(gè)AI時(shí)代,CPU、GPU、NPU等各種計(jì)算引擎都有自己的獨(dú)特優(yōu)勢(shì),都有自己的適用場(chǎng)景和領(lǐng)域,不存在誰(shuí)取代誰(shuí),更多的是靈活的選擇與協(xié)同的高效,需要結(jié)合具體業(yè)務(wù)的能效、成本等多方面綜合考慮。

CPU作為最傳統(tǒng)的通用計(jì)算引擎,始終都會(huì)占據(jù)不可替代的地位,無(wú)論是作為整個(gè)計(jì)算平臺(tái)的中心樞紐,還是對(duì)各種通用負(fù)載、AI負(fù)載的靈活處理,未來(lái)依然可以橫刀立馬!