4月9日消息,AMD今天宣布,旗下的Versal自適應(yīng)片上系統(tǒng)(SoC)產(chǎn)品升級全新第二代,包括面向AI驅(qū)動型嵌入式系統(tǒng)第二代的Versal AI Edge系列、面向經(jīng)典嵌入式系統(tǒng)的第二代Versal Prime系列。

新一代產(chǎn)品很好地平衡了性能、功耗、面積,以及先進的功能安全與信息安全,可廣泛應(yīng)用于汽車、工業(yè)、視覺、醫(yī)療、廣播、專業(yè)音視頻等市場領(lǐng)域。

新品在單器件內(nèi)集成了預(yù)處理、AI推理、后處理,可為AI嵌入式系統(tǒng)提供端到端的全程加速。

這也是AMD董事會主席及CEO蘇姿豐此前提出的“AI無處不在”戰(zhàn)略的最新體現(xiàn)。

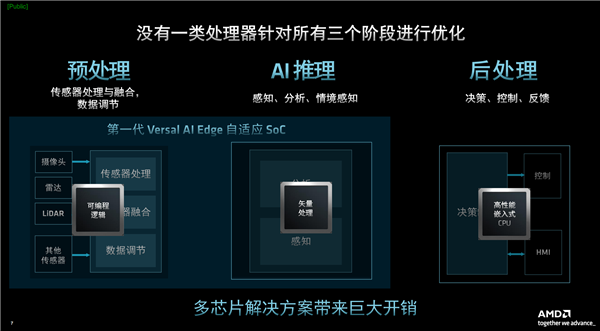

對于AI驅(qū)動的嵌入式系統(tǒng),核心當(dāng)然是AI推理,也就是AI算法執(zhí)行的階段,但是預(yù)處理、后處理兩個階段同樣不容忽視。

一般而言,預(yù)處理階段主要是攝像頭、雷達、激光雷達等傳感器的處理、融合,以及數(shù)據(jù)的交集和調(diào)節(jié)。

這一階段需要嵌入式系統(tǒng)與環(huán)境進行實時交互與處理,決定著整個系統(tǒng)的性能,因此需要可編程邏輯來實現(xiàn)靈活的實時處理,包括連接任意傳感器和接口,保證低時延、確定性,以及現(xiàn)場部署后依然可升級,一般還要加上FPGA、SoC進行優(yōu)化。

AI推理階段需要實時嵌入式系統(tǒng)解決感知、分析、情境感知問題,一般使用矢量處理器,也就是非自適應(yīng)性SoC。

后處理階段需要實現(xiàn)決策、控制、反饋,一般使用高性能嵌入式CPU。

這三個階段都必須能夠加速,才可以真正實現(xiàn)全系統(tǒng)的實時。

但是,之前沒有任何一類處理器可以同時針對三個階段進行優(yōu)化加速,都需要多芯片共同組成解決方案。

比如說用AMD第一代Versal AI Edge系列的可編程邏輯做預(yù)處理,然后用矢量處理或者AI引擎做推理,后處理階段再配置外部處理器。

類似方案都存在功耗更高、供電更復(fù)雜、占用空間更大、外部內(nèi)存需求更多、芯片間時延更長等問題,還容易存在更多安全漏洞。

AMD的第二代 Versal 系列自適應(yīng)SoC以第一代為基礎(chǔ)升級而來。

無論是面向AI驅(qū)動型嵌入式系統(tǒng)的AI Edge系列,還是面向經(jīng)典嵌入式系統(tǒng)的Prime系列,同樣具備強大的全新AI引擎,每瓦TOPS算力(即能效)是第一代AI Edge系列的最多3倍。

處理系統(tǒng)部分(PS)集成了全新的高性能Arm CPU核心,包括Cortex-A78AE應(yīng)用處理器核心、Cortex-R52實時處理器核心,標量計算性能預(yù)計可比第一代提升最多10倍,

全新的AMD可編程邏輯(PL),具備領(lǐng)先的自適應(yīng)計算能力,可實現(xiàn)靈活的實時預(yù)處理。

此外還集成了Arm Mali-G78AE GPU圖形核心、DDR5/LPDDR5X內(nèi)存控制器、PCIe 5.0控制器、100G以太網(wǎng)控制器、DPS圖像信號處理器、視頻編解碼器、功能與信息安全模塊、處理器接口、視頻處理單元等等眾多單元,單顆芯片搞定一切。

正因為如此,AMD第二代Versal才是真正的自適應(yīng)SoC,才能在單個器件中提供端到端的全程加速。

單芯片設(shè)計的高級程度,還可以大大降低系統(tǒng)功耗、占用空間、復(fù)雜性。

功能安全性增強之后,也不再需要外部安全微控制器,或者外部存儲,不需要在多個處理器之間共享。

第二代Versal AI Edge系列器件通過采用最優(yōu)處理器組合,能夠為AI驅(qū)動型嵌入式系統(tǒng)的全部三個階段進行加速,滿足現(xiàn)實系統(tǒng)的復(fù)雜處理需求。

在預(yù)處理階段,AMD FPGA可編程邏輯架構(gòu)用于實時處理,可以密集、靈活地連接各種傳感器,包括各種圖像傳感器、攝像頭、激光雷達、超聲波、定位系統(tǒng)、IMU慣性測量單元、內(nèi)窺鏡探頭等等,并進行高吞吐量、低時延的數(shù)據(jù)處理。

可編程邏輯的引入,能夠擺脫對外部存儲、CPU/GPU處理器的依賴,并針對特定任務(wù)進行定制優(yōu)化,從而直接連接到推理加速卡,大大節(jié)省執(zhí)行時間。

可編程I/O則支持廣泛的不同傳輸速率、電壓和工作模式,相比固定I/O更加靈活。

推理階段,矢量處理器陣列構(gòu)成了下一代 AI引擎“AIE-ML v2”。

它內(nèi)置硬化控制處理器,不再需要使用可編程邏輯進行控制,因此可以將可編程邏輯資源釋放用于傳感器、硬圖像和視頻等數(shù)據(jù)的處理。

新的AI引擎還原生支持更多數(shù)據(jù)類型,包括全新的FP8、FP16、MX6、MX9,并繼續(xù)支持INT8、INT16、BF16。

Dense性能方面,INT16算力最高46TOPS,F(xiàn)P16、BF16算力最高92TOPS,INT8、FP8、FPMX9算力最高184TOPS,MX6算力最高369TOPS。

最高稀疏度算力更高,比如INT8最高可以達到368TOPS。

MX6、MX9屬于共享指數(shù)數(shù)據(jù)類型,可以節(jié)省每個元素所占用的字節(jié)數(shù),其中MX6對比INT8的能效可提升多達60%,而且精度類似甚至更高。

為了充分釋放AI引擎的算力性能,AMD同時提供了Vitis AI開發(fā)環(huán)境,提供豐富的量化器、剪枝、模型編譯器與工具、運行時、驅(qū)動、固件等全套開發(fā)資源,以及培訓(xùn)、文檔、參考設(shè)計等。

它還支持開源生態(tài)系統(tǒng),采用行業(yè)標準框架,包括PyTorch、TensorFlow、ONNX、Triton等等,也支持第三方量化器和稀疏工具。

對于各種模型、運算符、數(shù)據(jù)類型,Vitis AI環(huán)境都支持開箱即用,包括卷積神經(jīng)網(wǎng)絡(luò)(CNN)、視覺Transformer等等。

后處理階段,Arm CPU內(nèi)核可為安全關(guān)鍵型應(yīng)用提供復(fù)雜決策與控制所需的能力。

針對復(fù)雜決策與繁重工作負載的應(yīng)用處理單元(APU),基于Arm Cortex-A78AE核心,最高頻率2.2GHz,算力高達200.3K DMIPS,是上代的最多8倍。

針對控制功能的實時處理單元(RPU),則基于Arm Cortex-R52核心,最高頻率1.05GHz,算力高達28.5K DMIPS,是上代的最多10倍。

另外,因為未來需要通過車規(guī)級認證、安全認證,尤其是高級別型號會用于ASIL D汽車、SIL 3工業(yè)和機器人領(lǐng)域,必須應(yīng)對隨機故障,確保功能安全與信息安全,所以在鎖步模式下算力性能會減半,以便留出足夠的冗余空間。

當(dāng)然,理論指標和性能最終要轉(zhuǎn)化為實際應(yīng)用,才能真正體現(xiàn)出來。

比如高級自動駕駛輔助系統(tǒng)L2+/L3,由于加入硬圖像處理功能,圖像處理性能可達上代的4倍,但功耗基本不變。

比如智慧城市,往往需要大量攝像頭和視頻,可以為邊緣AI設(shè)備縮小30%的占板面積,比并支持2倍的視頻流,也就是每路視頻流占板面積縮小多達65%。

再比如視頻流,一般用于專業(yè)音視頻和廣播場景,可實現(xiàn)非常高精度的流量,每秒約60幀,相比于之前的Zyng MPSoC可提供2倍的視頻處理能力,每路視頻流占板面積也縮小35%。

兩代產(chǎn)品性能級別對比,可以看到?jīng)]有任何交叉重疊,可以互為補充、針對不同應(yīng)用和場景。

上一代產(chǎn)品更多的是邊緣傳感器后者CPU計算卸載,二代產(chǎn)品則主要是中央計算。

合作案例方面,斯巴魯已選擇第二代Versal AI Edge系列,用于其下一代高級輔助駕駛(ADAS)的視覺系統(tǒng)“EyeSight”。

該系統(tǒng)會集成于斯巴魯?shù)牟糠周囆停瑢崿F(xiàn)先進安全功能,包括自適應(yīng)巡航控制、車道保持輔助、預(yù)碰撞制動等等,致力于實現(xiàn)全年消除致命性道路事故的安全目標。

第二代Versal Prime系列結(jié)合了面向傳感器處理的可編程邏輯,以及高性能嵌入式Arm CPU,可以為傳統(tǒng)的非AI嵌入式系統(tǒng)提供端到端加速。

它也能提供最多10倍與初代產(chǎn)品的標量算力,高效執(zhí)行傳感器處理、復(fù)雜標量工作負載。

同時,得益于針對8K等高吞吐量視頻處理的全新硬 IP,第二代Versal Prime系列非常適合超高清視頻流與錄制、工業(yè)PC等應(yīng)用。

AMD第二代Versal AI Edge系列、第二代Versal Prime系列將于2025年上半年提供樣品,2025年年中提供評估套件和系統(tǒng)模塊(SOM),2025年年底量產(chǎn)上市。

目前,客戶和開發(fā)者已經(jīng)可以獲取早期訪問文檔、參與早期使用計劃,AMD也正在與主要客戶進行接洽。