7 月 2 日消息,騰訊昨日發(fā)布其自研星脈網(wǎng)絡(luò) 2.0 版本,升級(jí)后的星脈網(wǎng)絡(luò)支持單集群 10 萬(wàn)卡組網(wǎng),網(wǎng)絡(luò)通信效率比上一代提升 60%,大模型訓(xùn)練效率提升 20%,故障定位從天級(jí)降低至分鐘級(jí)。

騰訊自研交換機(jī)從 25.6T 升級(jí)到 51.2T,容量提升一倍;自研硅光模塊從 200G 升級(jí)到 400G,速率提升一倍;搭載自研算力網(wǎng)卡;整機(jī)通信帶寬 3.2T,為業(yè)界最高。

騰訊自研全新通信協(xié)議 TiTa2.0 的部署位置從交換機(jī)轉(zhuǎn)移到了網(wǎng)卡上,擁塞算法也從被動(dòng)擁塞算法升級(jí)為主動(dòng)擁塞控制算法,將星脈網(wǎng)絡(luò)的通信效率提升 30%,讓大模型的訓(xùn)練效率提升 10%。

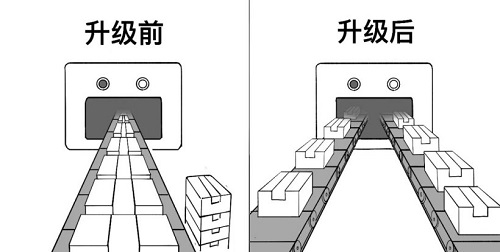

騰訊全新高性能集合通信庫(kù) TCCL2.0 采用 NVLINK+NET 異構(gòu)并行通信,實(shí)現(xiàn)數(shù)據(jù)的并行傳輸。Auto-Tune Network Expert 自適應(yīng)算法可以根據(jù)機(jī)型、網(wǎng)絡(luò)規(guī)模、模型算法等差異,自動(dòng)調(diào)整數(shù)據(jù)包分割大小、匹配算法等參數(shù)。星脈網(wǎng)絡(luò)通信性能提升 30%,讓大模型的訓(xùn)練效率再提升 10%。

▲ 數(shù)據(jù)的并行傳輸(騰訊云)

TiTa 與 TCCL 升級(jí)帶來(lái)的效果疊加,讓星脈網(wǎng)絡(luò)的通信效率共提升 60%,大模型訓(xùn)練效率共提升 20%。