近日,中國人工智能(AI)大模型技術(shù)廠商DeepSeek(深度求索)發(fā)布的推理大模型DeepSeek-R1火爆網(wǎng)絡,其不僅性能比肩OpenAI o1 ,并且其所需的訓練成本可能只有后者的約1/20,API的定價更是只有后者的約1/28,相當于使用成本降低了約97%。這不僅引發(fā)了外界對于OpenAI、Meta、谷歌等眾多大模型廠商嚴重依賴于高成本的英偉達AI芯片持續(xù)堆算力的“大力出奇跡”模式的質(zhì)疑,也導致了市場對于眾多市值已大漲的AI芯片股的價值需要重估的擔憂。

受此影響,在美國當?shù)貢r間1月27日的美股交易當中,Marvell大跌19.1%、博通大跌17.4%、英偉達大跌16.97%,臺積電大跌13.33%、美光大跌11.71%、AMD大跌6.37%、ASML大跌5.75%。

DeepSeek-V3橫空出世:性能比肩GPT-4o,訓練成本僅為其1/20

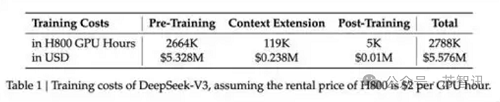

早在2024年12月26日,DeepSeek就通過官方微信公眾號發(fā)布推文稱,旗下全新系列模型DeepSeek-V3首個版本上線并同步開源。國外獨立評測機構(gòu)Artificial Analysis測試了DeepSeek-V3后表示,“DeepSeek-V3超越了迄今為止所有開源模型。”更為關(guān)鍵的是,該模型使用英偉達H800 GPU在短短兩個月內(nèi)就訓練完成,并且僅花費了約558萬美元。

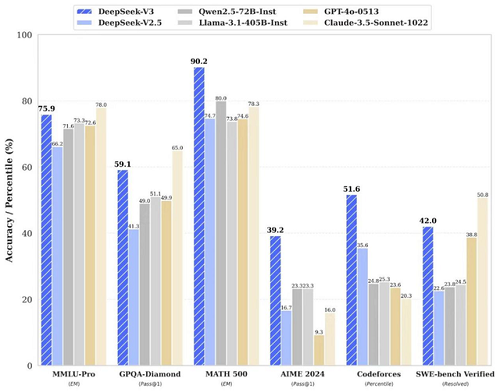

據(jù)介紹,DeepSeek-V3為自研MoE模型,671B參數(shù),激活37B,在14.8T token上進行了預訓練。DeepSeek-V3多項評測成績超越了Qwen2.5-72B和Llama-3.1-405B等其他開源模型,并在性能上和世界頂尖的閉源模型GPT-4o以及Claude-3.5-Sonnet不分伯仲。

針對DeepSeek-V3,獨立評測網(wǎng)站Artificial Anlaysis就關(guān)鍵指標——包括質(zhì)量、價格、性能(每秒生成的Token數(shù)以及首個Token生成時間)、上下文窗口等多方面——與其他人工智能模型進行對比,最終得出以下結(jié)論。

質(zhì)量:DeepSeek-V3質(zhì)量高于平均水平,各項評估得出的質(zhì)量指數(shù)為80。

價格:DeepSeek-V3比平均價格更便宜,每100萬個Token的價格為0.48美元。其中,輸入Token價格為每100萬個Token 0.27美元,輸出Token價格為每100萬個Token 1.10 美元。

速度:DeepSeek-V3比平均速度慢,其輸出速度為每秒87.5個Token。

延遲:DeepSeek-V3與平均水平相比延遲更高,接收首個Token(即首字響應時間)需要1.14秒。

上下文窗口:DeepSeek-V3的上下文窗口比平均水平小,其上下文窗口為13萬個Token。

最終Artificial Anlaysis得出結(jié)論:DeepSeek-V3模型超越了迄今為止發(fā)布的所有開放權(quán)重模型,并且擊敗了OpenAI的GPT-4o(8月),并接近Anthropic的Claude 3.5 Sonnet(10月)。DeepSeek-V3的人工智能分析質(zhì)量指數(shù)得分為80,領(lǐng)先于OpenAI的GPT-4o和Meta的Llama 3.3 70B等模型。目前唯一仍然領(lǐng)先于DeepSeek的模型是谷歌的Gemini 2.0 Flash和OpenAI的o1系列模型。領(lǐng)先于阿里巴巴的Qwen2.5 72B,成為了AI大模型領(lǐng)域的領(lǐng)先者。

更重要的是,DeepSeek使用2048塊英偉達H800 GPU在短短兩個月內(nèi)就訓練出了DeepSeek-V3,僅花費了約557.6萬美元,僅為GPT-4o(約超過1億美元)的接近二十分之一,資源運用效率極高。

OpenAI創(chuàng)始成員Karpathy也表示:“DeepSeek-V3讓在有限算力預算上進行模型預訓練這件事變得容易。DeepSeek-V3看起來比Llama-3-405B更強,訓練消耗的算力卻僅為后者的1/11。”(據(jù)外媒估計,Meta的大模型Llama-3.1的訓練投資超過了5億美元。)

當時外界對此事也有一些質(zhì)疑之聲,比如有測試發(fā)現(xiàn),DeepSeek-V3竟然聲稱自己是ChatGPT。一時間,“DeepSeek-V3是否在使用ChatGPT輸出內(nèi)容進行訓練”的質(zhì)疑聲四起。

對此,有猜測稱,DeepSeek可能用了包含GPT-4通過ChatGPT生成的文本的公共數(shù)據(jù)集。“如果DeepSeek-V3是用這些數(shù)據(jù)進行訓練的,那么該模型可能已經(jīng)記住了GPT-4的一些輸出,現(xiàn)在正在逐字反芻它們。”

不過,DeepSeek-V3也并非是第一個錯誤識別自己的模型,谷歌的Gemini等有時也會聲稱是競爭對手的模型。例如,Gemini在普通話提示下稱自己是百度的文心一言聊天機器人。造成這種情況的原因可能在于,AI公司在互聯(lián)網(wǎng)上獲取大量訓練數(shù)據(jù),但是,現(xiàn)如今的互聯(lián)網(wǎng)本就充斥著各種各樣用AI生產(chǎn)出來的數(shù)據(jù)。

DeepSeek-R1:性能比肩OpenAI o1,使用成本僅為其1/28

然而,在時隔不到1個月之后,2025年1月20日,DeepSeek又發(fā)布了全新的推理大模型DeepSeek-R1,回擊了外界的質(zhì)疑。

據(jù)介紹,DeepSeek-R1在后訓練階段大規(guī)模使用了強化學習技術(shù),在僅有極少標注數(shù)據(jù)的情況下,極大提升了模型推理能力。在數(shù)學、代碼、自然語言推理等任務上,性能比肩 OpenAI o1 正式版。

在國外大模型排名Arena上,DeepSeek-R1基準測試已經(jīng)升至全類別大模型第三。其中,在風格控制類模型(StyleCtrl)分類中與OpenAI o1并列第一;其競技場得分達到1357分,略超OpenAI o1的1352分。

1月27日,社交平臺認證為“AI投資機構(gòu)Menlo Ventures負責人”的Deedy對比谷歌Gemini和DeepSeek-R1后表示,DeepSeek-R1更便宜、上下文更長、推理性能更佳。

DeepSeek還宣布將 DeepSeek-R1 訓練技術(shù)全部公開,以期促進技術(shù)社區(qū)的充分交流與創(chuàng)新協(xié)作。

除了性能出眾之外,低成本也是DeepSeek-R1一大關(guān)鍵優(yōu)勢,雖然其預訓練費用雖然并未公開,但是猜測應該與DeepSeek-V3相當。同時,DeepSeek公布的API的定價顯示,其每百萬輸入tokens 1元(緩存命中)/4元(緩存未命中),每百萬輸出tokens 16元。DeepSeek-R1這個收費大約是OpenAI o1正式版運行成本的約1/28。OpenAI o1模型上述三項服務的定價分別約合人民幣55元、110元、438元。

也就是說,用戶使用DeepSeek-R1,即可體驗到與OpenAI o1 性能相當?shù)拇竽P褪褂皿w驗,但是使用成本只需要OpenAI o1的1/28,即成本降低了約97%。

DeepSeek掀起AI算力“革命”

眾所周知,算法、算力和數(shù)據(jù)是影響AI能力的三大核心要素,而對于通用大模型來說,經(jīng)過這兩年來發(fā)展,業(yè)界普遍認為要想實現(xiàn)AGI(通用人工智能)必須依賴于越來越龐大的大參數(shù)模型,因此需要更為強大算力來作為支持。因此我們可以看到,微軟、谷歌、Meta、X、字節(jié)跳動、亞馬遜、阿里巴巴等大廠一直在持續(xù)加大對于AI芯片的采購。

近日,在美國政府的推動下,OpenAI、軟銀、甲骨文等廠商還宣布將聯(lián)合成立一家新的AI公司“Stargate”(星際之門),未來四年將投資5000億美元,而這其中大部分資金都將被用于建設AI基礎設施。

在這些廠商對于AI芯片旺盛的需求帶動下,此也直接推動了英偉達、博通、臺積電、ASML等眾多AI芯片產(chǎn)業(yè)鏈相關(guān)廠商業(yè)績和股價的大漲。

但是,如果DeepSeek的僅利用非常低的算力和成本就能夠?qū)崿F(xiàn)高級的AI能力的模式被普遍認可,那么可能將會引發(fā)對于現(xiàn)有的依賴于堆芯片算力的AI發(fā)展模式的“革命”。

一位Meta工程師公開表示,其內(nèi)部正因DeepSeek進入“恐慌模式”。

Scale AI創(chuàng)始人Alexander Wang也表示,DeepSeek是“中國科技界帶給美國的苦澀教訓”,證明“低成本、高效率”的研發(fā)模式可能顛覆硅谷巨頭的高投入路徑。社交平臺認證為“風險投資人”的ShortBear評論稱,“DeepSeek的興起對那些商業(yè)模式為銷售大量GPU(英偉達)或購買大量GPU(OpenAI、微軟、谷歌)的公司都形成了挑戰(zhàn)。”

因此,我們可以看到,在美股1月27日的交易當中,英偉達、臺積電、博通、ASML等AI芯片產(chǎn)業(yè)鏈上的巨頭們的股價都出現(xiàn)了大幅的下跌。

不過,對于此番DeepSeek所引發(fā)的對AI芯片產(chǎn)業(yè)鏈企業(yè)價值重估的恐慌,也有分析師認為這是一個很好的投資機會,因為即使對于AI芯片需求暫時減少,但是對于AI芯片需求依然會存在,該市場也依然會由英偉達占據(jù)領(lǐng)導地位。

投行韋德布什資深股票分析師Daniel Ives在最新的研報中稱,DeepSeek使用英偉達性能較弱的芯片構(gòu)建了足以媲美OpenAI的ChatGPT和Meta的Llama 3.1的大模型,因此引起了美國科技股的波動。“但我們認為,這是另一個黃金買入機會,而不是恐慌的時候。全球只有英偉達推出自主、并用于機器人和更廣泛AI用例的芯片。DeepSeek的大模型雖然留下了深刻的印象,但不足被視作威脅。為消費者使用推出具有競爭力的LLM模型是一回事,但推出更廣泛的AI基礎設施又是另一回事。”Daniel Ives說道。

英偉達也對此回應稱:“DeepSeek是一項卓越的人工智能進展,也是測試時擴展的絕佳范例。DeepSeek的研究展示了如何運用該技術(shù),借助廣泛可用的模型以及完全符合出口管制規(guī)定的算力,創(chuàng)建新模型。推理過程需要大量英偉達GPU和高性能網(wǎng)絡。如今我們有三條擴展定律:持續(xù)適用的預訓練和后訓練定律,以及新的測試時擴展定律。”

需要指出的是,目前中國正面臨美國持續(xù)升級的對華AI芯片及先進半導體設備出口管制政策,這也使得中國難以獲取外部先進的AI芯片,也難以依靠內(nèi)部制造先進的AI芯片,因此這也迫使DeepSeek另辟蹊徑,拋棄常規(guī)的依賴于堆算力的技術(shù)發(fā)展路線,并獲得了成功,打破了美國對于中國AI的封鎖。

面壁智能首席科學家劉知遠在朋友圈發(fā)文稱,“DeepSeek最近出圈,特別好地證明了我們的競爭優(yōu)勢所在,就是通過有限資源的極致高效利用,實現(xiàn)以少勝多。2024年很多人來問我,中國跟美國的AI差距是擴大了還是縮小了,我說明顯縮小了,但能感受到大部分人還不太信服,現(xiàn)在DeepSeek等用實例讓大家看到了這點,非常贊。”

“AGI新技術(shù)還在加速演進,未來發(fā)展路徑還不明確。我們?nèi)栽谧汾s的階段,已經(jīng)不是望塵莫及,但也只能說尚可望其項背,在別人已經(jīng)探索出的路上跟隨快跑還是相對容易的。接下來我們要獨立面對一團未來迷霧,如何先人一步探出新路,是更加困難和挑戰(zhàn)的事,需要我們更加百倍投入、百倍努力。”劉知遠說。

當然,DeepSeek的成功并不是閉門造車的結(jié)果,而是博采眾長,吸取了眾多前人的經(jīng)驗(比如開源的PyTorch和Llama),這也是為什么DeepSeek的大模型也采用了開源(open-source)的模式。

圖靈獎得主、主導Meta AI研究的首席科學家Yann LeCun就指出,DeepSeek 成功的最大收獲,是AI開源的價值使任何人都能受益。

“對那些看到DeepSeek表現(xiàn)并認為‘中國在AI領(lǐng)域正超越美國’的人而言,你的解讀錯了,正確解讀應是‘開源模型正超越專有模型’。DeepSeek 從開放研究和開源獲益良多(如同PyTorch和Llama),他們提出新想法,并從其他人的工作基礎加以建構(gòu)。他們發(fā)布新的模型并開源,所以每個人都能從中受益,這就是開放研究和開源的力量。”Yann LeCun說道。