3 月 19 日消息,英偉達(dá)在今日舉行的 NVIDIA GTC 2025 上宣布其 NVIDIA Blackwell DGX 系統(tǒng)創(chuàng)下 DeepSeek-R1 大模型推理性能的世界紀(jì)錄。

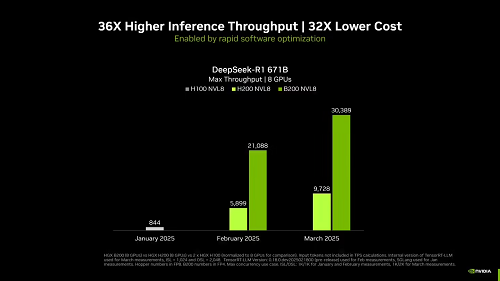

據(jù)介紹,在搭載了八塊 Blackwell GPU 的單個(gè) DGX 系統(tǒng)上運(yùn)行 6710 億參數(shù)的滿血 DeepSeek-R1 模型可實(shí)現(xiàn)每用戶每秒超 250 token 的響應(yīng)速度,系統(tǒng)最高吞吐量突破每秒 3 萬(wàn) token。

英偉達(dá)表示,隨著 NVIDIA 平臺(tái)繼續(xù)在最新的 Blackwell Ultra GPU 和 Blackwell GPU 上突破推理極限,其性能將會(huì)繼續(xù)不斷提高。

▲ 運(yùn)行 TensorRT-LLM 軟件的 NVL8 配置的 NVIDIA B200 GPU

單節(jié)點(diǎn)配置:DGX B200(8 塊 GPU)與 DGX H200(8 塊 GPU)

測(cè)試參數(shù):最新測(cè)試采用 TensorRT-LLM 內(nèi)部版本,輸入 1024 token / 輸出 2048 token;此前測(cè)試為輸入 / 輸出各 1024 token;并發(fā)

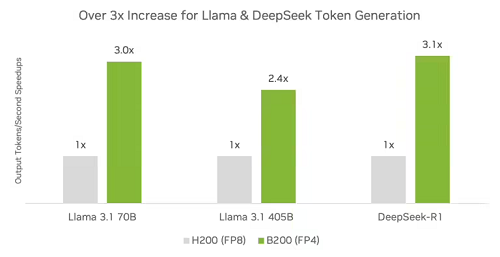

計(jì)算精度:B200 采用 FP4,H200 采用 FP8 精度

英偉達(dá)表示,通過(guò)硬件和軟件的結(jié)合,他們自 2025 年 1 月以來(lái)成功將 DeepSeek-R1 671B 模型的吞吐量提高了約 36 倍。

節(jié)點(diǎn)配置:DGX B200(8 塊 GPU)、DGX H200(8 塊 GPU)、兩個(gè) DGX H100(8 塊 GPU)系統(tǒng)

測(cè)試參數(shù):依然采用 TensorRT-LLM 內(nèi)部版本,輸入 1024 token / 輸出 2048 token;此前測(cè)試為輸入 / 輸出各 1024 token;并發(fā)性 MAX

計(jì)算精度:B200 采用 FP4,H100 / H200 采用 FP8 精度

與 Hopper 架構(gòu)相比,Blackwell 架構(gòu)與 TensorRT 軟件相結(jié)合可實(shí)現(xiàn)顯著的推理性能提升。

英偉達(dá)表示,包括 DeepSeek-R1、Llama 3.1 405B 和 Llama 3.3 70B,運(yùn)行 TensorRT 軟件并使用 FP4 精度的 DGX B200 平臺(tái)與 DGX H200 平臺(tái)相比已經(jīng)提供了 3 倍以上的推理吞吐量提升。

英偉達(dá)表示,在對(duì)模型進(jìn)行量化以利用低精度計(jì)算優(yōu)勢(shì)時(shí),確保精度損失最小化是生產(chǎn)部署的關(guān)鍵。IT之家注意到,在 DeepSeek-R1 模型上,相較于 FP8 基準(zhǔn)精度,TensorRT Model Optimizer 的 FP4 訓(xùn)練后量化(PTQ)技術(shù)在不同數(shù)據(jù)集上僅產(chǎn)生微乎其微的精度損失。