佐思汽研發(fā)布《2019-2020 汽車視覺產(chǎn)業(yè)鏈研究報(bào)告(下)雙目及其他》。 據(jù)舜宇光學(xué)觀點(diǎn),汽車攝像頭分為感知攝像頭和影像攝像頭。

感知攝像頭用于主動(dòng)安全,需要準(zhǔn)確捕捉圖像,一般用于前視和內(nèi)視。影像攝像頭用于被動(dòng)安全,并將所拍攝的圖像存儲(chǔ)或發(fā)送給用戶,一般用于環(huán)視和后視。因此,感知攝像頭和影像攝像頭在成像質(zhì)量要求和溫度可靠性要求方面完全不同。

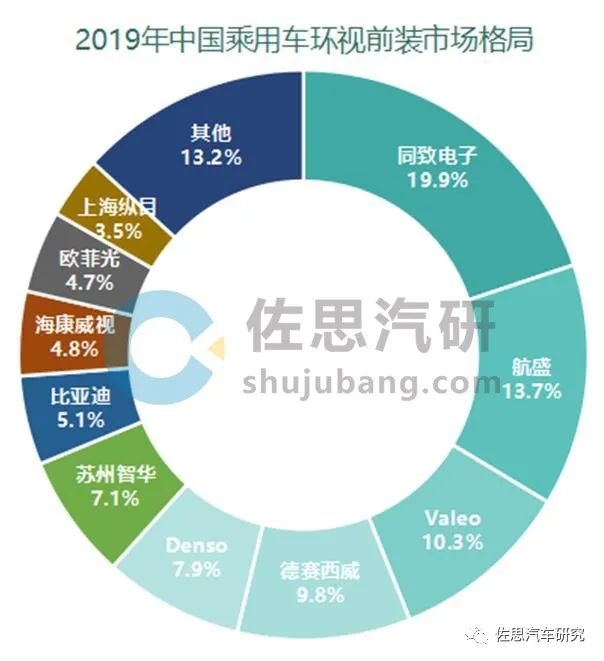

感知攝像頭用于車道檢測(cè)、信號(hào)燈檢測(cè)、道路標(biāo)志識(shí)別、車內(nèi)監(jiān)測(cè)等。如果感知攝像頭拍攝的圖像有任何錯(cuò)誤,將會(huì)引起軟件計(jì)算錯(cuò)誤,并導(dǎo)致不可避免的后果。所以,感知攝像頭的價(jià)格敏感性相對(duì)較低。 影像攝像頭對(duì)價(jià)格非常敏感,因此存在激烈的價(jià)格戰(zhàn),對(duì)性能的要求不是很高,國(guó)內(nèi)企業(yè)介入較多,但是絕大多數(shù)都不賺錢。從 2019 年中國(guó)乘用車環(huán)視前裝市場(chǎng)格局圖可知,環(huán)視市場(chǎng)各廠商份額比較分散,不像前視單目市場(chǎng)呈現(xiàn)市場(chǎng)相對(duì)集中的局面,TOP6 占據(jù) 90%以上份額。

來(lái)源:佐思汽研

前視攝像頭需要復(fù)雜的算法和芯片,前視單目的單價(jià)接近 1000 元,雙目則需 1000 多元。后視、側(cè)視以及內(nèi)置攝像頭單價(jià)在 200 元左右。

雙目領(lǐng)域取得突破

國(guó)內(nèi)初創(chuàng)企業(yè)在雙目領(lǐng)域取得了突破性進(jìn)展,尤其是在商用車和專用車市場(chǎng)。 中科慧眼雙目已經(jīng)出貨一萬(wàn)多臺(tái),主要用在 Apollo 系列無(wú)人車、江鈴輕客、環(huán)衛(wèi)車、無(wú)人船、拖拉機(jī)、巡邏車等。中科慧眼雙目產(chǎn)品的典型應(yīng)用是 AEBS 和限高檢測(cè)。大約有 30 多個(gè)城市的公交集團(tuán)裝配中科慧眼雙目系統(tǒng)。 雙目用于限高裝置的檢測(cè),是中科慧眼的首創(chuàng),除了常規(guī)的的限高桿,諸如鄉(xiāng)下的小牌坊,涵洞等各種非標(biāo)限高裝置均可準(zhǔn)確感知并及時(shí)通過聲光報(bào)警裝置提醒司機(jī)。房車、特種車輛等均有限高檢測(cè)的強(qiáng)需求。

來(lái)源:中科慧眼

2019 年,雙髻鯊宣布開發(fā)出自由雙目系統(tǒng),可以使用兩個(gè)完全獨(dú)立的單目攝像頭實(shí)現(xiàn)雙目系統(tǒng),以擺脫雙目設(shè)備體積大、工藝復(fù)雜、安裝困難、成本高等固有缺陷。

來(lái)源:雙髻鯊科技

兩個(gè)攝像頭獨(dú)立安裝,固定在車體右側(cè)即可。中間無(wú)需剛性連接,也不需要嚴(yán)格控制攝像頭的角度和間距。“自由雙目”的核心原理是自校準(zhǔn)技術(shù),即使攝像頭在使用過程中發(fā)生了輕微的變形和移動(dòng),雙髻鯊的算法會(huì)自動(dòng)檢測(cè)并重新校準(zhǔn),免除了常規(guī)雙目所需的定期重新標(biāo)定校準(zhǔn)工作。 2020 年 4 月,F(xiàn)oresight 宣布與 FLIR 合作,整合 FLIR 的紅外攝像頭,結(jié)合可見光立體視覺和熱成像立體視覺的技術(shù),在惡劣的光線和天氣條件下提供精確的障礙物檢測(cè)。兩個(gè)立體通道之間的數(shù)據(jù)融合,可以有效解決隧道口等明暗快速變化的極端情況下的不報(bào)或者誤報(bào)。

佐思發(fā)布的毫米波報(bào)告中曾指出,毫米波雷達(dá)在侵蝕其他傳感器的地盤。攝像頭也是一樣,有很多企業(yè)用單目攝像頭做測(cè)距,做 3D 成像,試圖取代雙目或激光雷達(dá)。譬如 MAXIEYE。 MAXIEYE 第一代產(chǎn)品 IFVS-200 系列基于機(jī)器學(xué)習(xí)方案,第三代產(chǎn)品 IFVS-500 系列基于深度學(xué)習(xí)方案實(shí)現(xiàn)單目測(cè)距和 3D 掃描。IFVS-500 系列讓單目視覺產(chǎn)品可以像激光雷達(dá)一樣進(jìn)行三維掃描,也可以在 50 米以內(nèi)實(shí)現(xiàn)接近激光雷達(dá)的 3D 場(chǎng)景點(diǎn)云掃描,提供目標(biāo)的直接測(cè)距功能,實(shí)現(xiàn) 200 米范圍的機(jī)動(dòng)車檢測(cè)、100 米范圍的行人及小目標(biāo)障礙物檢測(cè)。

紛紛增強(qiáng)極端場(chǎng)景下的視覺能力

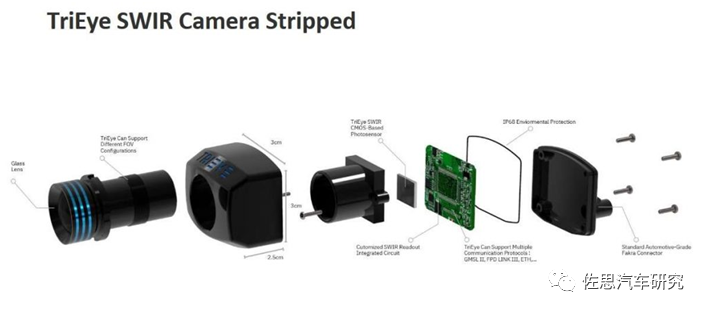

無(wú)論是車內(nèi)還是車外,都需要在光線不好甚至黑暗時(shí)獲得視覺能力,這意味著需要利用紅外技術(shù)。安森美半導(dǎo)體的 RGB-IR 圖像傳感器采用了 NIR(近紅外)技術(shù),另一家廠商 Trieye 則通過短波紅外(SWIR)相機(jī)。短波紅外相機(jī)的優(yōu)勢(shì)在于能夠在任何天氣 / 光照條件下看到物體,可以提前識(shí)別道路危險(xiǎn)(例如道路結(jié)冰)。

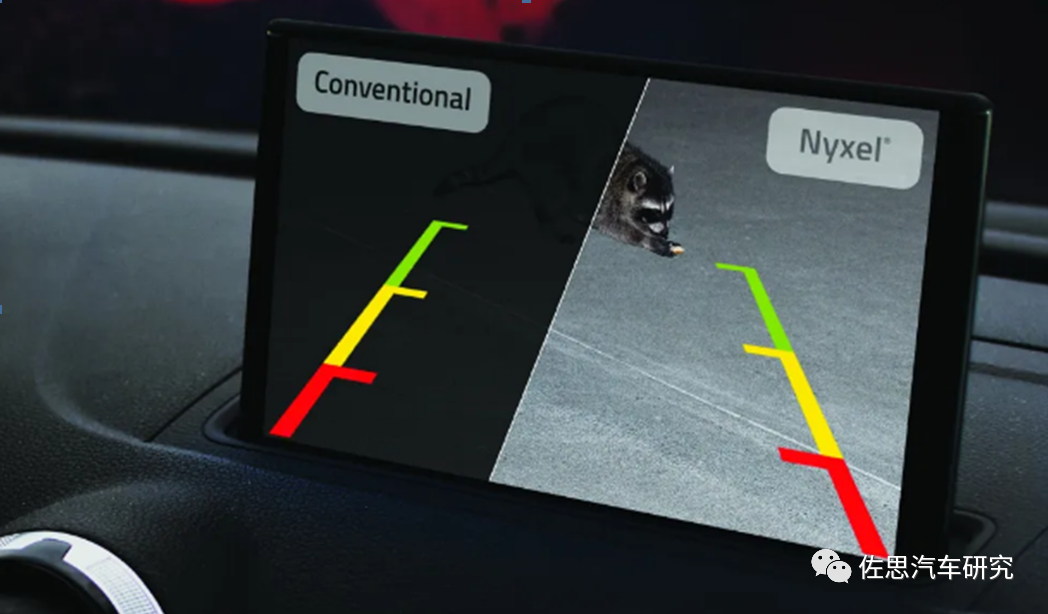

2020 年 4 月,阿里達(dá)摩院研發(fā)出用于車載攝像頭的 ISP 處理器。根據(jù)路測(cè)結(jié)果顯示,使用達(dá)摩院 ISP 處理器,車載攝像頭在夜間場(chǎng)景下,圖像物體檢測(cè)識(shí)別能力比業(yè)內(nèi)主流處理器有 10%以上的大幅度提升,原本模糊不清的標(biāo)注物也得以清晰識(shí)別。 2020 年 5 月 19 日,豪威科技正式發(fā)布搭載 Nyxel 近紅外技術(shù)的圖像傳感器 OX03A2S 。這款 250 萬(wàn)像素的 ASIL-B 等級(jí)傳感器專為外置成像應(yīng)用設(shè)計(jì),可用于車身周圍 2 米內(nèi)的弱光甚至無(wú)光環(huán)境。OX03A2S 能夠在弱光環(huán)境下檢測(cè)和識(shí)別其它圖像傳感器無(wú)法捕捉的物體。

來(lái)源:豪威科技

視覺感知進(jìn)入深水區(qū),算法決定贏家

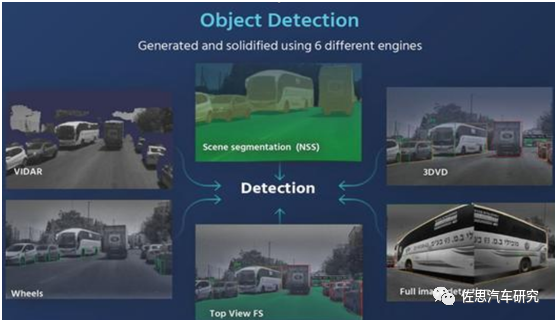

隨著智能汽車中視覺傳感器的大量增加,不同類型視覺傳感器的加入,產(chǎn)生的天量數(shù)據(jù),給算法處理帶來(lái)了挑戰(zhàn)和機(jī)會(huì)。 視覺 ADAS 算法的領(lǐng)導(dǎo)者 Mobileye 在視覺感知體系當(dāng)中,同時(shí)使用了多種相互獨(dú)立的感知算法實(shí)現(xiàn)冗余疊加,目的是為了在 Detection 和 Measurement 兩個(gè)維度上提升感知的精確度與穩(wěn)定性。Detection 是決定感知的對(duì)象是什么物體,Measurement 是通過對(duì)攝像頭的 2D 畫面進(jìn)行推算,得出感知對(duì)象的 3D 信息。 在 Detection 維度,Mobileye 就采用了 6 種獨(dú)立算法:

3D 汽車檢測(cè)(3DVD):識(shí)別 2D 畫面中的目標(biāo)車輛,將其標(biāo)注上 3D 的邊界框。

Full Image Detection:主要用于識(shí)別車輛兩側(cè)近距離的大型物體(如客車或卡車)。

Top View FS:重點(diǎn)識(shí)別畫面中沒有被占用的道路并進(jìn)行標(biāo)注。

Features Detection (如 Wheels):重點(diǎn)識(shí)別獨(dú)有特征的物體,例如車輪。

VIDAR:通過多個(gè)攝像頭的三角測(cè)量生成 3D 畫面,再將 3D 畫面導(dǎo)入到激光雷達(dá)感知算法中進(jìn)行物體識(shí)別。

Scene Segmentation(NSS):通過像素級(jí)識(shí)別,分割出不同種類的物體并用不同顏色標(biāo)注。

來(lái)源:Mobileye

特斯拉也是視覺感知算法的領(lǐng)先者,特斯拉把它的深度學(xué)習(xí)網(wǎng)絡(luò)稱為 HydraNet。整個(gè) HydraNet 包含 48 個(gè)不同的神經(jīng)網(wǎng)絡(luò),通過這 48 個(gè)神經(jīng)網(wǎng)絡(luò),就能輸出 1000 個(gè)不同的預(yù)測(cè)向量,理論上來(lái)說,HydraNet 能同時(shí)檢測(cè) 1000 種物體。為了增強(qiáng)算法能力,特斯拉特地收購(gòu)了計(jì)算機(jī)視覺初創(chuàng)公司 DeepScale。 為了在視覺感知算法上追趕特斯拉和 Mobileye,主機(jī)廠和 Tier1 們都在擴(kuò)充軟件工程師團(tuán)隊(duì)。算法能力將成為左右視覺感知性能優(yōu)劣的決定性因素之一。