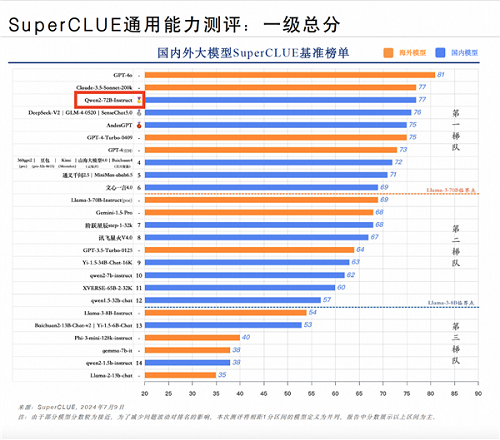

7月10日消息,根據(jù)SuperCLUE發(fā)布的中文大模型基準測評最新報告,阿里通義千問開源模型Qwen2-72B-Instruct以卓越的表現(xiàn)位居國內(nèi)通用能力第一,更在全球范圍內(nèi)成為最強開源模型。

SuperCLUE報告詳細披露了對國內(nèi)外33個大模型的綜合測評結(jié)果,Qwen2-72B在一級總分上以77分的高分與Claude-3.5-Sonnet并列第二,僅次于OpenAI的GPT-4o。

這一得分超越了百度文心一言4.0、訊飛星火V4.0、Llama-3-70B等開閉源大模型。

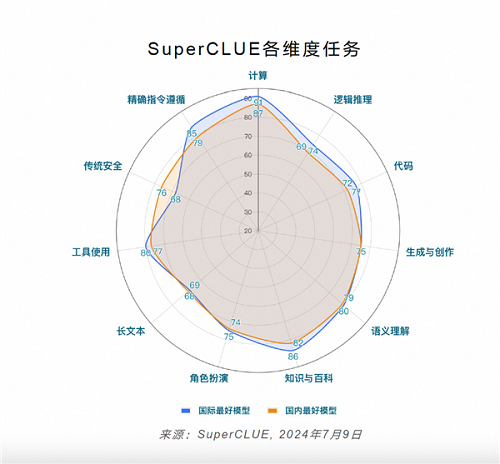

具體來看,在理科、文科和Hard三個維度的具體測評中,Qwen2-72B展現(xiàn)了全面而均衡的能力。

特別是在理科任務(wù)上,Qwen2-72B與GPT-4o的分差僅為5分,顯示出其在計算、邏輯推理和代碼測評方面的強勁實力。

在文科任務(wù)和Hard任務(wù)上,Qwen2-72B同樣表現(xiàn)不俗,得分均達到了76分,與GPT-4o的得分相差無幾。

特別值得一提的是,在端側(cè)小模型測評中,Qwen2-7B以70億參數(shù)的模型規(guī)模,超越了上一代320億參數(shù)的Qwen1.5-32B和130億參數(shù)的Llama-3-8B-Instruct,奪得了排名第一的寶座。

這一成績不僅證明了Qwen2-7B在小尺寸模型中的極致性能,也極大提升了端側(cè)小模型落地的可行性。

數(shù)據(jù)顯示,截至目前Qwen系列模型的下載量已突破2000萬次,其應(yīng)用場景覆蓋了工業(yè)、金融、醫(yī)療、汽車等多個垂直領(lǐng)域。

本站內(nèi)容除特別聲明的原創(chuàng)文章之外,轉(zhuǎn)載內(nèi)容只為傳遞更多信息,并不代表本網(wǎng)站贊同其觀點。轉(zhuǎn)載的所有的文章、圖片、音/視頻文件等資料的版權(quán)歸版權(quán)所有權(quán)人所有。本站采用的非本站原創(chuàng)文章及圖片等內(nèi)容無法一一聯(lián)系確認版權(quán)者。如涉及作品內(nèi)容、版權(quán)和其它問題,請及時通過電子郵件或電話通知我們,以便迅速采取適當措施,避免給雙方造成不必要的經(jīng)濟損失。聯(lián)系電話:010-82306118;郵箱:[email protected]。