10 月 29 日消息,北京智源人工智能研究院(BAAI)推出了新的擴散模型架構(gòu) OmniGen,這是一種用于統(tǒng)一圖像生成的多模態(tài)模型。

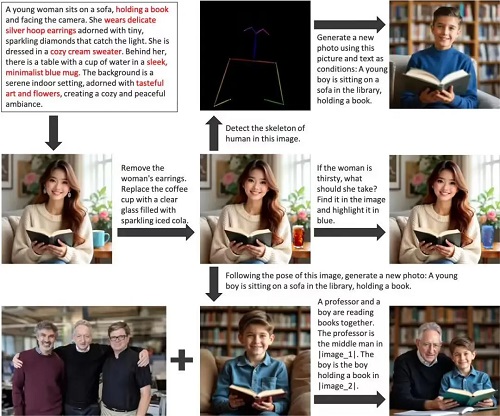

▲ 文本生成圖像,編輯生成圖像的部分元素,根據(jù)生成圖像的人體姿態(tài)生成重繪圖像,從另一圖像中提取所需對象與新圖像融合

官方表示,OmniGen 具有以下特點:

統(tǒng)一性:OmniGen 天然地支持各種圖像生成任務,例如文生圖、圖像編輯、主題驅(qū)動生成和視覺條件生成等。此外,OmniGen 可以處理經(jīng)典的計算機視覺任務,將其轉(zhuǎn)換為圖像生成任務。

簡單性:OmniGen 的架構(gòu)高度簡化。此外,與現(xiàn)有模型相比,它更加用戶友好,可以通過指令完成復雜的任務,而不需要冗長的處理步驟和額外的模塊 (如 ControlNet 或 IP-Adapter),從而大大簡化了工作流程。

知識遷移:受益于統(tǒng)一格式的學習,OmniGen 有效地跨不同任務遷移知識,應對未見過的任務和領(lǐng)域,并展示新穎的功能。我們還探討了模型的推理能力和思維鏈機制的在圖像生成領(lǐng)域的潛在應用。

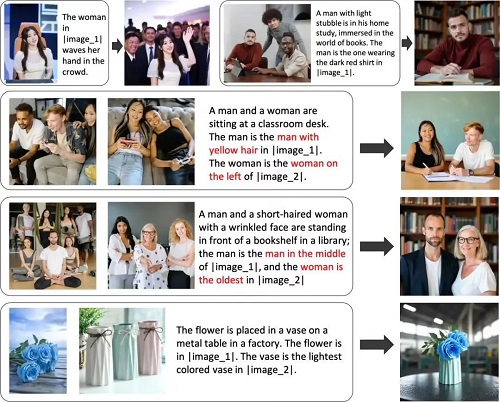

▲ 指代表達生成

本站內(nèi)容除特別聲明的原創(chuàng)文章之外,轉(zhuǎn)載內(nèi)容只為傳遞更多信息,并不代表本網(wǎng)站贊同其觀點。轉(zhuǎn)載的所有的文章、圖片、音/視頻文件等資料的版權(quán)歸版權(quán)所有權(quán)人所有。本站采用的非本站原創(chuàng)文章及圖片等內(nèi)容無法一一聯(lián)系確認版權(quán)者。如涉及作品內(nèi)容、版權(quán)和其它問題,請及時通過電子郵件或電話通知我們,以便迅速采取適當措施,避免給雙方造成不必要的經(jīng)濟損失。聯(lián)系電話:010-82306118;郵箱:[email protected]。