增強(qiáng)視覺(jué)傳感器功能:3D圖像拼接算法幫助擴(kuò)大視場(chǎng)

2025-01-04

作者:Rajesh Mahapatra,,高級(jí)經(jīng)理 Anil Sripadarao,,首席工程師 Swastik Mahapatra,高級(jí)工程師

來(lái)源:ADI公司

摘要

得益于出色的深度計(jì)算和紅外(IR)成像能力,,飛行時(shí)間(TOF)攝像頭在工業(yè)應(yīng)用,,尤其是機(jī)器人領(lǐng)域越來(lái)越受歡迎,。盡管具有這些優(yōu)勢(shì),但光學(xué)系統(tǒng)的固有復(fù)雜性往往會(huì)約束視場(chǎng),,從而限制獨(dú)立功能,。本文中討論的3D圖像拼接算法專為支持主機(jī)處理器而設(shè)計(jì),無(wú)需云計(jì)算,。該算法將來(lái)自多個(gè)TOF攝像頭的紅外和深度數(shù)據(jù)實(shí)時(shí)無(wú)縫結(jié)合,,生成連續(xù)的高質(zhì)量3D圖像,該圖像具有超越獨(dú)立單元的擴(kuò)大視場(chǎng),。借助拼接的3D數(shù)據(jù),,應(yīng)用先進(jìn)的深度學(xué)習(xí)網(wǎng)絡(luò)能夠徹底改變可視化及與3D環(huán)境的交互,深度學(xué)習(xí)網(wǎng)絡(luò)在移動(dòng)機(jī)器人應(yīng)用中特別有價(jià)值,。

簡(jiǎn)介

飛行時(shí)間(TOF)攝像頭作為出色的測(cè)距成像系統(tǒng)脫穎而出,,它利用TOF技術(shù)來(lái)確定攝像頭與圖像中每個(gè)點(diǎn)之間的距離。通過(guò)測(cè)量激光器或LED發(fā)射的人造光信號(hào)的往返時(shí)間,,便可計(jì)算出距離,。TOF攝像頭提供精確的深度信息,因此在準(zhǔn)確距離測(cè)量和3D可視化至關(guān)重要的應(yīng)用中,,比如在機(jī)器人和工業(yè)技術(shù)應(yīng)用中,,該攝像頭是極具價(jià)值的工具,,例如能夠在270°的視場(chǎng)(FOV)范圍執(zhí)行碰撞檢測(cè)和人體檢測(cè),從而提高安全性,。

ADTF3175 TOF傳感器的校準(zhǔn)FOV可達(dá)到75°,。然而,當(dāng)應(yīng)用的FOV超出該區(qū)域時(shí),,挑戰(zhàn)出現(xiàn),,此時(shí)就需要多個(gè)傳感器。如果通過(guò)集成各個(gè)傳感器的數(shù)據(jù)來(lái)為整個(gè)視場(chǎng)提供全面的分析,,這可能會(huì)造成困難,。一個(gè)潛在解決方案是讓傳感器對(duì)部分FOV執(zhí)行算法,然后將輸出傳輸至主機(jī)以進(jìn)行整理,。然而,,該方法面臨區(qū)域重疊、死區(qū)和通信延遲等問(wèn)題,,導(dǎo)致其成為很難有效解決的復(fù)雜問(wèn)題,。

另一種方法是將從所有傳感器捕獲的數(shù)據(jù)拼接成單個(gè)圖像,隨后在拼接的圖像上應(yīng)用檢測(cè)算法,。該過(guò)程可卸載至單獨(dú)的主機(jī)處理器,,從而減輕傳感器單元的計(jì)算負(fù)荷,留出空間執(zhí)行高級(jí)分析和其他處理選項(xiàng),。然而,,值得注意的是,傳統(tǒng)圖像拼接算法本身非常復(fù)雜,,會(huì)消耗主機(jī)處理器相當(dāng)一部分的計(jì)算能力,。此外,由于隱私原因,,在許多應(yīng)用中,,數(shù)據(jù)無(wú)法發(fā)送到云端進(jìn)行拼接。

ADI公司的算法解決方案可使用深度數(shù)據(jù)的點(diǎn)云投影,,拼接來(lái)自不同傳感器的深度和紅外圖像,。這包括使用攝像頭外部位置轉(zhuǎn)換捕獲到的數(shù)據(jù)并將其投影回到2D空間,從而生成單張連續(xù)顯示的圖像,。

該方法能夠大幅減少計(jì)算量,,有助于在邊緣達(dá)到實(shí)時(shí)運(yùn)行的速度,并確保主機(jī)處理器的計(jì)算能力仍可用于其他高級(jí)分析,。

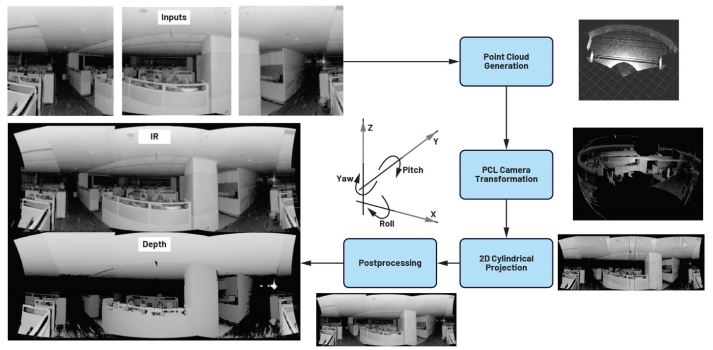

圖1.深度拼接算法,。

解決方案描述

ADI的3D TOF解決方案分4個(gè)階段運(yùn)行(參見(jiàn)圖1):

1.預(yù)處理紅外和深度數(shù)據(jù):紅外和深度數(shù)據(jù)的時(shí)間同步及預(yù)處理。

2.將深度數(shù)據(jù)投影到3D點(diǎn)云:利用攝像頭內(nèi)參將深度數(shù)據(jù)投影到3D點(diǎn)云。

3.轉(zhuǎn)換和合并點(diǎn):使用攝像頭的外部位置對(duì)點(diǎn)云進(jìn)行坐標(biāo)轉(zhuǎn)換,,并合并重疊區(qū)域,。

4.將點(diǎn)云投影到2D圖像:采用圓柱投影將點(diǎn)云投影回到2D圖像。

系統(tǒng)與算法的挑戰(zhàn)及解決方案

主機(jī)接收深度和紅外幀

主機(jī)通過(guò)USB等高速連接方式連接到多個(gè)TOF傳感器,。主機(jī)收集深度和紅外幀,,并將其存儲(chǔ)在隊(duì)列中。

同步深度和紅外數(shù)據(jù)

主機(jī)接收到的來(lái)自每個(gè)傳感器的深度和紅外幀在不同時(shí)間實(shí)例被捕獲,。為了避免因物體移動(dòng)而造成的時(shí)間不匹配,,所有傳感器的輸入需要同步到同一時(shí)間實(shí)例。使用時(shí)間同步器模塊,,該模塊根據(jù)來(lái)自隊(duì)列的時(shí)間戳匹配傳入的幀,。

投影到點(diǎn)云

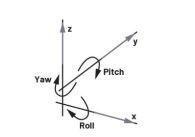

通過(guò)使用每個(gè)傳感器的同步深度數(shù)據(jù),在主機(jī)上生成點(diǎn)云,。然后,,每個(gè)點(diǎn)云根據(jù)其各自在真實(shí)場(chǎng)景中的攝像頭位置(參見(jiàn)圖2)進(jìn)行轉(zhuǎn)換(平移和旋轉(zhuǎn))。接著,,這些轉(zhuǎn)換后的點(diǎn)云合并形成單個(gè)連續(xù)點(diǎn)云,,覆蓋傳感器的組合FOV(參見(jiàn)圖3)。

圖2.相機(jī)外參,。

圖3.合并的點(diǎn)云,。

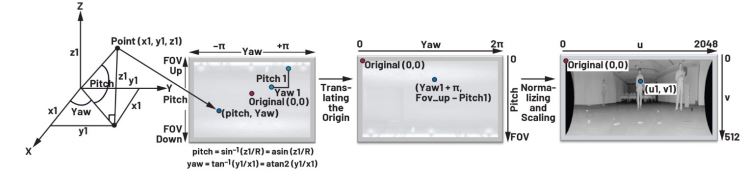

3D到2D投影

通過(guò)使用圓柱投影算法,也稱為前視圖投影,,F(xiàn)OV的組合點(diǎn)云投影到2D畫(huà)布上(參見(jiàn)圖4)。換言之,,該算法將合并點(diǎn)云的每個(gè)點(diǎn)投影到2D平面的像素上,,從而生成單一連續(xù)全景圖,覆蓋所有傳感器的組合視場(chǎng),。這會(huì)產(chǎn)生兩個(gè)2D拼接圖像:一個(gè)用于拼接的紅外圖像,,另一個(gè)用于投影到2D平面的拼接深度圖像。

圖4.圓柱投影算法,。

提高投影質(zhì)量

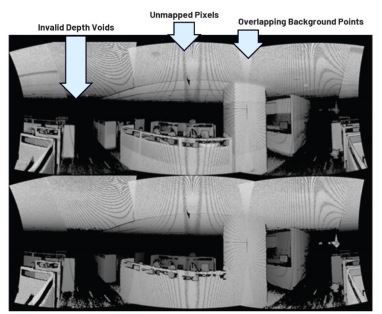

將3D組合點(diǎn)云投影到2D圖像仍無(wú)法生成高質(zhì)量圖像,。圖像存在失真和噪點(diǎn)。這不僅影響視覺(jué)質(zhì)量,,對(duì)投影上運(yùn)行的任何算法也會(huì)產(chǎn)生不利影響,。以下章節(jié)記錄了3個(gè)關(guān)鍵問(wèn)題(參見(jiàn)圖5)及其解決方法。

圖5.2D投影問(wèn)題,。

投影無(wú)效深度區(qū)域

對(duì)于超出傳感器工作范圍(8000 mm)的點(diǎn),,ADTF3175的深度數(shù)據(jù)的無(wú)效深度值為0 mm。這會(huì)導(dǎo)致深度圖像上出現(xiàn)大片空白區(qū)域,并形成不完整的點(diǎn)云,。將深度值8000 mm(攝像頭支持的最大深度)分配給深度圖像上的所有無(wú)效點(diǎn),,并利用該值生成點(diǎn)云。這確保了點(diǎn)云沒(méi)有間隙,。

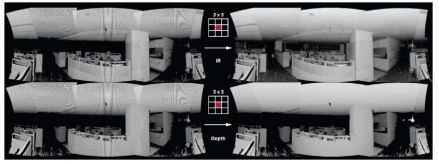

填充未映射的像素

將3D點(diǎn)云投影到2D平面時(shí),,2D圖像中存在未映射/未填充的區(qū)域。許多點(diǎn)云(3D)像素映射至同一個(gè)2D像素,,因此多個(gè)2D像素仍是空白,。這就會(huì)產(chǎn)生如圖6所示的拉伸圖案。為解決該問(wèn)題,,我們使用3 × 3過(guò)濾器,,用其相鄰的8個(gè)具備有效值的像素的平均紅外/深度值來(lái)填充未映射的像素。這樣便可獲得更完整的輸出圖像,,并消除偽影(參見(jiàn)圖6),。

重疊點(diǎn)產(chǎn)生的噪點(diǎn)

得益于圓柱投影算法,重疊區(qū)域上的許多點(diǎn)最終在2D投影輸出上獲得相同的靜止坐標(biāo),。由于背景像素與前景像素重疊,,因此會(huì)產(chǎn)生噪點(diǎn)。為解決該問(wèn)題,,我們將每個(gè)點(diǎn)的徑向距離與現(xiàn)有點(diǎn)進(jìn)行比較,,僅當(dāng)與攝像頭原點(diǎn)的距離小于現(xiàn)有點(diǎn)時(shí),才會(huì)替換該點(diǎn),。這有助于僅保留前景點(diǎn),,并提高投影質(zhì)量(參見(jiàn)圖7)。

圖6.填充未映射的像素,。

圖7.重疊噪點(diǎn)修復(fù),。

結(jié)論

該算法能夠以小于5°的重疊度拼接來(lái)自不同攝像頭的圖像,相比之下,,傳統(tǒng)關(guān)鍵點(diǎn)匹配算法至少需要20°的重疊度,。該方法所需的計(jì)算量極少,因此非常適用于邊緣系統(tǒng),。由于沒(méi)有圖像失真,,深度數(shù)據(jù)在拼接后仍具有完整性。該解決方案進(jìn)一步支持了ADTF3175傳感器的模塊化實(shí)現(xiàn),,以極小的損失獲得所需FOV,。

FOV的擴(kuò)展不限于水平維度,相同技術(shù)也可用于在垂直方向上擴(kuò)展視場(chǎng),,從而獲得真正的球形視覺(jué),。該解決方案可以在連接了4個(gè)傳感器的Arm? V8 6核邊緣CPU上以10 fps的速度運(yùn)行,,提供275°的FOV。當(dāng)僅使用兩個(gè)傳感器時(shí),,幀速率可達(dá)30 fps,。

該方法的主要優(yōu)勢(shì)之一是實(shí)現(xiàn)了巨大的計(jì)算效率增益,基本計(jì)算效率的增益超過(guò)3倍(參見(jiàn)表1),。

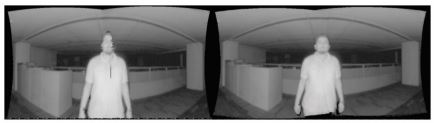

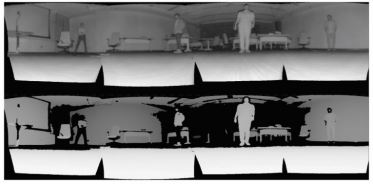

圖8和圖9展示了使用該解決方案獲得的一些結(jié)果,。

圖8.拼接的紅外數(shù)據(jù)提供210°的FOV。

參考文獻(xiàn)

“ADI公司的3DToF ADTF31xx”,。GitHub, Inc.

“ADI公司3DToF地面探測(cè)器”,。GitHub, Inc.

“ ADI公司3DToF圖像拼接”。GitHub, Inc.

“ ADI公司3DToF安全氣泡探測(cè)器”,。GitHub, Inc.

“ ADI公司3D ToF軟件套件”,。GitHub, Inc.

He、Yingshen,、Ge Li,、Yiting Shao、Jing Wang,、Yueru Chen和Shan Liu.“通過(guò)球面投影的點(diǎn)云壓縮框架”,。2020年IEEE視覺(jué)通信和圖像處理國(guó)際會(huì)議,2020年,。

工業(yè)視覺(jué)技術(shù),。ADI公司

Topiwala、Anirudh,?!包c(diǎn)云的球面投影”。Towards Data Science,,2020年3月,。

圖9.具有278° FoV的拼接紅外和深度圖像。

更多精彩內(nèi)容歡迎點(diǎn)擊==>>電子技術(shù)應(yīng)用-AET<<