劉圭圭,樊炳輝,王傳江,張凱麗

(山東科技大學(xué) 機(jī)器人研究中心,山東 青島 266590)

摘要:為幫助上肢活動(dòng)不便的老人、殘疾人完成自主進(jìn)食等行為,開發(fā)了一套基于雙目視覺的助老助殘機(jī)器人定位系統(tǒng)。通過(guò)藍(lán)色激光引導(dǎo)實(shí)現(xiàn)對(duì)雙目相機(jī)視野范圍內(nèi)任意物體的定位。采用多自由度助老助殘機(jī)器人和Bumblebee2立體視覺系統(tǒng)構(gòu)建定位實(shí)驗(yàn)系統(tǒng),定位誤差在1.2 cm范圍內(nèi),滿足對(duì)助老助殘機(jī)器人定位精度的要求。

關(guān)鍵詞:雙目視覺;助老助殘;機(jī)器人;定位

0引言

助老助殘機(jī)器人即為幫助那些身體功能缺失或嚴(yán)重喪失的老人、殘疾人實(shí)現(xiàn)獨(dú)立生活的一類機(jī)器人。雙目視覺即為通過(guò)位于不同視角的兩個(gè)相機(jī)模擬人類視覺原理,實(shí)現(xiàn)對(duì)空間中三維物體的定位。雙目視覺已廣泛應(yīng)用于機(jī)器人導(dǎo)航、場(chǎng)景重建、虛擬現(xiàn)實(shí)等領(lǐng)域[13]。

本文簡(jiǎn)單介紹了雙目視覺原理,利用多自由度助老助殘機(jī)器人和Bumblebee2立體視覺系統(tǒng)構(gòu)建的定位系統(tǒng),進(jìn)行了空間三維定位實(shí)驗(yàn)。

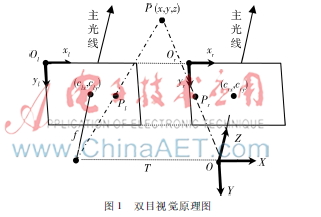

1雙目視覺原理

本文采用平行光軸雙目視覺,其原理如圖1所示。左右兩臺(tái)完全相同的相機(jī)精確位于同一平面上,主光線嚴(yán)格平行,相對(duì)位置固定,主點(diǎn)(clx,cly)和(crx,cry)在左右兩幅圖像上具有相同的像素坐標(biāo)。T(基線長(zhǎng)度)為兩臺(tái)相機(jī)中心之間的距離。左右相機(jī)成像平面坐標(biāo)系分別為OlXlYl和OrXrYr,雙目相機(jī)坐標(biāo)系為OXYZ。坐標(biāo)系OXYZ中任一點(diǎn)P(x,y,z)在兩成像平面坐標(biāo)系中分別對(duì)應(yīng)為點(diǎn)Pl(xl,yl)和點(diǎn)Pr(xr,yr)。點(diǎn)P在兩幅圖像中的y坐標(biāo)值是一樣的,即yl=yr=ylr。根據(jù)三角幾何原理和小孔成像原理可得式(1):

假設(shè)d=xl-xr,d稱之為視差(即為同一個(gè)空間點(diǎn)在兩幅圖像中位置的偏差),代入式(1)即可計(jì)算出點(diǎn)P在相機(jī)坐標(biāo)系下的三維坐標(biāo),如式(2):

2實(shí)驗(yàn)平臺(tái)

實(shí)驗(yàn)平臺(tái)主要包括多自由度助老助殘機(jī)器人和Bumblebee2雙目視覺系統(tǒng)兩個(gè)部分。整個(gè)實(shí)驗(yàn)平臺(tái)的硬件結(jié)構(gòu)如圖2所示。

2.1助老助殘機(jī)器人系統(tǒng)

多自由度助老助殘機(jī)器人如圖3所示。結(jié)構(gòu)圖中1、2、3為伺服電機(jī),PC通過(guò)USB轉(zhuǎn)CAN總線的方式對(duì)其發(fā)送控制命令;4、5為數(shù)字舵機(jī),通過(guò)USB轉(zhuǎn)RS485的方式對(duì)其施行控制;6為直流電機(jī),通過(guò)USB轉(zhuǎn)RS232與CortexM3底層控制器進(jìn)行通信,之后由底層控制器對(duì)其進(jìn)行控制操作。機(jī)械臂的DH[4]參數(shù)模型如表1所示。

2.2雙目視覺系統(tǒng)

Bumblebee203s2c是Point Grey Research公司的一款立體視覺產(chǎn)品。采用兩個(gè)Sony CCD芯片,分辨率為640×480,具有高速1394A接口,全視場(chǎng)深度測(cè)量,實(shí)時(shí)3D數(shù)據(jù)轉(zhuǎn)換(3D點(diǎn)100萬(wàn)像素/s),相機(jī)位置偏差和鏡頭畸變可以自動(dòng)校正,配套有靈活的軟件開發(fā)工具。

Bumblebee2左右兩相機(jī)之間的基線長(zhǎng)度為12 cm,每個(gè)相機(jī)的視場(chǎng)角為66°。根據(jù)上述兩個(gè)參數(shù),可得雙目相機(jī)視場(chǎng)范圍。圖4為實(shí)測(cè)坐標(biāo)系OXYZ的位姿。

2.3二者之間的位置關(guān)系

圖5為雙目相機(jī)坐標(biāo)系odxdydzd與世界坐標(biāo)系oxyz之間的位置關(guān)系,圖中相機(jī)可繞xd軸旋轉(zhuǎn)(θ)。由圖中幾何關(guān)系及坐標(biāo)變換公式[5]可知,在相機(jī)坐標(biāo)系下的坐標(biāo)P=[pxpypz1]T,轉(zhuǎn)換到世界坐標(biāo)系下的坐標(biāo)為[153-py×sin(θ)-pz×cos(θ),px+568,pz×sin(θ)-py×cos(θ)-286,1]T。

3助老助殘機(jī)器人定位實(shí)驗(yàn)

3.1雙目視覺定位精度實(shí)驗(yàn)

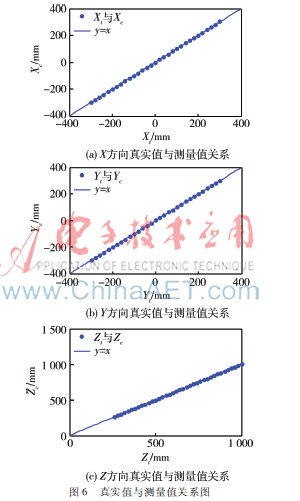

將Bumblebee2相機(jī)固定,在其正前方沿垂直于相機(jī)平面的直線移動(dòng)目標(biāo)物來(lái)測(cè)量Z的值,測(cè)量范圍為260 mm~1 000 mm,相鄰兩次測(cè)量位置間隔為20 mm。同樣的,在Z=750 mm,垂直于Z軸的平面上對(duì)X、Y值分別進(jìn)行測(cè)量。為防止偶然誤差的出現(xiàn),采用同一位置測(cè)量10次取平均值的方式來(lái)確定測(cè)量結(jié)果。真實(shí)值與測(cè)量值(部分)如表2所示,各分量誤差關(guān)系曲線如圖6所示。由表2可知,雙目視覺定位誤差在5 mm范圍內(nèi)。

3.2助老助殘機(jī)器人末端定位精度實(shí)驗(yàn)

室內(nèi)環(huán)境下,通過(guò)鼠標(biāo)選擇目標(biāo)物的方式進(jìn)行了3組實(shí)驗(yàn),目標(biāo)位置在相機(jī)坐標(biāo)系、世界坐標(biāo)系中的坐標(biāo)以及通過(guò)運(yùn)動(dòng)學(xué)逆向求解[67]獲得的各關(guān)節(jié)實(shí)際坐標(biāo),如表3所示。表3中誤差計(jì)算公式為:

由表3可知,助老助殘機(jī)器人末端定位誤差在1.2 cm范圍內(nèi),滿足實(shí)驗(yàn)要求。

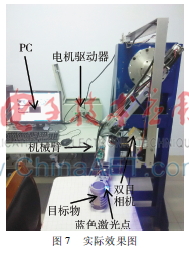

3.3實(shí)驗(yàn)效果

實(shí)驗(yàn)過(guò)程中通過(guò)藍(lán)色激光筆的引導(dǎo)來(lái)選擇定位目標(biāo),通過(guò)閾值分割等方法[89]進(jìn)行數(shù)字圖像處理,主動(dòng)確定激光點(diǎn)所指目標(biāo)點(diǎn)位置。實(shí)驗(yàn)效果如圖7所示。圖中目標(biāo)位置在相機(jī)坐標(biāo)系下的坐標(biāo)(單位:mm)為(-37.21,-17.03,264.33),在世界坐標(biāo)系下的坐標(biāo)為(270.41,530.79,-523.43),而手臂末端在世界坐標(biāo)系下的實(shí)際坐標(biāo)為(262,532,-520),誤差為9.16 mm,滿足實(shí)驗(yàn)精度要求。除此之外,可以通過(guò)人嘴部識(shí)別[10]

對(duì)嘴部進(jìn)行定位,還可以通過(guò)模板匹配方式來(lái)定位某一特定物體。

4結(jié)論

本文應(yīng)用雙目視覺對(duì)助老助殘機(jī)器人的操作目標(biāo)位置進(jìn)行定位,并對(duì)定位精度進(jìn)行了實(shí)驗(yàn),精度限定在5 mm范圍內(nèi)。配合機(jī)械臂的運(yùn)動(dòng),末端定位精度在1.2 cm范圍內(nèi),滿足實(shí)驗(yàn)要求。但系統(tǒng)仍有需要改進(jìn)的地方,比如控制器攜帶不方便,激光斑指引方法易受環(huán)境光照的影響等。

參考文獻(xiàn)

[1] 丁良宏,王潤(rùn)孝,馮華山,等.立體視覺測(cè)程研究進(jìn)展[J].機(jī)器人,2011,33(1):119128.

[2] 李丹程,劉景明,姜琳穎,等.基于柵格模型的雙目移動(dòng)機(jī)器人三維場(chǎng)景重建[J].小型微型計(jì)算機(jī)系統(tǒng),2012,33(4):873877.

[3] 徐宇杰,管會(huì)超,張宗衛(wèi),等.基于人眼視覺原理的虛擬現(xiàn)實(shí)顯示模型[J].計(jì)算機(jī)應(yīng)用,2015,35(10):29392944.

[4] DENAVIT J, HARTENBERG R S. A kinematic notation for lowerpair mechanisms based on matrices[J].Journal of Applied Mechanics ASME Transactons, 1965,22(2): 215221.

[5] 蔡自興.機(jī)器人學(xué)(第三版)[M].北京:清華大學(xué)出版社,2015.

[6] 馬漢波,顏鋼鋒.基于DSP和FPGA的多軸運(yùn)動(dòng)控制系統(tǒng)設(shè)計(jì)[J].電子技術(shù)應(yīng)用,2013,39(3):3436.

[7] 蔡自興.機(jī)器人學(xué)基礎(chǔ)[M].北京:機(jī)械工業(yè)出版社,2009.

[8] KRSTINIC D, SKELIN A K, MILATIC I, et al. Laser spot tracking based on modified circular hough transform and motion pattern analysis[J]. Sensors, 2014, 14(11):2011220133.

[9] 曹世康,李東堅(jiān),許瑞華,等.基于最優(yōu)弧的激光光斑中心檢測(cè)算法[J].紅外與激光工程,2014,43(10):34923496.

[10] 勒薇,張建奇,張翔.基于局部梯度算子的嘴部檢測(cè)與定位[J].光電工程,2009,36(10):135140.