摘 要: 針對(duì)未知非結(jié)構(gòu)化室內(nèi)環(huán)境中雙目視覺機(jī)器人路標(biāo)特征匹配的問題進(jìn)行了研究,提出了基于改進(jìn)自組織映射網(wǎng)絡(luò)(Self-Organizing Map,SOM)的雙目視覺特征點(diǎn)快速匹配方法。對(duì)雙目視覺獲取的環(huán)境圖像提取SIFT特征向量作為改進(jìn)SOM的輸入,利用獲勝者計(jì)算技術(shù)完成對(duì)輸入SIFT特征點(diǎn)的快速匹配,SOM競(jìng)爭學(xué)習(xí)過程中用街區(qū)距離與棋盤距離的線性組合作為相似性度量函數(shù)。實(shí)驗(yàn)結(jié)果表明,所提方法在路標(biāo)特征匹配的時(shí)間和效果上優(yōu)于傳統(tǒng)SIFT和SURF特征匹配的方法,且能滿足實(shí)時(shí)性要求。

關(guān)鍵詞: 無監(jiān)督競(jìng)爭學(xué)習(xí);特征匹配;雙目視覺;自組織映射網(wǎng)絡(luò)

0 引言

在未知室內(nèi)環(huán)境中,移動(dòng)機(jī)器人對(duì)自身與環(huán)境的精確定位是實(shí)現(xiàn)自主導(dǎo)航的前提和基礎(chǔ)[1],而雙目視覺可以獲取更完整的環(huán)境信息、探測(cè)范圍更廣,匹配雙目圖像顯著的特征點(diǎn)作為路標(biāo)[2],構(gòu)建機(jī)器人的環(huán)境地圖是移動(dòng)機(jī)器人實(shí)現(xiàn)自主導(dǎo)航的基礎(chǔ)。

大多研究人員提出的算法主要是研究如何確定興趣點(diǎn)和其相鄰區(qū)域以及如何提取特征點(diǎn)的描述符向量。近些年不斷有新的匹配算法被提出,參考文獻(xiàn)[3]中提出對(duì)旋轉(zhuǎn)、尺度縮放、亮度變化保持不變性的局部特征描述方法(Scale Invariant Feature Transform,SIFT)。該算法復(fù)雜度高,提取大量的局部特征點(diǎn)集,導(dǎo)致圖像處理過程很慢,不能滿足實(shí)時(shí)要求。參考文獻(xiàn)[4]提出Harris-SIFT算法,用Harris角點(diǎn)代替SIFT算法的多尺度空間極值檢測(cè),生成SIFT特征描述子用在雙目圖像對(duì)的匹配上。但該算法失去了SIFT算法對(duì)于尺度縮放保持不變的特性。參考文獻(xiàn)[5]改進(jìn)了參考文獻(xiàn)[4]的Harris-SIFT算法,保持了SIFT特性。采用Best Bin First(BBF)來減少匹配搜索的復(fù)雜度,提高了匹配速度。

本文提出一種SIFT特征向量提取與SOM競(jìng)爭學(xué)習(xí)技術(shù)相結(jié)合的特征點(diǎn)快速匹配方法,大大減少了檢測(cè)時(shí)間。實(shí)驗(yàn)表明,所提算法對(duì)特征點(diǎn)匹配的速度與效果優(yōu)于傳統(tǒng)SIFT和SURF匹配算法[6-7],滿足移動(dòng)機(jī)器人的實(shí)時(shí)性要求。

1 特征點(diǎn)提取

雙目立體視覺系統(tǒng)由參數(shù)相同的兩個(gè)攝像頭組成,令兩個(gè)攝像頭的光軸互相平行且與透視投影平面垂直,要求同步曝光及圖像質(zhì)量一致。獲取的左、右目圖像分別記為IL、IR。分別對(duì)IL、IR提取SIFT特征點(diǎn),每一個(gè)特征點(diǎn)對(duì)應(yīng)一個(gè)描述符特征向量。描述符向量使用4×4的16個(gè)種子點(diǎn)來描述,通過高斯加權(quán)后歸入8個(gè)方向直方圖,獲得一個(gè)4×4×8的128維SIFT特征描述子。由IL、IR提取的特征點(diǎn)組成的集合分別記為FL、FR,隨后作為自組織映射網(wǎng)絡(luò)(SOM)的輸入進(jìn)行特征點(diǎn)的快速匹配。

2 自組織映射網(wǎng)絡(luò)(SOM)分析

基于Kohonen神經(jīng)網(wǎng)絡(luò)的SOM方法是一種無監(jiān)督競(jìng)爭學(xué)習(xí)的神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)算法[8-9]。

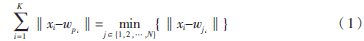

設(shè)輸入變量集合X={x1,x2,…,xk}∈Rn,權(quán)重系數(shù)W={wi1,wi2,…,win}∈Rn。隨機(jī)選取W的初始值,將輸入特征模式向量X輸入到SOM輸入層處理單元中,當(dāng)網(wǎng)絡(luò)得到一個(gè)新的輸入模式向量時(shí),競(jìng)爭層的所有神經(jīng)元對(duì)應(yīng)的關(guān)聯(lián)權(quán)向量均與其進(jìn)行相似性比較,并將最相似的權(quán)向量判為競(jìng)爭獲勝神經(jīng)元,由式(1)可以得到獲勝單元。

在訓(xùn)練過程中,以獲勝神經(jīng)元為中心設(shè)定一個(gè)鄰域半徑,稱為優(yōu)勝鄰域。優(yōu)勝鄰域內(nèi)的節(jié)點(diǎn)也會(huì)彼此激發(fā)學(xué)習(xí)一個(gè)相同的輸入向量X,優(yōu)勝鄰域Nj*(t)內(nèi)的所有神經(jīng)元節(jié)點(diǎn)由式(2)進(jìn)行權(quán)值調(diào)整。

其中,(t)為學(xué)習(xí)率因子(0<(t)<1),優(yōu)勝鄰域開始定得很大,但隨著訓(xùn)練次數(shù)的增加,優(yōu)勝鄰域會(huì)不斷收縮,最終收縮到半徑為零。

3 改進(jìn)SOM的特征點(diǎn)匹配

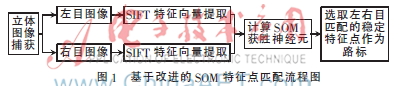

傳統(tǒng)SIFT和SURF的特征匹配算法復(fù)雜度高,圖像匹配效率低,不能滿足實(shí)時(shí)性要求。本文運(yùn)用改進(jìn)的SOM網(wǎng)絡(luò)完成雙目圖像特征點(diǎn)的快速匹配,加快特征點(diǎn)的匹配速度。基于改進(jìn)SOM的特征點(diǎn)匹配流程圖如圖1所示。

修改后的算法把特征點(diǎn)匹配問題轉(zhuǎn)換成一個(gè)圖像的每個(gè)特征點(diǎn)與對(duì)應(yīng)的另一圖像特征點(diǎn)間立體映射的估計(jì),所提算法選取街區(qū)距離LJ與棋盤距離LQ的線性組合代替歐氏距離Lo,可知計(jì)算LJ和LQ比Lo簡單很多,而且LQ≤Lo≤LJ,所以本文用LQ+LJ替代Lo,作為相似性度量函數(shù),減少了計(jì)算量,從而提高計(jì)算速度。

修改后的SOM特征點(diǎn)匹配步驟如下:

![`Y(YR0WZG0F~0WH]6QBGVM9.jpg `Y(YR0WZG0F~0WH]6QBGVM9.jpg](http://files.chinaaet.com/images/2016/01/04/6358750299179000003730744.jpg)

完成以上步驟后就完成了雙目圖像之間的特征點(diǎn)匹配。為了進(jìn)一步提高匹配的準(zhǔn)確率,使用極線幾何約束、視差約束、有序性約束以及唯一性約束條件消除錯(cuò)誤的匹配點(diǎn)。

4 實(shí)驗(yàn)與結(jié)果分析

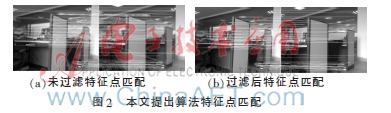

本文使用旅行家2號(hào)機(jī)器人作為實(shí)驗(yàn)平臺(tái),兩個(gè)攝像頭之間的基線長20 cm。對(duì)獲取到的圖像分別使用SIFT和SURF特征匹配方法以及所提算法進(jìn)行特征點(diǎn)匹配。圖2(a)為所提算法未使用約束條件進(jìn)行特征點(diǎn)匹配的實(shí)驗(yàn)結(jié)果,圖2(b)為約束條件過濾后的匹配結(jié)果。

從圖2可以發(fā)現(xiàn),未使用約束條件過濾前有明顯的誤配點(diǎn),使用極線幾何約束、視差約束等約束條件可以剔除大量的錯(cuò)誤匹配點(diǎn),提高匹配的準(zhǔn)確度。圖3為實(shí)驗(yàn)仿真對(duì)比結(jié)果,可以看出所提算法在匹配數(shù)量與時(shí)間上優(yōu)于傳統(tǒng)算法。獲取大量圖像對(duì)所提算法進(jìn)行實(shí)驗(yàn)評(píng)估,統(tǒng)計(jì)運(yùn)行耗時(shí)和特征點(diǎn)匹配數(shù)量如圖4、圖5所示。

本文用SIFT算法提取雙目圖像的特征點(diǎn)集作為SOM的輸入,減少了檢測(cè)時(shí)間。使用棋盤距離和街區(qū)距離的線性組合代替歐式距離作為相似度量函數(shù),大大降低了計(jì)算量,減少了計(jì)算時(shí)間。使用獲勝者計(jì)算技術(shù)保證了特征點(diǎn)的數(shù)量。

實(shí)驗(yàn)結(jié)果表明,所提算法在實(shí)驗(yàn)室環(huán)境下對(duì)雙目圖像特征點(diǎn)的匹配速度更快,且匹配的特征點(diǎn)數(shù)量穩(wěn)定,可以滿足機(jī)器人導(dǎo)航實(shí)時(shí)性的要求。

5 結(jié)論

SIFT算法具有尺度、旋轉(zhuǎn)、視角和光照不變性,但由于復(fù)雜性高、效率低等達(dá)不到實(shí)時(shí)性的理想效果。本文使用SIFT特征點(diǎn)向量與改進(jìn)的SOM相結(jié)合的無監(jiān)督競(jìng)爭學(xué)習(xí)算法,對(duì)雙目圖像特征點(diǎn)完成快速匹配。實(shí)驗(yàn)結(jié)果表明,所提算法在實(shí)驗(yàn)室環(huán)境下對(duì)雙目圖像特征點(diǎn)的匹配有較好的實(shí)驗(yàn)效果,可以快速、準(zhǔn)確地匹配穩(wěn)定的特征點(diǎn)。在未來的工作中,將在本文所提算法的基礎(chǔ)上,進(jìn)行雙目視覺機(jī)器人實(shí)時(shí)定位與地圖構(gòu)建(Simultaneous Localization and Mapping,SLAM)[10]的研究。

參考文獻(xiàn)

[1] 林睿.基于圖像特征點(diǎn)的移動(dòng)機(jī)器人立體視覺SLAM研究[D].哈爾濱:哈爾濱工業(yè)大學(xué),2011.

[2] 王璐,蔡自興.未知環(huán)境中基于視覺顯著性的自然路標(biāo)檢測(cè)[J].模式識(shí)別與人工智能,2006,19(1):100-105.

[3] LOWE D G. Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision, 2004, 60(2):91-110.

[4] 趙欽君,趙東標(biāo),韋虎.Harris-SIFT算法及其在雙目立體視覺中的應(yīng)用[J].電子科技大學(xué)學(xué)報(bào),2010,39(4):546-550.

[5] 王民,劉偉光.基于改進(jìn)SIFT特征的雙目圖像匹配算法[J].計(jì)算機(jī)工程與應(yīng)用,2013,49(2):203-206.

[6] 常青,張斌,邵金玲.基于SIFT和RANSAC的特征圖像匹配方法[J].華東理工大學(xué)學(xué)報(bào)(自然科學(xué)版),2012,38(6):747-751.

[7] 陳小丹,杜宇人,高秀斌.一種基于SURF的圖像特征點(diǎn)快速匹配算法[J].揚(yáng)州大學(xué)學(xué)報(bào)(自然科學(xué)版),2012,15(4):64-67.

[8] KOHONEN T. Self-organizing maps[J]. Springer, 1995,11(3):340-349.

[9] 楊占華,楊燕.SOM神經(jīng)網(wǎng)絡(luò)算法的研究與進(jìn)展[J].計(jì)算機(jī)工程,2006,32(16):201-203.

[10] 蘇立.室內(nèi)環(huán)境下移動(dòng)機(jī)器人雙目視SLAM研究[D].西安:西安理工大學(xué),2010.