2月19日至23日,第70屆ISSCC(國際固態(tài)電路會議)在美國舊金山召開,清華大學(xué)集成電路學(xué)院作為第一署名單位在ISSCC 2023發(fā)表了8篇學(xué)術(shù)論文,所涉及研究內(nèi)容包括存內(nèi)計(jì)算視覺芯片、量子計(jì)算芯片、多模態(tài)Transform芯片、異步類腦芯片、可重構(gòu)存內(nèi)張量計(jì)算芯片、超寬帶收發(fā)機(jī)、分頻器、振蕩器等。

本刊編輯委員會專家尹首一教授作為通訊作者的3篇文章獲得發(fā)表,下面我們對相關(guān)論文進(jìn)行介紹。

ISSCC (International Solid-State Circuits Conference)國際固態(tài)電路會議始于1953年,是全球?qū)W術(shù)界和工業(yè)界公認(rèn)的集成電路設(shè)計(jì)領(lǐng)域最高級別會議,被認(rèn)為是“集成電路設(shè)計(jì)領(lǐng)域的奧林匹克大會”。ISSCC通常是各個時期國際上最尖端固態(tài)電路技術(shù)最先發(fā)表之地。每年吸引超過3000名來自世界各地工業(yè)界和學(xué)術(shù)界的參會者。

存內(nèi)計(jì)算視覺芯片CV-CIM

代價匹配算法需要精確計(jì)算圖像間的相似度,已經(jīng)被廣泛應(yīng)用于自動駕駛,機(jī)器人,AR/VR等領(lǐng)域,但由于其頻繁的數(shù)據(jù)訪存,導(dǎo)致其難以應(yīng)用于低功耗場景中。集成電路學(xué)院魏少軍、尹首一教授團(tuán)隊(duì)提出了采用存算一體范式的CV-CIM,將計(jì)算單元與SRAM存儲單元完成合并,減少數(shù)據(jù)搬移。利用異或邏輯的自反性,結(jié)合律等,可重構(gòu)為乘法,加法,減法,比較等多種基本算子。進(jìn)一步經(jīng)過數(shù)模混合存算單元的配合,實(shí)現(xiàn)包括L0/L1/L2在內(nèi)的多種距離計(jì)算算法;并利用圖像相似度,動態(tài)擴(kuò)充計(jì)算數(shù)據(jù)稀疏度,擴(kuò)展計(jì)算噪聲容限,提升計(jì)算精度;通過增加行方向細(xì)粒度地址控制,列方向讀寫并行模式,大幅提升存算系統(tǒng)的利用率。考慮到模擬單元受PVT影響,增加Canary BIST單元保證計(jì)算系統(tǒng)魯棒性。CV-CIM作為國際首款針對圖像匹配的存算一體芯片,在28nm工藝上成功實(shí)現(xiàn)流片,峰值能效為1158TOPs/W,面積為0.387mm^2。

該工作以 “CV-CIM: A 28nm XOR-derived Similarity-aware Computation-In-Memory For Cost Volume Construction”為題發(fā)表在ISSCC2023。集成電路學(xué)院博士研究生岳志恒為論文第一作者,尹首一教授為通訊作者。

多模態(tài)Transform芯片

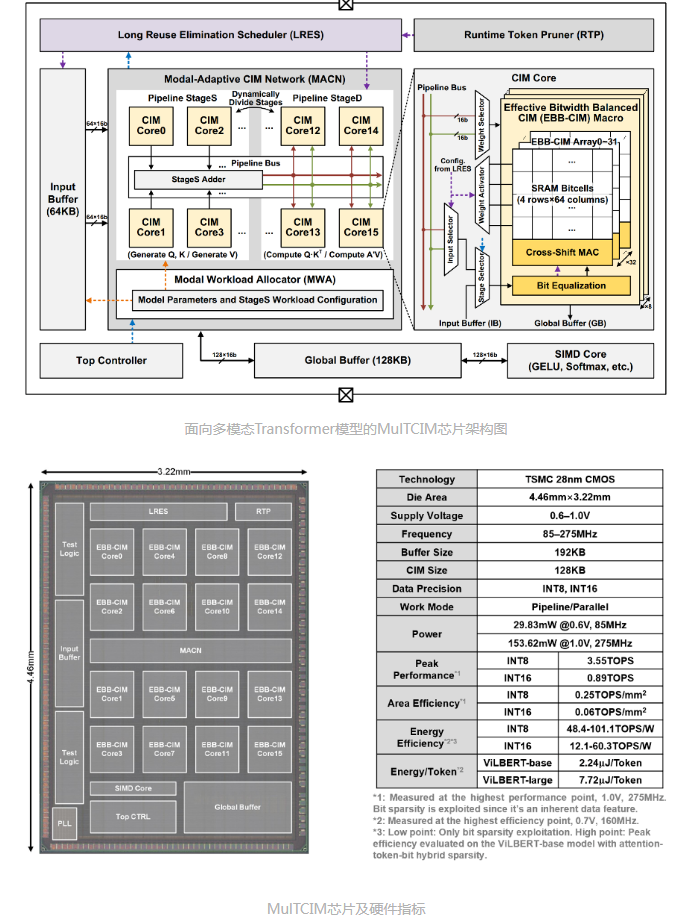

多模態(tài)Transformer是當(dāng)下最流行的處理多種模態(tài)信號(視覺、文字、語音等)的AI模型之一,已廣泛應(yīng)用于視頻問答、多語言圖像檢索等任務(wù)中。這類模型巨大的計(jì)算量、頻繁的數(shù)據(jù)訪問、獨(dú)特的跨模態(tài)注意力機(jī)制對AI芯片設(shè)計(jì)造成諸多挑戰(zhàn)。集成電路學(xué)院魏少軍、尹首一教授團(tuán)隊(duì)提出國際首款基于可重構(gòu)數(shù)字存算一體架構(gòu)的多模態(tài)Transformer AI芯片MulTCIM。研究團(tuán)隊(duì)充分利用跨模態(tài)注意力機(jī)制中的計(jì)算冗余性,設(shè)計(jì)出綜合利用attention-token-bit三個層次混合稀疏性的存算一體架構(gòu):1)使用注意力局部性調(diào)度器優(yōu)化attention稀疏,提高存算單元利用率;2)采用模態(tài)自適應(yīng)存算一體網(wǎng)絡(luò)優(yōu)化token稀疏,減少跨模態(tài)切換時的等待時間;3)利用位寬均衡存算一體單元優(yōu)化bit稀疏,降低存算一體單元的計(jì)算延遲。MulTCIM芯片使用TSMC 28nm工藝成功流片,在典型多模態(tài)Transformer模型ViLBERT上僅產(chǎn)生2.24μJ/Token的能耗,相比于ISSCC2022上發(fā)表的Transformer芯片可獲得5.91倍的能效提升。

該工作以“MulTCIM: A 28nm 2.24μJ/Token Attention-Token-Bit Hybrid Sparse Digital CIM-based Accelerator for Multimodal Transformers”為題發(fā)表在ISSCC2023。集成電路學(xué)院畢業(yè)生涂鋒斌博士為論文第一作者,尹首一教授為論文通訊作者。

可重構(gòu)存內(nèi)張量計(jì)算芯片TensorCIM

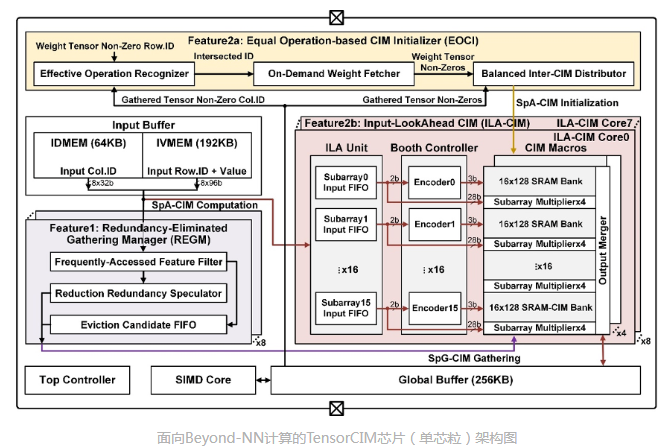

Beyond-NN計(jì)算是面向通用智能場景的新型計(jì)算類型。不同于傳統(tǒng)的處理圖像、語音等規(guī)則數(shù)據(jù)結(jié)構(gòu)的神經(jīng)網(wǎng)絡(luò),Beyond-NN計(jì)算需要處理真實(shí)世界中的非規(guī)則數(shù)據(jù)結(jié)構(gòu),例如社交網(wǎng)絡(luò)、知識圖譜、推薦系統(tǒng)等。針對Beyond-NN在算力、訪存、功能三方面的技術(shù)挑戰(zhàn),集成電路學(xué)院魏少軍、尹首一教授團(tuán)隊(duì)提出國際首款基于可重構(gòu)數(shù)字存算一體架構(gòu)的多芯粒張量處理器TensorCIM:1)TensorCIM采用多芯粒系統(tǒng)對算力和存儲容量進(jìn)行擴(kuò)展,在降低制造成本的同時,為不同規(guī)模的Beyond-NN場景提供可擴(kuò)展的系統(tǒng)解決方案。2)TensorCIM通過數(shù)字存算一體架構(gòu)大幅減少數(shù)據(jù)搬運(yùn),并支持高精度的浮點(diǎn)計(jì)算以保證準(zhǔn)確度。3)TensorCIM將可重構(gòu)技術(shù)與數(shù)字存算一體相結(jié)合,實(shí)現(xiàn)稀疏張量聚集和稀疏神經(jīng)網(wǎng)絡(luò)計(jì)算兩種模式的動態(tài)切換,保持極高的計(jì)算資源利用率。TensorCIM芯片使用TSMC 28nm工藝成功流片,在圖神經(jīng)網(wǎng)絡(luò)、推薦系統(tǒng)等典型Beyond-NN應(yīng)用上驗(yàn)證,取得3.7nJ/Gather的稀疏張量聚集效率和8.3TFLOPS/W的稀疏FP32張量代數(shù)能效,相比同期浮點(diǎn)存算一體AI芯片能效提升5.6倍。

該工作以“TensorCIM: A 28nm 3.7nJ/Gather and 8.3TFLOPS/W FP32 Digital-CIM Tensor Processor for MCM-CIM-Based Beyond-NN Acceleration”為題發(fā)表在ISSCC2023。集成電路學(xué)院畢業(yè)生涂鋒斌博士為論文第一作者,尹首一教授為論文通訊作者。