楊海麗,黃洪瓊

(上海海事大學(xué) 信息工程學(xué)院,上海 201306)

摘要:由于視頻場景變化較快、配準(zhǔn)誤差、噪聲、低分辨率圖像數(shù)量不足等原因,會使傳統(tǒng)基于壓縮感知的采用視頻幀固定分組形式的視頻編解碼器的重構(gòu)效果較差,同時也使超分辨率重建出現(xiàn)病態(tài)問題。為解決這些問題,文章提出一種基于壓縮感知的自適應(yīng)幀圖像分組的視頻編解碼器,同時又在超分辨率重建算法中提出了L曲線的自適應(yīng)時空正則化系數(shù)計算方法,可以自適應(yīng)地計算正規(guī)化系數(shù)。由實(shí)驗(yàn)結(jié)果表明,該算法能夠很好地解決上述問題從而重構(gòu)出視覺效果良好的視頻幀圖像。

關(guān)鍵詞:壓縮感知;視頻幀圖像自適應(yīng)分組;超分辨率重建;自適應(yīng)時空正則化;L曲線

中圖分類號:TP391.9文獻(xiàn)標(biāo)識碼:ADOI: 10.19358/j.issn.1674-7720.2017.09.015

引用格式:楊海麗,黃洪瓊.視頻幀間分組及超分辨率重建的自適應(yīng)性研究[J].微型機(jī)與應(yīng)用,2017,36(9):49-52.

0引言

*基金項(xiàng)目: 國家自然科學(xué)基金(61673260)

隨著人類精神生活需求的不斷提高,一些高品質(zhì)的數(shù)字圖像、視頻成為生活中不可或缺的部分,若是在處理這些含有海量信息數(shù)據(jù)的數(shù)字視頻圖像時,仍遵循奈奎斯特抽樣定律就會出現(xiàn)采樣數(shù)量過大的弊端,同時也會給信息存儲和傳輸帶來很大麻煩。壓縮感知理論的提出成為解決這一難題的指路明燈。Candes率先在數(shù)學(xué)領(lǐng)域推理出可以從部分傅里葉變換系數(shù)精確重構(gòu)原始信號的結(jié)論[1],這一結(jié)論的成功論證給信號的重構(gòu)提供了嶄新的思路。而后經(jīng)不斷深入研究,壓縮感知的概念及理論被正式提出,其理論精髓在于將壓縮理論與采樣理論巧妙結(jié)合。在采樣過程中不再是單純對原始信號進(jìn)行直接采樣,而是對其非自適應(yīng)線性投影測量值進(jìn)行采集,然后再由相應(yīng)的重構(gòu)算法憑借測量值重構(gòu)出原始信號[2]。壓縮感知理論中所采集的信號的投影測量數(shù)據(jù)量相比傳統(tǒng)采樣要少很多,正好彌補(bǔ)了奈奎斯特抽樣定律在數(shù)字視頻圖像處理中出現(xiàn)采樣數(shù)量過大的缺點(diǎn),使得高分辨率信號的采集成為可能,這一突出的優(yōu)勢奠定了壓縮感知理論在視頻處理技術(shù)領(lǐng)域中的重要地位[3]。

視頻技術(shù)迅猛發(fā)展和一些新的視頻應(yīng)用使得傳統(tǒng)基于壓縮感知的視頻編解碼方式及重構(gòu)方式不再完全適用,一些傳統(tǒng)算法的改進(jìn)也面臨著巨大挑戰(zhàn)。比如在安全監(jiān)控系統(tǒng)中,當(dāng)有意外狀況發(fā)生,需要對監(jiān)控錄像進(jìn)行超分辨率重建,從而為事件的處理提供重要線索;把一般的NTSC格式低清電視信號

轉(zhuǎn)換為高清電視信號(簡稱HDTV),從而可獲得更好的圖像質(zhì)量。基于此,本文對視頻幀間圖像分組及超分辨率重建兩者的自適應(yīng)性方面展開研究,以提高重構(gòu)視頻幀圖像的質(zhì)量。

1視頻幀間分組及超分辨率重建的自適應(yīng)性研究

1.1自適應(yīng)幀圖像分組視頻編解碼器

文獻(xiàn)[4]首次提出了基于壓縮感知理論的視頻編解碼器,它是以整幅視頻幀圖像為最小基數(shù)來處理,并利用感知壓縮理論大大減少了重構(gòu)視頻時所需的圖像樣本數(shù),使運(yùn)算的復(fù)雜度得到優(yōu)化。文獻(xiàn)[56]提出了分布式視頻壓縮感知(Distributed Compressed Video Sensing) 理論,借助參考幀來降低測量率提高整個編解碼系統(tǒng)的性能,可廣泛應(yīng)用于無線傳感網(wǎng)或泛在網(wǎng)絡(luò)。這些基于壓縮感知的視頻編解碼器在對視頻幀圖像分組環(huán)節(jié)中,基本都是按順序劃分出每組,且每組的視頻幀數(shù)量都是相同的。此種處理方式應(yīng)用在沒有快速改變的視頻場景時,重構(gòu)效果是較好的[78],如若視頻在下一幀突然出現(xiàn)情景的迅速改變,仍舊采用這種處理方式,則效果甚為不佳。基于以上情況,本文提出了一種可以適應(yīng)視頻場景出現(xiàn)迅速改變的自適應(yīng)幀間分組的視頻編解碼器。

本文提出的能夠適應(yīng)視頻場景出現(xiàn)迅速改變的自適應(yīng)幀間分組的視頻編解碼器設(shè)計重點(diǎn)主要有兩處,首先是如何判斷視頻場景是否發(fā)生了迅速改變,然后是如何針對此類情況實(shí)現(xiàn)不同于傳統(tǒng)形式的分組。針對如何判斷視頻場景有無快速改變的問題,本文采取的辦法是在對視頻圖像處理時首先設(shè)置了閾值判決這一步驟。在本文中該閾值是用來判斷當(dāng)前幀與參考幀的差異性,故選擇峰值信噪比來作為各幀圖像差異性大小的鑒定參數(shù)。下面進(jìn)行不同于傳統(tǒng)分組方式的自適應(yīng)分組。首先將視頻第一幀默認(rèn)設(shè)為第一組的關(guān)鍵幀,然后從第二幀開始作為當(dāng)前幀并同上一幀進(jìn)行幀圖像差異性比較,即進(jìn)行閾值判決。若是當(dāng)前幀與參考幀之間的差異系數(shù)小于設(shè)定閾值,則將當(dāng)前幀同當(dāng)前關(guān)鍵幀劃為一組,并將當(dāng)前幀定義為該組的非關(guān)鍵幀;如果當(dāng)前幀與參考幀之間的差異系數(shù)大于或等于閾值,則要重新定義一個組并定義該幀為新分組的關(guān)鍵幀。這樣就可以使得視頻幀圖像實(shí)現(xiàn)自適應(yīng)分組,每組幀數(shù)再不是固定不變的了,而是能夠隨視頻場景自身狀況而自動規(guī)劃每組幀數(shù)。

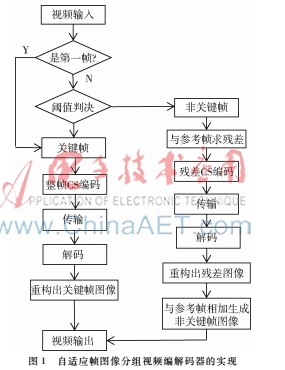

能夠適應(yīng)視頻場景出現(xiàn)迅速改變的自適應(yīng)幀間分組的視頻編解碼器實(shí)現(xiàn)流程如圖1所示。

流程圖實(shí)現(xiàn)具體步驟描述如下:

(1)定義視頻的第一幀為Group1的第一個關(guān)鍵幀key1;

(2)根據(jù)上文提出的閾值判決原理和自適應(yīng)分組原理將視頻各幀劃分成N組(Group1,Group2,…,Group N),并對應(yīng)N個關(guān)鍵幀和若干非關(guān)鍵幀;

(3)關(guān)鍵幀的處理過程是對整幀圖像進(jìn)行CS編碼、傳輸、解碼,再通過自適應(yīng)的超分辨率重建算法重構(gòu)出關(guān)鍵幀圖像輸出;

(4)對非關(guān)鍵幀的處理不同于關(guān)鍵幀的地方在于必須先求出一幅殘差圖像(將非關(guān)鍵幀圖像與參考幀圖像求殘差所得圖像),然后再對該圖像進(jìn)行步驟(3)中與關(guān)鍵幀一樣的處理。最后還需要進(jìn)行重構(gòu)殘差圖像和參考幀圖像相加的處理,完成幀圖像輸出。

1.2視頻超分辨率重建的自適應(yīng)性研究

空間域方法在視頻超分辨率重建研究中有著較大的研究空間和應(yīng)用價值,因而成為該領(lǐng)域的研究重點(diǎn)。迭代反投影方法[9]、凸集投影方法(POCS)[10]、最大后驗(yàn)概率方法(MAP)[11]等是近年來比較經(jīng)典的研究成果。這些典型算法雖然在很大程度上改善了視頻重建效果,但是它們中的絕大部分只能夠在忽略了很多實(shí)際情況的理想狀態(tài)下實(shí)現(xiàn)。在實(shí)際的超分辨率重建過程中通常容易出現(xiàn)噪聲放大、空間振鈴現(xiàn)象等嚴(yán)重影響重建圖像質(zhì)量的病態(tài)問題,為避免上述狀況的發(fā)生一般所采取的解決方案是僅從空間域上來入手通過正則化的方法提升重建質(zhì)量。本文考慮到視頻幀與幀之間是同時存在于空間和時間上的,它們應(yīng)該在空間和時間上都存在相關(guān)聯(lián)性,所以便將時空聯(lián)合正則化算子引入到算法之中,來有效提高解的質(zhì)量。同時又提出了一種能夠自適應(yīng)計算出最合適時空正則化系數(shù)的 L曲線計算方法,以提高視頻超分辨率重建圖像質(zhì)量。

在超分辨率重建過程中,為解決外界噪聲等因素帶來的不良影響而需要加入懲罰函數(shù),這一解決辦法便稱為正則化。帶有懲罰函數(shù)的超分辨率重建如式(1)所示:

X=argxmin{AX-Y2+λγX2}(1)

式中,AX-Y2是數(shù)據(jù)擬合項(xiàng),γX2為正則化項(xiàng),可以控制解的擾動[12]。λ是正則化系數(shù),λ值增加時,重建圖像的平滑度就會隨之增大,所以在原始圖像信息提供短缺、噪聲影響嚴(yán)重等惡劣情況下,需適當(dāng)增大λ值。然而圖像過于平滑又是另一種失真,由于重建圖像的平滑度與λ的取值呈一種正相關(guān)關(guān)系,所以并不是λ的取值可以選擇無限大,而是需要找到最合適的λ取值來達(dá)到最好的重構(gòu)效果[12]。

帶有時空聯(lián)合正則化算子的超分辨率重建如式(2):

X=argxmin(Y-AX22+λΓX1)(2)

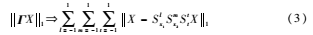

此目標(biāo)函數(shù)中,同時引入了L1、L2范數(shù),第一項(xiàng)中的L2范數(shù)用于加強(qiáng)數(shù)據(jù)重建的真實(shí)度;第二項(xiàng)的L1范數(shù)提高了其梯度域的稀疏性[9]。其中,時空聯(lián)合正則化算子Γ如下:

此處,Slx1、Smx2、 Stt 是將視頻X往x1、x2、t方向分別移動l、m、t個像素的平移算子。

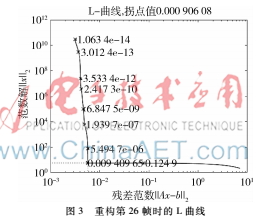

式(1)中λγX對于AX-Y2可以在lg-lg尺度上進(jìn)行轉(zhuǎn)換,二者轉(zhuǎn)換所得圖形正好是L曲線,而正則化系數(shù)λ是沿著這條曲線變化的。 L曲線存在水平和垂直兩個部分,兩個部分的交界處所出現(xiàn)的拐點(diǎn)的值正是對應(yīng)過正則化和欠正則化的臨界數(shù)值[10],因此該拐點(diǎn)處對應(yīng)的正則化系數(shù)λ的值則是最合適的數(shù)值λ*。最合適值的定義式如下:

![J9RZ])}PJ3%J)T67K@PI{O5.png J9RZ])}PJ3%J)T67K@PI{O5.png](http://files.chinaaet.com/images/2017/06/08/6363251904308963282929932.png)

該算法實(shí)現(xiàn)的具體步驟為:

(1)設(shè)需要重建的低分辨率視頻幀編號為i(i=1,2,…,),同時給所有高分辨率幀的編號為j(j=i,i+1,...,i+n);

(2)原始的低分辨率視頻中的圖像序列構(gòu)成向量Y,構(gòu)造稀疏矩陣A;

(3)構(gòu)造正則化矩陣Γ;

(4)根據(jù)Y、A、Γ計算出當(dāng)前i對應(yīng)的最合適的正則化系數(shù)λ,然后將求出的Y、A、Γ和λ代入到式(2)得到Xi;

(5)i=i+1,重復(fù)步驟(2)~(4)。當(dāng)i=num(輸入的原始低分辨率視頻序列的總幀數(shù))時停止,得到重建的高分辨率視頻。

2實(shí)驗(yàn)仿真與分析

為了證明本文算法的可行性,采用室外監(jiān)控器錄制下來的巡邏艦在水里快速行駛的“Coastguard”視頻序列進(jìn)行實(shí)驗(yàn)。實(shí)驗(yàn)中采用了一系列像素全為352×288的視頻幀圖像 ,同時測量矩陣為 32×32的SBHE矩陣,稀疏變換基采用DWT基。

在視頻幀固定、每組幀數(shù)完全相等的分組模式下,將視頻幀序列按順序每10幀劃成一組,并規(guī)定每組只有第一幀是關(guān)鍵幀。設(shè)定關(guān)鍵幀測量率為0.5,非關(guān)鍵幀測量率為0.2,其重構(gòu)方式采用傳統(tǒng)的GPSR,并將該模式取名為(F_GPSR)。在自適應(yīng)分組模式下,設(shè)定閾值T=28,并按照上文自適應(yīng)分組原理進(jìn)行不定幀數(shù)的分組,設(shè)定關(guān)鍵幀測量率為0.5,非關(guān)鍵幀測量率為0.2,其重構(gòu)方式采用本文所提出的基于L曲線的自適應(yīng)超分辨率重建方法,將該模式取名為(Proposed)。取其中低分辨率第26幀視頻幀圖像實(shí)驗(yàn)所得對比效果如圖2所示,采用Proposed模式視頻幀圖像重構(gòu)時的L曲線如圖3所示。

由圖2可以很直觀地看出在巡邏船快速行駛的情境下,Proposed模式下得到的視頻幀重構(gòu)圖像質(zhì)量遠(yuǎn)遠(yuǎn)優(yōu)于F_GPSR模式下得到的視頻幀重構(gòu)圖像質(zhì)量,同時由圖3可以得出該視頻幀圖像重構(gòu)時最合適的正則化系數(shù)λ*為0.000 906 08。

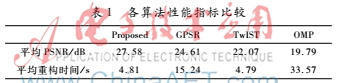

為凸顯本文算法的優(yōu)越性,使用三種已知的稀疏信號重構(gòu)算法GPSR 、TwIST 和OMP ,并采用視頻幀圖像固定分組的視頻編碼器,與本文提出的自適應(yīng)結(jié)合算法(Proposed)再進(jìn)行以下對比實(shí)驗(yàn)。

視頻幀均設(shè)定MR=30%時,各算法的性能指標(biāo)比較如表1所示。由表可以觀察出在視頻幀MR相同的情況下,本文所提出的Proposed算法在平均PSNR性能和平均重構(gòu)時間上較其他三種算法有著優(yōu)良的表現(xiàn)。

該視頻序列在各MR取值狀況下各算法重構(gòu)出圖像的平均PSNR性能如圖4所示。由圖4可以看出,本文所提出的自適應(yīng)結(jié)合算法的PSNR性能明顯優(yōu)于采用視頻幀圖像固定分組形式下的3種已知的重構(gòu)算法。特別是在具有較低的MR情況下,Proposed算法可以實(shí)現(xiàn)較其他算法更良好的性能。各算法重構(gòu)每一幀圖像所需平均時間(以秒為單位)對比如圖5所示,可以很直觀地看出,Proposed算法重構(gòu)每一幀圖像所需的平均時間是較短的,說明該算法相比這三種傳統(tǒng)重構(gòu)算法有著較低的重構(gòu)復(fù)雜度。

綜合表1數(shù)據(jù)和圖2~圖5結(jié)果可見,本研究所提出的Proposed算法在對于出現(xiàn)場景快速變化的低分辨率視頻序列圖像的重構(gòu)處理過程中,無論是在重構(gòu)圖像視覺效果、重構(gòu)PSNR性能還是重構(gòu)復(fù)雜度上都明顯優(yōu)于現(xiàn)有的固定分組模式下的傳統(tǒng)重構(gòu)算法。

3結(jié)論

本文提出的算法使得視頻幀圖像分組和超分辨率重建都實(shí)現(xiàn)了能夠隨所需處理的原始視頻自身狀況而自適應(yīng)優(yōu)化的功能。并通過大量實(shí)驗(yàn)證明了采用這種自適應(yīng)地分組、重構(gòu)相結(jié)合的處理算法能夠有效解決由于場景迅速改變及外界不良因素所帶來的視頻幀圖像重構(gòu)效果較差和病態(tài)超分辨率重建的問題,使得視頻幀圖像在不可避免的惡劣環(huán)境下也能夠得到很好的重構(gòu)效果,而且在視頻重構(gòu)PSNR性能和重構(gòu)復(fù)雜度上也有著優(yōu)良的表現(xiàn)。本文算法在自適應(yīng)視頻幀分組時所取閾值是經(jīng)多次實(shí)驗(yàn)驗(yàn)證而得到的最佳值,接下來的研究將針對該閾值如何更好取值進(jìn)行。

參考文獻(xiàn)

[1] CANDES E, ROMBERG J,TAO T.Robust uncertainty principles: exact signal reconstruction from highly incomplete frequency information[J]. IEEE Transactions on Information Theory,2006,52(2):489-509.

[2] DONOHO D L.Compressed sensing[J].IEEE Transactions on Information Theory,2006,52(4):1289-1306.

[3] STANKOVIC V,STANKOVIC L,CHENG S. Compressive video sampling[C].Proc. 16th IEEE International Conference on Image Processing. Poland:IEEE Press,2009:30013004.

[4] XIE X,LU Z,LAI Z.Fast encoding of video based on compressive sensing[C].Proc. YCICT’09.Beijing:IEEE Press,2009:114-117.

[5] DO T T, CHEN Y, NGUYEN D T, et al. Distributed compressed video sensing[C]. IEEE International Conference on Image Processing. IEEE Xplore, 2009:1393-1396.

[6] BAIG Y,LAI E M K,PUNCHIHEWA A. Distributed video coding based on compressed sensing[C].Proc. ICMEW 2012.Melbourne,VIC:IEEE Press,2012:325-330.

[7] WU M H,ZHU X C.A video code based on distribution compressive sensing[J].Procedia Engineering,2012(29):3613-3618.

[8] DONG G,XI Z. A novel video codec scheme based on compressive sensing[J]. Journal of Information and Computational Science,2013,10(14):46814689.

[9] IRANI M, PELEG S. Motion analysis for image enhancement: resolution, occlusion, and transparency[J]. Journal of Visual Communication & Image Representation, 1993, 4(4):324335.

[10] PATTI A J, SEZAN M I, TEKALP A M. Robust methods for highquality stills from interlaced video in the presence of dominant motion[J]. IEEE Transactions on Circuits & Systems for Video Technology, 1997, 7(2):328-342.

[11] BORMAN S, STEVENSON R L. Simultaneous multiframe MAP superresolution video enhancement using spatiotemporal priors[C]. International Conference on Image Processing, 1999. ICIP 99.IEEE, 1999:469-473.

[12] Shang Junguo, Jiao Binliang. Research on Tikhonov regularization of multiframe images reconstruction algorithm[J]. Application Research of Computers, 2011, 28(2):785-787.